Los microplásticos son diminutos fragmentos de plástico entre cinco milímetros y tamaños tan pequeños que son imperceptibles y que pueden causar graves daños medioambientales, pero también desordenes de alimentación y reproducción, desordenes en el metabolismo energético o cambios en la fisiología hepática, entre otros. Son producto de la degradación de los residuos plástico y su mayor amenaza radica en que no se disuelven en el agua y su degradación es extremadamente lenta, lo que les permite infiltrarse en los ecosistemas acuáticos y eventualmente en la cadena alimentaria humana.

Multitud de empresas e instituciones son ya conscientes de la gravedad de esta situación y la Comunidad de Madrid no es ajena y por ello ha tomado la iniciativa para enfrentar este problema emergente a través de la implementación de tecnologías innovadoras y colaboraciones con empresas punteras. Esta iniciativa no solo responde a una creciente preocupación global, sino que también sitúa a la región como un referente en la lucha contra la contaminación por microplásticos.

Tecnología innovadora: colaboración con Captoplastic

La Comunidad Autónoma de Madrid (CAM), a través de Canal de Isabel II, ha firmado un convenio con la empresa Captoplastic para ensayar una tecnología revolucionaria que elimina microplásticos del agua residual. Se trata de un sistema pionero en España que funciona mediante la utilización de partículas ferromagnéticas para identificar, cuantificar y atrapar estas diminutas partículas presentes en el agua, un herramienta que supone una enorme novedad en el tratamiento de aguas ya que permite una eliminación más eficiente y precisa de los contaminantes.

Las pruebas iniciales se han realizado en instalaciones que procesan 5.000 litros por hora y han demostrado una eficacia del 90% en la eliminación de microplásticos. Como consecuencia de este éxito preliminar se ha construido una planta piloto en la estación depuradora Arroyo del Soto, en Móstoles, que podrá tratar hasta 100.000 litros de agua por hora. Dicha instalación no solo permitirá evaluar la eficacia de la tecnología a gran escala, sino que también proporcionará datos valiosos para futuras implementaciones.

La iniciativa ha sido reconocida con el premio internacional NTT Data Awards, lo que subraya su potencial innovador y su relevancia en la lucha contra la contaminación por microplásticos ya que esta tecnología podría revolucionar la manera en que las plantas de tratamiento de aguas gestionan estas partículas, ofreciendo una solución efectiva a un problema de alcance mundial.

¿Por qué es importante eliminar los microplásticos?

Los microplásticos se han convertido en un contaminante preocupante debido a su capacidad para acumularse en los cuerpos de agua y su potencial impacto en la salud de los ecosistemas debido a que estos fragmentos plásticos pueden absorber contaminantes orgánicos persistentes (COP), que luego son ingeridos por algas y animales acuáticos, afectando a toda la cadena alimentaria posterior. Es decir, la presencia de microplásticos en los ecosistemas acuáticos puede tener efectos devastadores, desde la interrupción de las funciones biológicas de los organismos hasta la contaminación de fuentes de agua potable.

Pero además, la eliminación de microplásticos no solo mejora la calidad del agua, sino que también reduce la presencia de estos contaminantes en los lodos utilizados como fertilizantes, evitando su propagación en los suelos agrícolas y otros espacios ambientales. Este aspecto es crucial, ya que los lodos contaminados pueden transferir microplásticos a los suelos, afectando la calidad de los cultivos y, en última instancia, la salud humana.

Impacto y futuro de la tecnología en la Comunidad de Madrid

La implementación de esta tecnología innovadora por parte de la Comunidad de Madrid no solo posiciona a la región como líder en la lucha contra los microplásticos, sino que también establece un precedente para otras regiones y países. La planta piloto en Móstoles servirá como modelo para futuras instalaciones, y si los resultados son positivos, el Canal de Isabel II podría adoptar esta técnica en todas las estaciones depuradoras de la región.

Además, la adopción de estas tecnologías puede generar beneficios económicos al reducir los costes asociados con la contaminación por microplásticos y la mejora de la calidad del agua también puede atraer inversiones y fomentar el desarrollo de tecnologías limpias en la región.

Otras tecnologías existentes para la detección de microplásticos

Fotónica y métodos analíticos sensibles

Una de las metodologías emergentes para detectar microplásticos es el uso de la fotónica, ese conjunto de tecnologías que utilizan la luz y sus partículas elementales como elemento para generar aplicaciones de todo tipo. El proyecto MP WATCHING, desarrollado por el Instituto de Investigación y Tecnología Agroalimentarias (IRTA) de la Generalitat de Catalunya, busca implementar una técnica basada en esta área que permita la detección rápida y económica de microplásticos en agua y sedimentos. Este proyecto, que incluye el muestreo en el delta del Ebro, pretende estandarizar los métodos de análisis para facilitar su aplicación por parte de administraciones y empresas.

La fotónica ofrece una forma innovadora y efectiva de identificar microplásticos, utilizando la interacción de la luz con los materiales para detectar y cuantificar la presencia de estas partículas lo que lo convierte en un método rápido y también más económico que las técnicas tradicionales, lo que facilita su posible adopción futura a gran escala.

Espectrometría FTIR y Raman

En laboratorios, la microespectrometría FTIR combinada con la espectrometría Raman se utiliza para identificar microplásticos. Estas técnicas analíticas proporcionan una «huella digital» molecular que permite la identificación precisa de diferentes materiales poliméricos, crucial para el análisis detallado de microplásticos en el agua. La combinación de estas dos técnicas ofrece una mayor precisión y detalle en la identificación de microplásticos, permitiendo un análisis más completo y exacto.

De hecho, la espectrometría FTIR (Transformada de Fourier Infrarroja) es particularmente útil para detectar grupos funcionales polares en los materiales plásticos, mientras que la espectrometría Raman complementa esta información al proporcionar detalles adicionales sobre la estructura molecular. Juntas, ofrecen una solución potente para la identificación de estas partículas en el agua.

Inteligencia Artificial

La inteligencia artificial también está desempeñando un papel crucial en la detección de microplásticos. Investigadores de la Universidad de Waterloo han desarrollado PlasticNet, una herramienta de IA que analiza grandes cantidades de partículas con mayor rapidez y precisión que los métodos tradicionales consiguiendo identificar microplásticos en muestras de agua residual, ayudando a las plantas de tratamiento a implementar medidas de control más efectivas.

PlasticNet utiliza redes neuronales profundas para analizar las señales espectroscópicas de las partículas, permitiendo una identificación rápida y precisa lo que además de acelerar el proceso de análisis, también reduce la posibilidad de errores humanos, mejorando, por tanto, la fiabilidad de los resultados.

Tecnologías de membranas y digestión anaerobia

AIMPLAS, el Instituto Tecnológico del Plástico Español, está desarrollando tecnologías avanzadas de depuración basadas en membranas de ultrafiltración y digestión anaerobia. Estas tecnologías prometen una eficiencia superior al 99% en la eliminación de micro y nanoplásticos de las aguas residuales, convirtiéndose en una solución pionera en Europa.

Su funcionamiento se basa en una combinación de membranas de ultrafiltración con procesos de digestión anaerobia que ofrecen una solución completa para la eliminación de microplásticos. Las membranas de ultrafiltración capturan las partículas más pequeñas, mientras que la digestión anaerobia descompone los residuos orgánicos, reduciendo así la carga contaminante de las aguas residuales.

Lo que queda claro es que la lucha contra los microplásticos requiere un enfoque multifacético y la adopción de tecnologías innovadoras. La Comunidad de Madrid ya ha dado un paso significativo con este nuevo proyecto al igual que el resto de proyectos, que sientan las bases para futuras innovaciones en la gestión del agua y la protección de nuestros ecosistemas. En MIOTI Tech & Business School sabemos lo fundamental que resulta la lucha contra el cambio climático y el cuidado de los ecosistemas, dos áreas en las que la tecnología y sus potenciales aplicaciones juegan un papel crucial. Formar a los profesionales del futuro es solo el primero de los pasos y por ello en nuestra escuela contamos con cursos centrados en las tecnologías más punteras y con mayor demanda en el mercado.

El ciclismo ha experimentado una transformación impresionante gracias a los avances tecnológicos. Desde la mejora de las bicicletas hasta el uso de datos y análisis en tiempo real, la tecnología está redefiniendo este deporte y las tres grandes competiciones del continente europeo, el Giro de Italia, el Tour de Francia y la Vuelta Ciclista a España, no son ajenos a estos avances y desarrollos.

La evolución de las bicicletas

Uno de los cambios más evidentes en el ciclismo es la evolución de las bicicletas. Las bicicletas modernas están hechas de materiales ligeros pero resistentes, como la fibra de carbono, que permiten a los ciclistas alcanzar mayores velocidades con menos esfuerzo.

Además, las bicicletas de alta gama actualmente también incorporan frenos de disco hidráulicos, que ofrecen un control superior y mayor seguridad en descensos pronunciados. Precisamente en este pasado Giro de Italia 2024 ya se pudo observar un uso generalizado de bicicletas con frenos de disco, lo que permitió a los ciclistas mantener una velocidad constante y segura incluso en etapas de alta montaña, un cambio que ha sido bien recibido por los ciclistas y equipos competidores por la precisión y eficiencia que aportan.

Tecnología de datos y análisis en tiempo real

Además de las innovaciones en lo físico también han llegado novedades en áreas más tecnológicas como tal. Por ejemplo, la recopilación y el análisis de datos en tiempo real han cambiado radicalmente la forma en que se planifican y ejecutan las carreras ya que, a través de sensores y dispositivos GPS, los equipos de ciclismo son capaces de monitorizar el rendimiento de los ciclistas durante las etapas. Gracias a la recopilación de estos datos es posible analizar la situación en tiempo real y ajustar las estrategias consiguiendo como resultado optimizar el rendimiento final de los atletas.

Durante el Tour de Francia 2024, equipos como Ineos Grenadiers y Jumbo-Visma utilizaron tecnologías avanzadas para monitorizar la frecuencia cardíaca, la potencia y la velocidad de sus ciclistas. Esta información permitió a los directores deportivos tomar decisiones estratégicas sobre cuándo atacar o conservar energía, lo que resultó en un rendimiento superior en varias etapas clave.

View this post on Instagram

La aerodinámica: un factor clave

La aerodinámica juega un papel crucial en el rendimiento de un ciclista y engloba desde la posición en la bicicleta hasta la ropa que utilizan ya que cada detalle puede marcar la diferencia entre ganar o perder una etapa. Por ello, los equipos invierten considerablemente en investigación y desarrollo para optimizar la aerodinámica de sus bicicletas y equipos.

En la Vuelta a España 2023, se apreció un aumento en el uso de cascos y trajes aerodinámicos especialmente diseñados para reducir la resistencia al viento. Estos trajes están fabricados con materiales avanzados y se ajustan al cuerpo como una segunda piel, minimizando cualquier arrastre innecesario y permitiendo a los ciclistas mantener velocidades más altas con menos esfuerzo.

Innovaciones en entrenamiento y recuperación

La tecnología también ha revolucionado los métodos de entrenamiento y recuperación de los ciclistas ya que la aparición y uso de simuladores de ciclismo, entrenadores inteligentes y dispositivos de recuperación avanzados han permitido a los ciclistas entrenar de manera más eficiente y recuperarse más rápidamente de los esfuerzos intensos como por ejemplo los del Giro de Italia. En la edición de este año, los ciclistas del equipo Movistar, por ejemplo, utilizaron entrenadores inteligentes como el Wahoo KICKR durante su preparación. Se trata de unos dispositivos que permiten replicar las condiciones de las etapas reales, proporcionando un entrenamiento específico y adaptado a cada ciclista. Además, el uso de botas de compresión y cámaras hiperbáricas ha mejorado significativamente los tiempos de recuperación, permitiendo a los ciclistas rendir al máximo día tras día.

View this post on Instagram

La integración de la Inteligencia Artificial

La inteligencia artificial (IA) está empezando a jugar un papel importante en el ciclismo abarcando desde el análisis de datos hasta la predicción de rendimientos y la creación de estrategias de carrera, unas aplicaciones que están ayudando a los equipos a obtener una ventaja competitiva.

Durante el Tour de Francia 2024, que acaba de concluir, el uso de software de IA se utilizó para analizar grandes volúmenes de datos y predecir el rendimiento de los ciclistas en diferentes etapas y permitió a los equipos anticipar los movimientos de sus rivales y ajustar sus estrategias en consecuencia. Como consecuencia se alcanzó una mayor competitividad y carreras más emocionantes.

Sostenibilidad y tecnología

Por otro lado, la sostenibilidad se ha convertido en un tema importante en el ciclismo profesional. Los equipos y organizadores de carreras están buscando maneras de reducir su huella de carbono y adoptar prácticas más ecológicas y la tecnología está jugando un papel crucial en esta transición.

En esta línea, en la Vuelta Ciclista a España de 2023 se implementaron varias iniciativas sostenibles, como el uso de vehículos eléctricos para el transporte de equipos y el reciclaje de residuos generados durante las etapas. Además, algunas bicicletas se están fabricando con materiales reciclados y procesos de producción más sostenibles, demostrando que la tecnología y la sostenibilidad pueden ir de la mano en este deporte.

Lo que está claro es que la tecnología ha cambiado el ciclismo de formas que eran inimaginables hace solo unas décadas yendo desde bicicletas más avanzadas y aerodinámicas hasta el uso de datos y análisis en tiempo real, unos avances que están haciendo del ciclismo un deporte más emocionante y competitivo como ya se está demostrando en las grandes competiciones europeas. En MIOTI Tech & Business School somos líderes en formación en Inteligencia Artificial, Data Science, IoT y Digital Business, áreas que están resultando fundamentales en muchos de los avances tecnológicos. Pero las aplicaciones de estos sectores no se limitan al deporte, también tienen multitud de aristas empresariales y en MIOTI lo sabemos bien. por ello, contamos con formaciones In-Company específicamente diseñadas para adaptarse a las necesidades concretas del cliente, consiguiendo así que los empleados cuenten con la mejor formación en nuevas tecnologías.

SearchGPT es la nueva herramienta de búsqueda impulsada por Inteligencia Artificial (IA) desarrollada por OpenAI, la misma empresa responsable de ChatGPT. Esta tecnología utiliza GPT-4 para mejorar la precisión y relevancia de los resultados de búsqueda, permitiendo a los usuarios obtener respuestas más detalladas y contextualmente precisas. SearchGPT representa una gran irrupción en el mercado de los motores de búsqueda, con el potencial de competir directamente con Google, el líder actual.

El desarrollo de SearchGPT responde a la creciente necesidad de herramientas de búsqueda más inteligentes y eficientes, teniendo en cuenta un entorno cada vez más saturado de información y datos que sigue una tendencia exponencial a la que no se le ve fin.

¿Qué novedades trae SearchGPT?

A diferencia de los motores de búsqueda tradicionales, SearchGPT permite a los usuarios interactuar de manera natural con la herramienta. De este modo, pueden formular preguntas de manera intuitiva y recibiendo respuestas en un formato conversacional similar al humano. Utilizar SearchGPT es tan sencillo como escribir una pregunta en la barra correspondiente y esperar a que el algoritmo genere una respuesta. Gracias a su capacidad para comprender el contexto y la intención detrás de cada consulta, es capaz de ofrecer resultados personalizados y adaptados a las necesidades de cada usuario.

Una de las grandes novedades es que SearchGPT incorpora capacidades de búsqueda semántica, lo que quiere decir que puede comprender el significado detrás de las consultas y ofrecer resultados basados en la relación entre conceptos y entidades. Se prevé que esta funcionalidad permita a SearchGPT identificar y analizar el tono emocional de un texto. Esto podrá ser útil para filtrar resultados de búsqueda en función del sentimiento expresado en el contenido.

Otra innovación clave es que SearchGPT categoriza los resultados y presenta descripciones breves con enlaces directos a las fuentes originales. Además, SearchGPT podría integrarse con diversas plataformas y servicios, como Siri de Apple. Esta característica podría llevar sus avanzadas capacidades de búsqueda a una audiencia mucho mayor y mejorar la funcionalidad de los dispositivos.

¿Cuándo se podrá utilizar y quién puede hacerlo?

Aunque SearchGPT se encuentra actualmente en fase de pruebas y desarrollo, se espera que esté disponible para el público en general en los próximos meses. Esta herramienta estará al alcance de cualquier persona que desee realizar búsquedas más inteligentes y eficientes. Ya sea para obtener información específica, respuestas a preguntas complejas o simplemente explorar nuevos temas de interés.

Hasta ahora, SearchGPT ha sido probado en Estados Unidos dentro de un grupo selecto de 10.000 usuarios, quienes han tenido acceso anticipado a esta tecnología en su fase de prototipo. Los resultados iniciales han sido prometedores, destacándose las capacidades del motor de búsqueda y superando en algunos casos a los más tradicionales. Los usuarios han valorado especialmente la posibilidad de interactuar de manera más natural en sus interacciones, mejorando así la experiencia de uso.

Esta fase de pruebas también ha permitido a OpenAI colaborar con organizaciones de noticias como News Corp y The Atlantic para garantizar que el contenido se muestre de manera adecuada y con las correspondientes licencias y atribuciones.

¿Cuáles son las ventajas de SearchGPT?

Como hemos visto, una de las principales ventajas de SearchGPT es su capacidad para comprender el lenguaje natural y responder a preguntas de manera conversacional, pero no es la única. Sus capacidades principales se podrían resumir en estos tres puntos:

- Precisión y relevancia de los resultados: Al utilizar Inteligencia Artificial para comprender el contexto y la intención detrás de cada consulta, las respuestas intentan ser más precisas y relevantes. Esto permite a los usuarios obtener respuestas más detalladas, minimizando la necesidad de realizar múltiples búsquedas para encontrar la información deseada.

- Interacción Conversacional y natural: La capacidad de mantener conversaciones naturales con el motor de búsqueda hace que la experiencia de búsqueda sea más fluida y cómoda para los usuarios.

- Aprendizaje continuo y mejora constante: Gracias a su base en tecnologías como GPT-4, la herramienta es capaz de aprender y mejorar continuamente a medida que se utiliza, lo que significa que los resultados de búsqueda están cada vez más entrenados.

Una revolución para el Marketing Digital

La introducción de SearchGPT promete tener un impacto especial en el marketing digital, reconfigurando las estrategias de visibilidad y posicionamiento online. A medida que este nuevo motor de búsqueda basado en IA comience a ganar tracción, los especialistas en marketing deberán adaptarse a un entorno donde la búsqueda se centra en la capacidad de proporcionar contenido que pueda ser interpretado y presentado de manera contextual por una IA avanzada. Esto significa que la calidad, relevancia y contexto del contenido se volverán aún más cruciales.

En este sentido, el cambio está desafiando las estrategias de SEO convencionales, ya que SearchGPT requiere un enfoque centrado en la experiencia del usuario. Las marcas deben reconsiderar cómo estructuran su contenido para que sea fácilmente comprensible y utilizable por una IA.

El futuro de los motores de búsqueda: Expectativas y preparación

El futuro de SearchGPT se vislumbra lleno de promesas y posibilidades, pero también de retos y desafíos. Esta herramienta representa un paso adelante en la evolución de Internet con su enfoque en la precisión, la interacción conversacional y el aprendizaje continuo. No obstante, es aún demasiado pronto para valorar si conseguirá destronar al actual motor de búsqueda líder de Google o no.

En MIOTI Tech & Business School nos mantenemos al día de todos los avances en Inteligencia Artificial y aplicamos estos conocimientos a nuestros programas. En este sentido, contamos con nuestro Máster en Data Science & Analytics donde los alumnos aprenden desde conceptos básicos de preprocesamiento de datos, Inteligencia Artificial y programación en Python, hasta los últimos modelos de IA, como es el caso de SearchGPT. También con el Máster en Digital Marketing & Analytics en el que los futuros profesionales de este sector aprenden sobre las herramientas y técnicas más avanzadas de marketing digital con la que podrán mantenerse relevante en un futuro tan cambiante.

Meta ha anunciado recientemente el lanzamiento de SAM 2, Segment Anything Model o Modelo de Segmentación de Cualquier Cosa por su traducción al español, marcando un gran avance en el campo de la visión artificial y el análisis de video. Basándose en la base establecida por su predecesor, SAM 2 introduce capacidades innovadoras en la segmentación de objetos, mejorando tanto la precisión como la eficiencia en el procesamiento de datos visuales en imágenes y videos.

La evolución de SAM a SAM 2

El modelo original de SAM fue diseñado para segmentar objetos en imágenes con una precisión notable, utilizando IA para identificar qué píxeles de una imagen corresponden a objetos específicos. Este modelo encontró aplicaciones en diversos campos, como las ciencias del mar, la medicina y el análisis de imágenes satelitales. Además, SAM permitió nuevas herramientas impulsadas por Inteligencia Artificial (IA) en las aplicaciones de Meta, como Backdrop y Cutouts en Instagram, simplificando tareas como la edición de fotos.

Sin embargo, SAM estaba enfocado principalmente a imágenes estáticas, y el desafío de extender sus capacidades al contenido de video dinámico requería de nuevos avances. Aquí es donde entra SAM 2, un modelo unificado capaz de realizar segmentación en tiempo real tanto en imágenes como en videos, abordando las complejidades de los datos audiovisuales donde los objetos están en movimiento, pueden cambiar de apariencia y pueden estar ocultos por otros elementos en la escena.

Entre las innovaciones más destacadas de este nuevo modelo, encontramos:

Marco unificado

A diferencia de los modelos anteriores que trataban la segmentación de imágenes y videos como tareas separadas, SAM 2 ofrece un enfoque cohesivo, proporcionando un rendimiento consistente en varios tipos de datos visuales. Esta unificación agiliza el proceso de transición entre el análisis de imágenes y videos.

Segmentación interactiva

SAM 2 introduce capacidades de segmentación interactivas. Los usuarios pueden guiar la atención del modelo mediante clics, cuadros delimitadores o incluso descripciones textuales, lo que lo hace altamente adaptable a necesidades específicas y permite una identificación precisa de objetos con una entrada mínima.

Conciencia temporal

SAM 2 puede mantener el contexto a lo largo de los fotogramas de video. Esta comprensión temporal permite que el modelo rastree objetos incluso cuando están temporalmente ocultos o salen del cuadro, una característica crucial para aplicaciones como vehículos autónomos y sistemas de vigilancia.

Eficiencia y velocidad

SAM 2 demuestra una eficiencia computacional notable, requiriendo menos interacciones humanas para la segmentación de video y funcionando más rápido que su predecesor. El modelo puede procesar fotogramas de video a aproximadamente 44 fotogramas por segundo, permitiendo un análisis casi en tiempo real.

Procesamiento de alta resolución

SAM 2 puede manejar imágenes con hasta cuatro veces la resolución de los modelos anteriores, lo que lo hace adecuado para análisis detallados en campos como la imagen médica y la interpretación de imágenes satelitales.

¿Cómo funciona SAM 2 y qué aplicaciones prácticas tiene?

Este tipo de modelos de visión artificial se basan en el computer vision, un campo de la Inteligencia Artificial que se enfoca en capacitar a las máquinas para interpretar y comprender el mundo visual. En otras palabras, permite que los sistemas de IA realicen tareas que requieren «ver» y «comprender» el contenido visual de una manera similar a como lo hacen los humanos. Entre estas tareas encontramos el reconocimiento, la detección y el seguimiento de objetos. También, más enfocado al tema que nos ocupa, la segmentación de imágenes, es decir, dividir una imagen en segmentos más pequeños para identificar y clasificar diferentes partes de la misma, asignando cada píxel a un objeto específico.

Es esta capacidad es la que ha abierto numerosas posibilidad para diferentes industrias en la aplicación de SAM 2.

- Edición y producción de video: SAM 2 puede agilizar el proceso de aplicar efectos visuales y editar videos, reduciendo el tiempo requerido para el trabajo de postproducción.

- Vehículos autónomos: Al mejorar la detección y el seguimiento de objetos en tiempo real, SAM 2 puede mejorar la seguridad y la eficiencia de los coches autónomos, especialmente en escenarios de tráfico complejos.

- Medicina: En el sector de la salud, SAM 2 puede ayudar en el diagnóstico segmentando estructuras anatómicas complejas en escaneos médicos, potencialmente identificando anomalías que podrían ser pasadas por alto por el ojo humano.

- Monitorización ambiental: Los investigadores pueden usar SAM 2 para analizar imágenes satelitales con mayor precisión, permitiendo un seguimiento detallado de los cambios en el uso del suelo, el desarrollo urbano y los esfuerzos de conservación de la vida silvestre.

- Realidad Aumentada (AR) y Virtual (VR): Las capacidades de segmentación en tiempo real del modelo pueden mejorar las interacciones con objetos virtuales de video en vivo.

Fuente abierta y el impacto en la comunidad

El compromiso de Meta con la IA de código abierto es evidente con SAM 2. Al lanzar el modelo y sus extensos conjuntos de datos de entrenamiento como código abierto, Meta fomenta la innovación y permite que desarrolladores e investigadores adapten SAM 2 para una amplia gama de aplicaciones, desde la investigación académica hasta proyectos comerciales.

Los extensos datos de entrenamiento, incluido el nuevo conjunto de datos SA-V con más de 51.000 videos y millones de fotogramas etiquetados, aseguran que SAM 2 esté bien equipado para generalizar en diversos contextos visuales. Este amplio conjunto de datos mejora la robustez y adaptabilidad del modelo, convirtiéndolo en una herramienta poderosa para futuros desarrollos de IA.

En definitiva, SAM 2 representa un avance más en el desarrollo de la Inteligencia Artificial general, y, más en concreto, del computer vision. En MIOTI Tech & Business School queremos formar parte de la revolución de la IA, formando a los mejores profesionales en este ámbito. Por ello, hemos desarrollado el Máster en Data Science & Deep Learning, en el que no solo conocerás los fundamentos y las técnicas más avanzadas de computer vision, sino que aprenderás la base de la ciencia de datos y aplicarás las últimas técnicas de Machine Learning y Deep Learning, base para disciplinas como la IA Generativa.

En el mundo actual, la Inteligencia Artificial (IA) y los datos no son solo tendencias pasajeras, sino una revolución tecnológica que está transformando todas las industrias. Desde la medicina hasta las finanzas, pasando por el entretenimiento y la educación, la IA está redefiniendo la manera en que vivimos y trabajamos. Estudiar IA es esencial para cualquier profesional que quiera estar a la vanguardia de la innovación y aprovechar las innumerables oportunidades laborales que ofrece este campo.

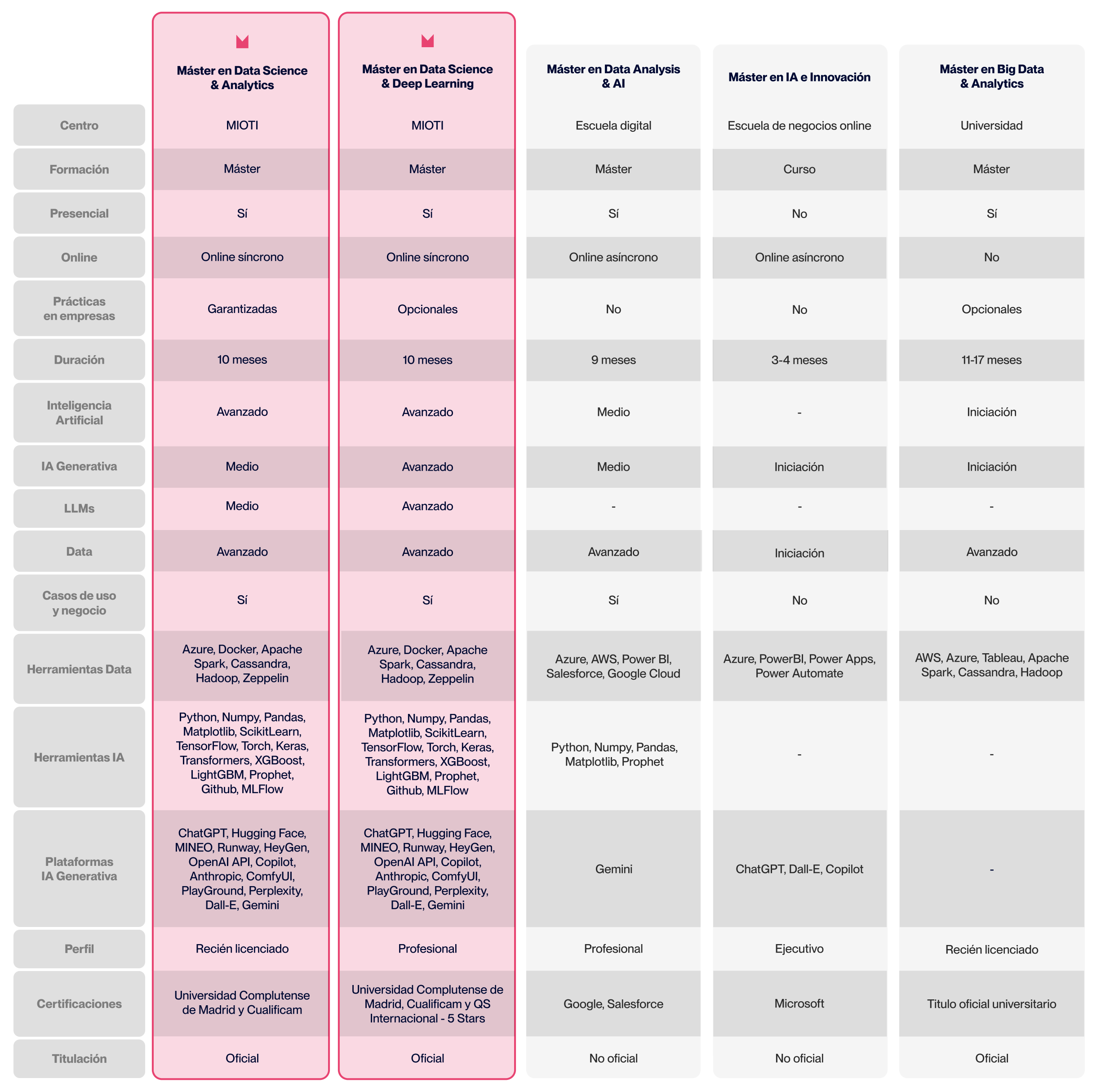

Sin embargo, elegir un máster adecuado en IA puede ser un desafío. Los mejores programas deben ofrecer una combinación equilibrada entre teoría y práctica, estar respaldados por reconocimientos y certificaciones de prestigio, y contar con un profesorado experimentado que trabaje con las tecnologías más avanzadas. A continuación, analizaremos los criterios fundamentales para seleccionar un buen máster en IA y cómo nuestro Máster en Data Science & Deep Learning dirigido a profesionales y nuestro Máster en Data Science & Analytics para perfiles recién graduados destacan frente a otros programas.

Criterios para escoger un buen máster en Inteligencia Artificial

Elegir el máster adecuado en IA es una decisión crucial para tu carrera. Aquí te presentamos los criterios esenciales que debes considerar al evaluar diferentes programas:

- La doble F, Formato Flexible: La flexibilidad en el formato de las clases es crucial para adaptarse a las necesidades de los estudiantes. La posibilidad de elegir entre clases presenciales y online (Live Streaming) permite a los profesionales compaginar sus estudios con otras responsabilidades.

- Profesorado en activo: Los mejores programas cuentan con profesores que son profesionales en grandes compañías españolas y multinacionales. Esto garantiza que los estudiantes aprenderán de expertos que están aplicando los conocimientos en el mundo real.

- Contenido actualizado y retos constantes: Un programa de IA debe incluir las últimas tecnologías y metodologías, con un enfoque práctico que permita a los estudiantes aplicar lo aprendido en proyectos reales.

- Stack tecnológico avanzado: Es fundamental que el máster ofrece formación en las herramientas, librerías y modelos más avanzados del sector, para preparar a los estudiantes para los desafíos actuales y futuros que la industria demanda.

- Certificaciones y reconocimientos: Las certificaciones y los reconocimientos son un indicador de la calidad del programa y de su relevancia en el mercado laboral a nivel nacional e internacional.

Comparativa de másters en IA

No todos los masters en IA ofrecen el mismo nivel de profundidad y especialización. Algunos programas no son masters, sino cursos con un alcance limitado que no proporcionan una formación exhaustiva en IA.

Otros no profundizan en la IA, centrándose únicamente en aspectos generales de la IA Generativa sin entrar en detalles técnicos. En algunos casos están más orientados a negocios, con una inclusión superficial de IA.

Cuidado con… ⚠️

Cuidado con lo que es un máster y lo que no lo es

❌ No es un curso de IA Generativa corto, ni revisar un conjunto enorme de tecnologías novedosas sin objetivo de aprendizaje profundo.

✔️ Es un programa integral que cubre todos los aspectos de la IA y en el que te formas como profesional que puede desarrollar y llevar a cabo proyectos de IA.

Cuidado con la palabra online… ¿Síncrono o asíncrono?

❌ No es lo mismo un curso online con clases grabadas que uno con sesiones en vivo en las que el profesor atiende tus dudas en directo. Ver vídeos es algo que puedes hacer en Youtube.

✔️ Asegúrate de que el programa ofrece clases en live streaming para una experiencia interactiva y en tiempo real, salir de clase con soluciones y con contacto prolongado con tus profesores.

Cuidado con la metodología Learning by Doing

❌ No es un programa teórico sin aplicación práctica o con poca aplicación práctica.

✔️ Comprueba que utilicen una metodología 100% práctica con proyectos reales y casos de negocio aplicables, clases con profesor resolviendo ejercicios reales de industria

Cuidado con lo que llamamos “tutorías”

❌ No es solo acceso a materiales de estudio o foros de discusión en linea.

✔️ Deben incluir apoyo personalizado y tutorías con profesores expertos en la materia que te guíen durante las prácticas y en tu proyecto final.

Cuidado con las promesas de los títulos oficiales

❌ No todos los programas ofrecen certificaciones reconocidas oficialmente. Decir que ofrecen una certificación puede suponer únicamente que tienes acceso a un examen para certificarte, el mismo que podrías hacer online.

✔️ Verifica que el máster esté respaldado por instituciones de prestigio y que sus títulos tengan reconocimiento oficial a nivel nacional o internacional.

Cuidado con la profundidad del contenido

❌ No es un máster que se quede en lo superficial y te cuente la oportunidad que va a suponer para otros.

✔️ Una formación detallada y exhaustiva en las tecnologías de IA debe ofrecer un contenido más avanzado, challenges y herramientas específicas, tú eres el creador de esas oportunidades.

Cuidado con la experiencia del profesorado

❌ No es impartido por académicos sin experiencia práctica.

✔️ Mejor si está dirigido por profesionales en activo de grandes compañías, cuyos conocimientos están actualizándose constantemente.

El valor diferencial de MIOTI

Nuestros masters ofrecen una serie de características que los hacen únicos:

Doble titulación por la UCM y reconocimientos internacionales

Están certificado por la Universidad Complutense de Madrid, ofreciendo una doble titulación en Inteligencia Artificial. Además, cuentan con la certificación Cualificam y la máxima distinción -5 estrellas- de QS, reconocimientos que avalan su calidad tanto a nivel nacional como internacional.

Formato Blended

Los alumnos pueden elegir entre asistir a clases presenciales o en live streaming (online síncrono), proporcionando flexibilidad para adaptarse a sus necesidades personales y profesionales.

Profesorado de alto nivel

Nuestro profesorado está compuesto por profesionales en activo de grandes compañías como Accenture, Repsol o El Corte Inglés, entre otras, asegurando que los estudiantes aprendan de expertos con experiencia real en la industria.

Contenido innovador y metodología 100% práctica

Nuestros masters incluyen tecnologías de IA avanzadas como Computer Vision, NLP, Machine Learning, Modelos Fundacionales y desafíos de IA Generativa. Desde una metodología Learning by Doing, los estudiantes trabajan en proyectos reales, lo que les permite aplicar los conocimientos adquiridos de manera inmediata en sus empresas o en su lugar de prácticas.

Stack tecnológico único de MIOTI

Los estudiantes trabajarán con herramientas de vanguardia como Cassandra, Apache Spark, MINEO, Numpy, Pandas, GPT, SciPy y Prophet, entre muchas otras. Esto garantiza que estarán preparados para enfrentar cualquier desafío tecnológico en el ámbito de la IA.

Perfil del alumnado

Nuestros programas está diseñado para profesionales con ciertos conocimientos técnicos, preferiblemente en STEM, que deseen explorar a fondo herramientas y modelos avanzados de datos e Inteligencia Artificial.

«Mi experiencia en MIOTI es totalmente positiva. La calidad de los profesores es excelente y siempre están dispuestos a ayudarte«, Martín Burgos, Technical Support Engineer en Qlik.

«Conseguí las prácticas gracias a MIOTI y pude ir aplicando día a día lo que había aprendido en las clases el día anterior«, Pablo Mancheño, alumno en nuestro Máster en Data Science & Analytics.

En MIOTI Tech & Business School, estamos comprometidos a preparar a los profesionales del futuro. Con nuestros masters, obtendrás una educación de calidad respaldada por expertos del sector y por una institución tan prestigiosa como la Universidad Complutense de Madrid (UCM), el certificado Cualificam y el Ranking Internacional QS.

En la era digital actual, la Inteligencia Artificial (IA) se ha convertido en un elemento indispensable para potenciar la eficiencia y la innovación en los negocios. Una de las áreas en las que la IA ha demostrado un impacto significativo es en la generación de código, donde herramientas como Github Copilot, Replit y Llama 3 han revolucionado la forma en la que operan las empresas.

Por ello, es una práctica cada vez más común en los negocios, ya que ofrece una forma eficiente y precisa de crear y optimizar programas informáticos. Estas herramientas de IA son utilizadas por las organizaciones para agilizar el proceso de desarrollo de software, reducir errores y optimizar la productividad de los equipos de programación ya que en un entorno empresarial altamente competitivo y en constante evolución, la capacidad de generar código de manera inteligente y automatizada se ha vuelto crucial para mantenerse a la vanguardia y satisfacer las demandas del mercado. Estas son algunas de las herramientas más destacadas:

Github Copilot

Una de las herramientas más utilizadas en el ámbito de la generación de código es Github Copilot, una extensión de Visual Studio Code, que utiliza modelos de lenguaje avanzados para ofrecer sugerencias de código en tiempo real. Esta herramienta revolucionaria es capaz de comprender el contexto y las intenciones del programador, generando fragmentos de código de alta calidad de forma instantánea. Además, Github Copilot es especialmente útil en la creación de algoritmos complejos, la implementación de funciones repetitivas y la corrección de errores comunes.

Por todo esto, dentro de un entorno empresarial, puede ser una herramienta fundamental para los equipos de desarrollo de software. Por ejemplo, en el área de desarrollo web, un programador puede utilizar Github Copilot para agilizar la creación de interfaces de usuario interactivas y que se adapten bien, reduciendo significativamente el tiempo que se dedica a tareas rutinarias. Además, en el desarrollo de aplicaciones móviles, esta herramienta puede generar automáticamente código para la integración de servicios en la nube, mejorando el rendimiento y la capacidad de adaptación de la aplicación.

Replit

Otra herramienta destacada en el ámbito de la programación con IA es Replit, una plataforma versátil que integra la Inteligencia Artificial en el entorno de desarrollo. Replit ofrece una amplia gama de funciones, como la colaboración en tiempo real, la ejecución de código en la nube y la integración con múltiples lenguajes de programación. Esta plataforma es especialmente útil para empresas que buscan optimizar sus procesos de desarrollo de software y fomentar la innovación en sus proyectos.

En un contexto empresarial, Replit puede ser de gran ayuda en diversas áreas para mejorar la eficiencia y la calidad del desarrollo de software. En el sector de la educación, por ejemplo, esta herramienta puede emplearse para crear entornos de programación interactivos y personalizados, facilitando el aprendizaje de nuevos conceptos y tecnologías. Asimismo, en el ámbito de la ciberseguridad, Replit puede ser útil para simular y analizar posibles debilidades en los sistemas de una empresa, fortaleciendo así sus medidas de protección y prevención de ataques cibernéticos.

Llama 3.1

Finalmente, Llama 3.1 destaca por su enfoque en el análisis de grandes conjuntos de datos para ofrecer recomendaciones y predicciones basadas en ellos consiguiendo que la toma de decisiones empresariales esté fundamentada, además de anticipar tendencias y oportunidades en el mercado algo que supone una enorme ventaja competitiva significativa en un entorno empresarial cada vez más exigente y dinámico.

Llama 3.1 puede ser un gran aliado en diversas áreas para mejorar la planificación estratégica en multitud de áreas como por ejemplo en el sector del comercio electrónico donde esta herramienta puede analizar el comportamiento de los clientes en Internet y predecir patrones de compra. Esto permite a las empresas personalizar sus ofertas y campañas de marketing para optimizar la conversación con los clientes y su fidelización. Por otro lado, en el ámbito financiero, es muy práctico para identificar riesgos y oportunidades de inversión, proporcionando a los ejecutivos información clave para optimizar la gestión de activos y el rendimiento financiero de la empresa.

Alineando la tecnología con el éxito empresarial

La colaboración entre humanos y sistemas inteligentes está dando lugar a soluciones más innovadoras y eficientes, lo que impulsa la evolución continua de la industria hacia un futuro más automatizado. Este enfoque centrado en la integración de la IA en el desarrollo de software no solo mejora la eficiencia operativa, sino que también prepara el escenario para una nueva era de creatividad y progreso tecnológico sin precedentes. La clave para aprovechar al máximo el potencial de estas herramientas radica en una adopción proactiva, una formación continua de los equipos y una visión estratégica centrada en la incorporación de tecnologías emergentes.

En MIOTI Tech & Business School sabemos que aquellas organizaciones que abracen esta revolución tecnológica y aprovechen al máximo las herramientas de IA estarán mejor preparadas para afrontar los desafíos del mercado actual y construir un futuro empresarial exitoso y sostenible. Por eso, con el short program Gen AI in Business, los alumnos obtienen una comprensión profunda de las capacidades y aplicaciones de la IA Generativa a través de sesiones teóricas y talleres prácticos. Con estas herramientas de inteligencia artificial en tu arsenal, tu negocio estará mejor equipado para afrontar los desafíos del mercado actual y adaptarse a un entorno empresarial en constante evolución. ¡Aprovecha el poder de la IA y lleva tu empresa al siguiente nivel de innovación y eficiencia!

El avance de la Inteligencia Artificial (IA) ha puesto sobre la mesa una serie de dilemas éticos que antes parecían ajenos. La capacidad de estas tecnologías para analizar enormes volúmenes de datos y tomar decisiones autónomas está revolucionando sectores enteros, desde la medicina hasta el marketing. Sin embargo, este poder también conlleva una gran responsabilidad. En este contexto, los Data Ethics, o ética de datos en español, se han convertido en un tema central, ya que es crucial asegurar que el uso de datos personales y sensibles se realice de manera justa y transparente. La preocupación por la privacidad y los derechos individuales está en su punto más alto, y las organizaciones deben estar a la altura de estas expectativas para no perder la confianza del público.

Para aquellos líderes y profesionales interesados en profundizar en la estrategia empresarial centrada en la inteligencia artificial y el manejo avanzado de datos, nuestro Máster en Data Strategy y Analytics, especializado en IA y Data ofrece una inmersión completa en la creación y gestión de estrategias empresariales fundamentadas en estas tecnologías desde un punto de vista ético y sostenible.

¿Qué son los Data Ethics?

Los Data Ethics son un conjunto de principios y prácticas que guían la recopilación, el uso, el almacenamiento y la distribución de datos de manera justa, transparente y responsable. Estos principios buscan proteger la privacidad de las personas, evitar el mal uso de los datos y promover la responsabilidad en el manejo de la información.

Su relevancia se hace evidente cuando se consideran los riesgos de un manejo irresponsable de los datos. Casos de violación de privacidad, decisiones discriminatorias basadas en algoritmos y la explotación de información sin consentimiento han subrayado la necesidad urgente de establecer normas éticas claras. Implementar prácticas éticas en el manejo de datos no solo protege a los individuos, sino que también fomenta una mayor equidad y justicia social. Además, al adherirse a los principios de Data Ethics, las organizaciones pueden mejorar su reputación y fortalecer la confianza del público.

En este sentido, este campo no solo es relevante para los profesionales de la tecnología, sino que es crucial para los altos cargos y líderes empresariales que toman decisiones estratégicas basadas en datos, una tendencia creciente que se terminará convirtiendo en la norma. La comprensión y aplicación de principios éticos en el manejo de estos datos puede ser un diferenciador clave para el éxito y la sostenibilidad de una organización.

Principios clave de los Data Ethics

Los principios del Data Ethics construyen los cimientos esenciales para garantizar que el uso de datos sea responsable, justo y beneficioso para todos los involucrados. Con el avance tecnológico, y la generalización de la IA, adherirse a estos principios básicos no solo es necesario, sino imperativo.

- Privacidad: Garantizar que la información personal se maneje de manera confidencial y segura. Esto implica implementar medidas robustas de protección de datos. La privacidad no solo protege a los individuos, sino que también fortalece la confianza en la organización que maneja los datos.

- Transparencia: Ser claro sobre cómo se recopilan, utilizan y comparten los datos. Las organizaciones deben proporcionar información accesible y comprensible sobre sus prácticas de manejo de datos.

- Responsabilidad: Asegurar que las organizaciones y las personas sean responsables de sus prácticas de manejo de datos. Esto incluye la implementación de políticas y procedimientos claros para ello, así como la asignación de responsabilidades específicas a individuos o equipos dentro de la organización.

- Equidad: Evitar el sesgo y la discriminación en la recopilación y el uso de datos para promover la justicia social. La equidad en el manejo de datos garantiza que todos los individuos sean tratados de manera justa y que los beneficios de la tecnología se distribuyan equitativamente.

- Consentimiento: Obtener el consentimiento informado de las personas cuyas datos se recopilan y utilizan. Esto significa que los individuos deben recibir información clara y completa sobre cómo se utilizarán sus datos y deben tener la opción de aceptar o rechazar dicha recopilación. El consentimiento informado respeta la autonomía de los individuos y la confianza en las prácticas de manejo de datos de la organización.

¿Cómo pueden los directivos aprovechar el poder de los Data Ethics?

Los Data Ethics son una herramienta poderosa para los directivos, ya que permiten construir y mantener la confianza en un mundo empresarial cada vez más centrado en los datos. La confianza es un activo intangible pero esencial, y su construcción se basa en la transparencia y el respeto hacia la privacidad de los clientes, empleados y socios comerciales. Al implementar prácticas éticas en el manejo de datos, los líderes empresariales pueden fortalecer estas relaciones, creando vínculos sólidos y duraderos que beneficien a la organización en múltiples frentes. Además, una reputación basada en la ética y la responsabilidad puede atraer a consumidores más conscientes y leales, así como a socios comerciales que valoran la integridad y la honestidad.

Aprovechar los Data Ethics como ventaja estratégica también implica garantizar el cumplimiento regulatorio y mitigar riesgos potenciales. Cumplir con normativas como el Reglamento General de Protección de Datos (GDPR) en Europa no solo evita sanciones legales y daños a la reputación, sino que también refleja un compromiso serio con prácticas empresariales responsables. Implementar principios éticos en el manejo de datos ayuda a prevenir brechas de seguridad y pérdida de confianza del cliente. Además, fomentar una cultura de innovación responsable permite que la organización se diferencie en el mercado, equilibrando la necesidad de innovar con la responsabilidad de proteger los datos de los usuarios. Esta combinación de cumplimiento, mitigación de riesgos e innovación ética contribuye a la sostenibilidad a largo plazo de la empresa.

Futuro de la sociedad de la mano de los Data Ethics

Con el crecimiento exponencial de la inteligencia artificial, la ética de los datos se está volviendo cada vez más crucial. Los desarrolladores deben abordar cuestiones como el sesgo algorítmico, la toma de decisiones automatizada y la transparencia en los modelos de IA para asegurar que estas tecnologías se desarrollen y utilicen de manera justa y responsable. Pero no son los únicos responsables. Los directivos, por su parte, deben garantizar que las aplicaciones de IA operan bajo principios éticos que protejan a los usuarios y que fortalezcan la confianza y la integridad en sus organizaciones. Este enfoque ético es esencial para evitar potenciales daños y asegurar que la IA beneficie a todos de manera equitativa.

La agricultura ha sido uno de los soportes principales de la economía y la civilización humana durante milenios y con la creciente población mundial, la necesidad de producir alimentos de manera eficiente y sostenible nunca ha sido más crucial. En este contexto, el Computer Vision -o visión por computadora en español- está emergiendo como una herramienta revolucionaria que puede transformar la agricultura moderna, aumentando la precisión, eficiencia y sostenibilidad de los procesos.

¿Qué es el Computer Vision?

La visión por computadora es una rama de la inteligencia artificial (IA) que permite a los ordenadores y sistemas interpretar y comprender el mundo visual a través del uso de algoritmos y modelos de aprendizaje automático para procesar y analizar imágenes y videos. En agricultura, esta tecnología se puede aplicar para monitorizar cultivos, gestionar recursos, automatizar tareas y mejorar la calidad del producto final.

Aplicaciones del Computer Vision en la agricultura

A pesar de que la agricultura y la tecnología son dos disciplinas que parecen provenir de mundos completamente opuestos, el enfoque innovador que trae consigo el Computer Vision permite interesantes aplicaciones para la agricultura como la monitorización exhaustiva de los cultivos o una gestión más eficiente de los recursos, entre otras. Todo ello con el objetivo de incrementar la productividad y sostenibilidad de la agricultura moderna.

Monitorización de cultivos y detección de enfermedades

A través del uso de drones equipados con cámaras multiespectrales, los agricultores pueden obtener imágenes detalladas de sus campos que posteriormente se analizan para identificar patrones y anomalías que puedan indicar problemas como plagas, enfermedades o estrés hídrico.

Por ejemplo, los algoritmos de visión por computadora pueden detectar cambios en el color de las hojas que podrían indicar una enfermedad antes de que sea visible a simple vista. Así, los agricultores pueden tomar medidas preventivas rápidamente, minimizando el uso de pesticidas y reduciendo las pérdidas de cultivos.

Gestión de recursos

El computer vision también es crucial para una gestión eficiente de los recursos como el agua y los fertilizantes. Mediante sensores y cámaras instalados en el campo es posible monitorizar el estado del suelo y las plantas en tiempo real y, con esta información, ajustar de forma automática los sistemas de riego y fertilización para proporcionar exactamente lo que los cultivos necesitan, ni más ni menos.

A través de este enfoque de precisión no solo optimiza el uso de recursos, sino que también minimiza el impacto ambiental de la agricultura, reduciendo la escorrentía de fertilizantes y el desperdicio de agua.

Automatización de cosechas

La automatización de la cosecha es otra área donde la visión por computadora está marcando una diferencia significativa. Los robots de cosecha equipados con cámaras y sensores pueden identificar y recoger frutas y verduras maduras con una precisión notable asegurando que los productos se cosechen en su punto óptimo de madurez.

Por ejemplo, los robots cosechadores de fresas pueden usar computer vision para distinguir entre fresas maduras y no maduras, asegurando que aquellas que están listas para su recogida se recolecten.

Clasificación y control de calidad

Después de la cosecha, el computer vision se utiliza para la clasificación y control de calidad de los productos agrícolas ya que las cámaras de alta resolución pueden inspeccionar las frutas y verduras para detectar defectos, daños o impurezas. Los algoritmos que utiliza esta tecnología pueden clasificar los productos según su tamaño, forma y color, asegurando que solo aquellos de mayor calidad lleguen a los consumidores finales. A través de este proceso automatizado se consigue también reducir costes ya que es más rápido y preciso que la inspección manual.

¿Qué ventajas aporta?

Como hemos visto, el computer vision puede transformar ampliamente la forma en que produce la agricultura actualmente hasta poder llegar a convertirse en una auténtica revolución. Además de aplicaciones concretas, también cuenta con múltiples beneficios.

Uno de los más notables es el aumento de la eficiencia y productividad ya que la visión por computadora permite a los agricultores monitorizar y gestionar sus campos con una precisión sin precedentes. Gracias a esta capacidad de identificación temprana de los problemas es posible optimizar el uso de recursos y, en consecuencia, obtener mayores rendimientos con menos insumos, lo que se traduce en una mayor eficiencia operativa.

Otra ventaja significativa es la reducción del impacto ambiental. Al optimizar el uso de agua, fertilizantes y pesticidas, el computer vision contribuye a minimizar el impacto ambiental de la agricultura consiguiendo por el camino beneficiar al medio ambiente y mejorar la sostenibilidad a largo plazo de las prácticas agrícolas.

Por otro lado, la capacidad de monitorizar y clasificar productos agrícolas con alta precisión asegura que los consumidores reciban productos de la más alta calidad consiguiendo no solo incrementar la satisfacción del cliente, sino también abrir nuevos oportunidades de mercado para los agricultores, quienes pueden ofrecer productos superiores y diferenciados.

Algunos desafíos para la agricultura

No obstante, y a pesar de contar con múltiples aplicaciones y ventajas, integrar esta tecnología en la explotación agraria diaria no está exento de desafíos, unos obstáculos que los agricultores deben superar para ser capaces de aprovechar al máximo el potencial que ofrece el computer vision.

Uno de esos retos es la considerable inversión inicial que es necesaria en equipo y tecnología, unos costes que pueden ser altos al principio pero que es posible recuperar con el tiempo gracias a la mejora en la eficiencia y la reducción de los gastos operativos.

Asimismo, el desarrollo y la implementación de soluciones de visión por computadora pueden ser técnicamente complejos y los agricultores podrían necesitar formación adicional o soporte técnico para conseguir utilizar estas tecnologías de manera efectiva. Es precisamente esta necesidad de formación y asistencia técnica la que puede representar un desafío, especialmente para aquellos que no están familiarizados con estas herramientas avanzadas.

Por otro lado, para que las soluciones de computer vision alcancen su máximo exponente y satisfagan las necesidades de forma satisfactoria es necesario adaptar los algoritmos y modelos a los diferentes tipos de cultivos y condiciones ambientales y a las necesidades específicas de cada agricultor. Este proceso de adaptación puede ser complicado y requerir un enfoque individualizado para cada tipo de cultivo y entorno.

En MIOTI Data & AI Services somos expertos en la conversión de las empresas desde un modelo tradicional hacia una forma de trabajar completamente Data-Driven, es decir, aquella en la que las compañías consiguen hacer realidad su estrategia de datos aplicando big data, inteligencia artificial e internet de las cosas. Así, las data-driven companies consiguen, de media, incrementar sus beneficios un 5% gracias a las mejoras operacionales consecuencia de la aplicación del análisis de datos.

¿Qué es Data Analytics?

Data Analytics o análisis de datos en español es el proceso de recopilar y analizar grandes cantidades de datos, con el objetivo de extraer unas conclusiones específicas. Utilizando las técnicas y las herramientas adecuadas, se pueden detectar patrones de comportamiento y tendencias, que agilizan la toma de decisiones y además las fundamenta. Por ello, cada vez más empresas utilizan el análisis de datos, convirtiéndose en una parte fundamental de su estrategia ya que les permite optimizar sus recursos y mejorar su rentabilidad, reduciendo costes.

En el caso de los negocios, por ejemplo, si se utiliza para analizar datos de los clientes puede suponer una mejora de su satisfacción o la capacidad de predecir tendencias de mercado. Si además combinan las técnicas de Data Analytics con las de Big Data, que proporciona la infraestructura y la capacidad para almacenar y procesar volúmenes de datos extremadamente complejos y grandes, obtendrán una ventaja competitiva respecto a sus competidores. El Data Analytics abarca gran cantidad de análisis, desde los más básicos como pueden ser la descriptiva y la diagnóstica hasta los más avanzados, como el predictivo o el prescriptivo. Dependiendo en qué área nos encontremos, pueden resultarnos más eficaz un tipo que otro. El sector de marketing, las finanzas o la logística, son algunos de los sectores que más rendimiento obtienen de estas prácticas.

Para las empresas, dominar estas técnicas es crucial para mantener una ventaja competitiva en el mercado actual. Con nuestro Máster en Data Strategy y Analytics, aprenderás las últimas arquitecturas y estructuras de datos y las herramientas de análisis más usadas, desde una perspectiva de negocio que aplica para un amplio rango de perfiles.

Tipos de Data Analytics

Según el tipo de análisis que se realice, obtendremos un tipo de información apropiada para al objetivo que se quiera conseguir. Por tanto, es fundamental identificar cuál se adecúa a las necesidades de cada negocio, en base a las conclusiones que se desean encontrar. Se podrían agrupar en cuatro tipos:

Descriptivo

El análisis descriptivo es el tipo más básico del Data Analytics. Se enfoca en describir y resumir datos históricos, patrones, y características clave de un conjunto de datos a través del uso de herramientas de estadística básica, como pueden ser la media o la desviación estándar, además de gráficos y tablas de resumen. Su objetivo es responder a la pregunta: “¿Qué ha pasado?”. Así, proporciona una visión general de las características principales de los datos, lo que facilita su interpretación y comunicación. Además, por su precisión, ayuda a identificar los posibles errores que pueda haber en un conjunto de datos.

Áreas como el marketing o la salud, lo utilizan para evaluar, por ejemplo, el rendimiento de campañas publicitarias o el tráfico de una web, y en el segundo caso, para analizar datos médicos y detectar patrones de enfermedades.

Diagnóstico

Este análisis va un paso más allá que el anterior, y no solo explica qué ha ocurrido, sino que se pregunta por qué. Tiene el objetivo de hacer un análisis en profundidad para comprender las razones de que se hayan observado ciertos patrones o se haya encontrado un problema por lo que se enfoca en identificar las causas subyacentes de ciertos eventos con el fin de comprender mejor el comportamiento de los datos y poder tomar medidas correctivas o preventivas. Utiliza técnicas como el análisis de correlación o de regresión, y es una gran ventaja para identificar factores de riesgo o predecir tendencias.

En el área de las finanzas, puede explicar el por qué de las pérdidas financieras, o en el caso de una fábrica, señalar las causas de defectos en la producción.

Predictivo

Como su nombre indica, se trata de predecir futuros resultados o comportamientos, en base a patrones y algoritmos. Mediante el uso de modelos de estadística es capaz de anticipar posibles escenarios y tomar así decisiones fundamentadas de forma que responde a la pegunta “¿Qué pasará en el futuro?”.

En este análisis se hace uso del Machine Learning, el conjunto de algoritmos de aprendizaje automático que identifican patrones complejos de datos y entre sus beneficios, se encuentra la optimización de los recursos, la mejora de la toma de decisiones, o la identificación de oportunidades. En áreas como finanzas puede predecir riesgos financieros o detectar fraudes, o en el caso de recursos humanos, ayudar a la contratación y la retención del talento.

Prescriptivo

Se trata de una técnica más avanzada dentro del campo de Data Analytics ya que recomienda acciones específicas con el fin de optimizar los futuros resultados. La pregunta que le correspondería responder sería “¿Qué estrategia debo seguir?”. A diferencia del análisis predictivo, que se centra en predecir eventos futuros, el análisis prescriptivo va un paso más allá al ofrecer recomendaciones sobre cómo actuar para alcanzar determinados objetivos. Implica el uso de la tecnología para ayudar a las empresas a tomar mejores decisiones a través del análisis del raw data, y técnicas como la simulación y ayuda a que se tomen decisiones más estratégicas, porque se tiene más información, además de un aprendizaje continuo. En logística, aporta la mejora de la planificación de la cadena de suministro o la gestión de los inventarios de forma eficiente.

Los Juegos Olímpicos de París 2024 están preparados para convertirse en uno de los eventos deportivos más vistos de la historia, con expectativas de superar los 3.000 millones de espectadores que sintonizaron los Juegos de Tokio 2020. Este fenómeno mediático va más allá del espectáculo de habilidades atléticas. Las Olimpiadas se han convertido en una celebración cultural que une a personas de diversas nacionalidades y antecedentes. Cada cuatro años, los espectadores siguen el evento en busca de historias humanas inspiradoras, disfrutando el espíritu de competición y la celebración de la excelencia deportiva. Es esta combinación la que crea una experiencia única que cautiva al mundo entero.

Pero la expectación en torno a los Juegos Olímpicos también radica en la curiosidad y el entusiasmo por saber qué naciones y atletas se llevarán las medallas. Con cada edición, surgen nuevas estrellas y se rompen récords, lo que añade un elemento de imprevisibilidad que mantiene a los espectadores al borde de sus asientos. En este contexto, la posibilidad de predecir los resultados con precisión se convierte en un atractivo adicional para los aficionados más entusiastas. Aquí es donde ahora entran al terreno de juego la Inteligencia Artificial (IA) y el Deep Learning (DL).

La capacidad de predicción de la Inteligencia Artificial

La IA y el Deep Learning han demostrado ser herramientas poderosas para el análisis predictivo en una gran variedad de campos. Esto es así gracias a su capacidad para procesar enormes cantidades de datos y encontrar patrones que serían invisibles para el ojo humano. En el ámbito deportivo, estas tecnologías ya se utilizan para analizar el rendimiento de los atletas, diseñar estrategias de juego y hasta para prevenir lesiones.

Para predecir los resultados de los Juegos Olímpicos, la IA puede analizar una amplia gama de datos, incluyendo estadísticas de rendimiento pasado, condiciones de salud de los atletas, tácticas de entrenamiento, y muchos otros factores. Estos datos se pueden alimentar en modelos de aprendizaje profundo, que pueden aprender a identificar patrones y hacer predicciones basadas en ellos.

Modelos de Deep Learning en el deporte

El Deep Learning es una subcategoría de la Inteligencia Artificial que se basa en redes neuronales artificiales con múltiples capas de procesamiento. Estos modelos son capaces de aprender de manera autónoma a partir de grandes volúmenes de datos sin necesidad de intervención humana constante. En el contexto de los deportes, los modelos de Deep Learning pueden analizar datos históricos de competiciones anteriores, datos biométricos de los atletas,

condiciones climáticas, y otros factores relevantes para intentar predecir los resultados.

Un ejemplo de esto es la aplicación de redes neuronales recurrentes (RNN) y redes neuronales convolucionales (CNN) en el análisis deportivo. Las RNN son particularmente útiles para analizar series temporales de datos, como las estadísticas de rendimiento de un atleta a lo largo del tiempo. Por otro lado, las CNN son eficaces para el análisis de imágenes y videos, lo que puede ser útil para evaluar la técnica y el rendimiento de los atletas en tiempo real.

Desafíos en la predicción deportiva

Aunque la IA y el Deep Learning tienen un gran potencial para la predicción deportiva, también existen numerosos desafíos. Uno de los principales es la variabilidad y la imprevisibilidad inherente del deporte. Los resultados deportivos pueden verse afectados por una multitud de factores impredecibles, como lesiones inesperadas, cambios en las condiciones climáticas, decisiones arbitrales, y la psicología de los atletas en el día de la competición.

Además, la calidad y la cantidad de los datos disponibles pueden variar significativamente. Mientras que algunos deportes y atletas tienen abundancia de datos históricos detallados, como puede ser el fútbol por su histórica popularidad, otros pueden tener datos más limitados o menos precisos. La falta de datos de alta calidad puede limitar la precisión de las predicciones de la Inteligencia Artificial.

Avances tecnológicos recientes

A pesar de los desafíos, los avances recientes en la tecnología de IA y Deep Learning están mejorando continuamente la precisión de las predicciones deportivas. Las técnicas de aprendizaje reforzado, donde los modelos de IA aprenden mediante prueba y error en un entorno simulado, están mostrando un gran potencial. Estos modelos pueden simular miles de escenarios diferentes y aprender qué estrategias son más efectivas para predecir los resultados.

Además, la integración de datos biométricos en tiempo real, como la frecuencia cardíaca, la temperatura corporal y otros indicadores fisiológicos, está permitiendo a los modelos de IA hacer predicciones más precisas. Estas tecnologías pueden proporcionar una visión detallada del estado físico y mental de los atletas, lo que es crucial para predecir su rendimiento en competencias de alto nivel.

Éxitos y fracasos previos en la predicción deportiva

En los últimos años, ha habido múltiples intentos de utilizar la IA para predecir los resultados de eventos deportivos, con resultados variados. En el fútbol, empresas como Google y Microsoft han implementado modelos de IA para prever los resultados de torneos importantes como la Copa del Mundo y la Premier League. Por ejemplo, Microsoft desarrolló un predictor de torneos de fútbol que utiliza una combinación de datos históricos y actuales para calcular probabilidades de victoria, aunque reconoce que las predicciones no siempre son precisas y pueden estar sujetas a errores notables.

Otro ejemplo es el uso de IA por Google DeepMind, que ha colaborado con el Liverpool FC para desarrollar TacticAI, un sistema que ofrece insights tácticos y predice resultados específicos de jugadas, como los tiros de esquina. Aunque TacticAI ha mostrado ser útil en proporcionar sugerencias tácticas precisas, la imprevisibilidad del fútbol añade un nivel de complejidad que limita la precisión absoluta de las predicciones.

Más cerca aún de la temática que ocupa este blog, un caso de estudio interesante fue el intento de predecir los resultados de los Juegos Olímpicos de 2016 en Río de Janeiro. Varias organizaciones emplearon modelos de IA para prever el medallero. Por ejemplo, el proveedor de datos Gracenote Sports utilizó un algoritmo que actualizaba continuamente las predicciones basadas en los resultados de competiciones recientes. Aunque lograron algunas predicciones acertadas, también hubo desviaciones notables debido a la complejidad de factores imprevistos como suspensiones de atletas.

Predicciones de la IA para los Juegos Olímpicos de 2024

Para los Juegos Olímpicos de París 2024, la misma compañía, Gracenote, ha vuelto a probar suerte en su intento por predecir el medallero. Según las proyecciones más recientes de su Virtual Medal Table (VMT), se espera que Estados Unidos lidere el medallero con un total de 112 medallas, seguido de China con 86 y Francia con 60. En cuanto a España, se prevé un desempeño sólido en los Juegos, aunque no se espera que esté en el top 10 en cuanto a la cantidad total de medallas. En total, se esperan dieciocho: Cinco de oro, cinco de plata y ocho de bronce.

Gracenote utiliza un algoritmo que toma en cuenta los resultados recientes de competiciones internacionales, el rendimiento histórico de los atletas y otros factores para elaborar sus predicciones. Este enfoque basado en datos permite ajustar las predicciones a medida que se acerca el evento y se disponen de más resultados recientes. La ausencia de muchos competidores de Rusia y Bielorrusia, debido a sanciones internacionales, también afecta estas proyecciones, añadiendo un elemento de incertidumbre para algunos países.

Ver esta publicación en Instagram

El futuro de esta tecnología en el deporte

Mirando hacia el futuro, es probable que la IA y el Deep Learning continúen desempeñando un papel cada vez más importante en el deporte. Con el continuo avance de la tecnología y la creciente disponibilidad de datos de alta calidad, las predicciones deportivas basadas en IA se volverán más precisas y confiables. Sin embargo, siempre habrá un elemento de incertidumbre y sorpresa en el deporte, que es parte de lo que lo hace tan emocionante.

Para los Juegos Olímpicos de 2024, es probable que veamos una mayor utilización de la IA en áreas como el análisis del rendimiento de los atletas, la planificación de estrategias y la predicción de resultados. Sin embargo, también es importante reconocer los límites de estas tecnologías y no depender únicamente de ellas para tomar decisiones. Los Juegos Olímpicos siempre serán un evento lleno de sorpresas y momentos inesperados, y aunque la IA puede ayudarnos a anticipar algunos de ellos, el espíritu humano y la competición seguirán siendo los factores decisivos.

Si estás interesado en explorar más a fondo cómo estas tecnologías pueden aplicarse en diversos campos, te invitamos a visitar el Máster en Inteligencia Artificial de MIOTI Tech & Business School. Este programa avanzado te permitirá aprender las bases de la ciencia de datos, desde el procesamiento hasta los principales algoritmos de analítica predictiva. Además, aplicarás las últimas técnicas de Machine Learning y Deep Learning, base para disciplinas como el análisis predictivo, reconocimiento de imágenes, voz y textos e Inteligencia Artificial Generativa.

Con el paso de los años, hemos visto cómo la tecnología táctil ha desplazado a los botones físicos, cómo los comandos de voz se han vuelto cada vez más precisos y cómo la realidad aumentada ha comenzado a abrir nuevas dimensiones en la interacción digital. La innovación tecnológica es un motor constante que está cambiando profundamente nuestra vida cotidiana, y muchas veces ni si quiera reparamos en ello. Este proceso continuo de cambio y mejora redefine nuestras experiencias y expectativas, ajustando sutilmente la forma en que vivimos, trabajamos y nos relacionamos. Aunque puede parecer que ya hemos visto todo, la verdad es que aún estamos en las etapas iniciales de explorar lo que la tecnología puede hacer. Hay un vasto territorio de posibilidades y descubrimientos que aún queda por explorar, prometiendo transformar aún más nuestra realidad de maneras que apenas podemos comenzar a imaginar.

En esta trayectoria, Google, el gigante tecnológico, ha marcado el próximo hito presentando Project Gameface, una tecnología revolucionaria que promete cambiar radicalmente la forma en que interactuamos con nuestros móviles. ¿Te imaginas controlar tu móvil con solo una mirada o una sonrisa? ¿Enviar un mensaje de texto o desplazarte por el feed de tus redes sociales tan solo con fruncir el ceño o parpadear?

¿Quién hay detrás de la idea de Project Gameface?

La inspiración detrás de Project Gameface proviene de una historia tanto conmovedora como poderosa, la de Lance Carr, un streamer de videojuegos cuadripléjico que vive con distrofia muscular. Esta enfermedad progresiva debilita los músculos, pero Lance se negó a permitir que sus limitaciones físicas lo alejaran de su pasión por los videojuegos. Utilizando un ratón controlado por movimientos de cabeza, Lance logró superar los obstáculos que su condición le presentaba, demostrando una resiliencia y determinación inquebrantables. Sin embargo, en 2021, un incendio en su hogar, transmitido en vivo a una audiencia global de gamers, le arrebató no solo su equipo de juego online sino también su valioso ratón de seguimiento de cabeza, esencial para su capacidad de jugar.

Movidos por la historia de Lance, el equipo detrás de Project Gameface se embarcó en un proyecto colaborativo con él para desarrollar un ratón de juego sin manos que utiliza soluciones de código abierto de Google MediaPipe. Este innovador dispositivo permite a los usuarios controlar el cursor del ordenador con movimientos de cabeza y gestos faciales, como levantar las cejas para hacer clic y arrastrar o abrir la boca para mover el cursor.

Al integrar la posibilidad de ajustar el tamaño del gesto, Project Gameface se adapta a las necesidades de una amplia gama de usuarios, garantizando que personas con diversas capacidades físicas puedan disfrutar del gaming. Ahora, en el marco del evento anual para desarrolladores Google I/O, la compañía anunciaba el lanzamiento de esta tecnología en Android, que ya está disponible para desarrolladores, con el objetivo de mejorar también la accesibilidad de cualquier persona que utilice este sistema operativo.

¿Cómo funciona Project Gameface?

En el corazón de Project Gameface se encuentra una implementación audaz de inteligencia artificial (IA) y aprendizaje automático a través de la API de MediaPipe de Google, una plataforma de procesamiento de medios cruzada y de código abierto diseñada específicamente para captar y procesar los movimientos faciales. Este sistema es capaz de identificar hasta 52 gestos faciales diferentes, lo que proporciona una gran versatilidad en la forma en que los usuarios pueden controlar sus dispositivos. Además, la disponibilidad del código en GitHub, un sitio web donde los desarrolladores pueden colaborar, compartir código y contribuir a proyectos de software, invita a los profesionales a explorar y adaptar esta tecnología a una amplia gama de aplicaciones, potencialmente ampliando su uso más allá de las funcionalidades básicas.

Sin embargo, Google no es el único gigante tecnológico que está explorando las vastas posibilidades de la tecnología en el ámbito de la accesibilidad. Apple, conocida por su enfoque en crear tecnologías que mejoren la vida de sus usuarios, también ha dado pasos significativos en este campo.

Eye tracking: Controlar los dispositivos con el movimiento de los ojos

Con el lanzamiento reciente de sus nuevos iPad Pro M4 e iPad Air M2 en España, Apple ha aprovechado la oportunidad para presentar una serie de funciones de accesibilidad, destacando entre ellas la innovadora función de Eye Tracking. Esta característica permite a los usuarios controlar sus dispositivos iPad e iPhone simplemente con el movimiento de sus ojos, marcando un avance importante en la accesibilidad y la interacción usuario-dispositivo.

La tecnología de Eye Tracking de Apple es particularmente notable por su implementación directa en los dispositivos, sin necesidad de hardware adicional. Esto es posible gracias al poder de la inteligencia artificial, que utiliza la cámara frontal para detectar y seguir la mirada del usuario, permitiéndole navegar por el sistema operativo y controlar diversas funcionalidades. Esta capacidad de calibración rápida y precisa, y el hecho de que toda la información recopilada se procesa localmente en el dispositivo, asegura una experiencia de usuario segura y privada. Además, Apple ha complementado Eye Tracking con otras funciones de accesibilidad, como Music Haptics, que utiliza el Taptic Engine para proporcionar a personas con problemas de audición o sordera una nueva forma de experimentar la música.

Riesgos de ciberseguridad asociados a las tecnologías de reconocimiento facial

No obstante, a pesar de los grandes beneficios que aportan estas tecnologías en materia de accesibilidad, la incorporación de soluciones como Project Gameface de Google y el Eye Tracking de Apple en dispositivos móviles plantea importantes consideraciones en materia de privacidad y seguridad. Al depender de la inteligencia artificial y el aprendizaje automático para interpretar gestos y movimientos faciales o del ojo, estos sistemas recopilan y procesan una cantidad significativa de datos biométricos sensibles que deben ser cuidados adecuadamente. Entre las principales consideraciones encontramos:

Procesamiento local vs. en la nube

El procesamiento de datos biométricos puede realizarse localmente en el dispositivo o en la nube, cada enfoque con sus propias implicaciones de seguridad. Apple ha destacado que su tecnología de seguimiento ocular procesa la información localmente en el dispositivo, lo que puede ofrecer una mayor seguridad y privacidad, ya que los datos no se transmiten a servidores externos. En contraste, si Google o cualquier otro desarrollador opta por procesar los datos en la nube, esto podría aumentar el riesgo de interceptación o acceso no autorizado a los datos personales. Para protegerlos, es esencial implementar medidas de seguridad robustas, incluyendo la encriptación de los datos biométricos tanto en tránsito como en reposo, garantizando así la protección de la información sensible de los usuarios.

Consentimiento y transparencia

La obtención de consentimiento y la transparencia son cruciales en el manejo de datos biométricos. Es esencial que los usuarios estén completamente informados sobre qué datos se recopilan, cómo se utilizan y con quién se comparten. Para ello, la obtención de un consentimiento explícito y la existencia de políticas de privacidad claras son fundamentales, garantizando así que los usuarios comprendan y acepten el uso de sus datos personales de manera informada y consciente.