Supercomputación, IA y talento: así se consolida España en el ámbito digital

En el siglo XXI, el poder de una nación no se mide solo por sus divisiones blindadas ni por el número de ojivas nucleares que pueda activar. En la actualidad, a los elementos tradicionales, se une el dominio de tecnologías emergentes, y en particular de la Inteligencia Artificial (IA), cada vez más determinante para proyectar influencia, asegurar ventajas estratégicas y reconfigurar los equilibrios globales.

La IA se ha convertido en un multiplicador de poder, tanto en el campo de batalla como en los bastidores de la diplomacia internacional. El conflicto en Ucrania, la creciente carrera tecnológica entre superpotencias y los debates internacionales sobre armas autónomas son solo algunos indicios de esta transformación.

El reconocimiento del potencial geopolítico de la IA no es nuevo. En 2017, Vladimir Putin advirtió que “quien se convierta en el líder en esta esfera se convertirá en el gobernante del mundo”. Esa afirmación, que podría haber parecido retórica, se ha convertido en una brújula estratégica para muchas naciones. Estados Unidos, China y Rusia lideran hoy una intensa carrera por la inteligencia artificial aplicada a la defensa, conscientes de que el liderazgo tecnológico puede traducirse en dominio geopolítico.

En Washington, la IA es ya una prioridad nacional. La Ley de Chips y Ciencia de 2022 canaliza ingentes recursos hacia la fabricación de semiconductores y el fortalecimiento del ecosistema tecnológico. El Departamento de Defensa, a través del AI Security Center, supervisa la integración segura y eficaz de la IA en sistemas militares. Su objetivo es mantener la superioridad tecnológica de EE. UU. en todos los dominios de la guerra, del ciberespacio al campo de batalla convencional.

Pekín, por su parte, ha definido un ambicioso horizonte, el de liderar globalmente en IA para 2030. La estrategia china combina desarrollo civil y militar bajo una lógica de fusión entre ambos ámbitos. El gobierno invierte en big data, computación cuántica y plataformas bélicas inteligentes, convencido de que la IA le permitirá sortear ciertas debilidades estructurales y ampliar su influencia global sin recurrir al enfrentamiento directo.

Rusia, aunque con menor capacidad presupuestaria, apuesta por la IA para modernizar su aparato militar. El Kremlin ha focalizado su desarrollo en áreas como visión por computadora y procesamiento del lenguaje, útiles para vigilancia, guerra electrónica y toma de decisiones automatizadas.

Junto a estas potencias, aliados regionales como Corea del Sur y Japón han empezado a integrar IA en sus estrategias defensivas. Desde programas como Army Tiger hasta sistemas de vigilancia marítima basados en algoritmos, su propósito es doble. Por un lado, reforzar la disuasión ante amenazas regionales y, por otro, posicionarse como socios tecnológicos clave en la arquitectura de seguridad liderada por EE. UU.

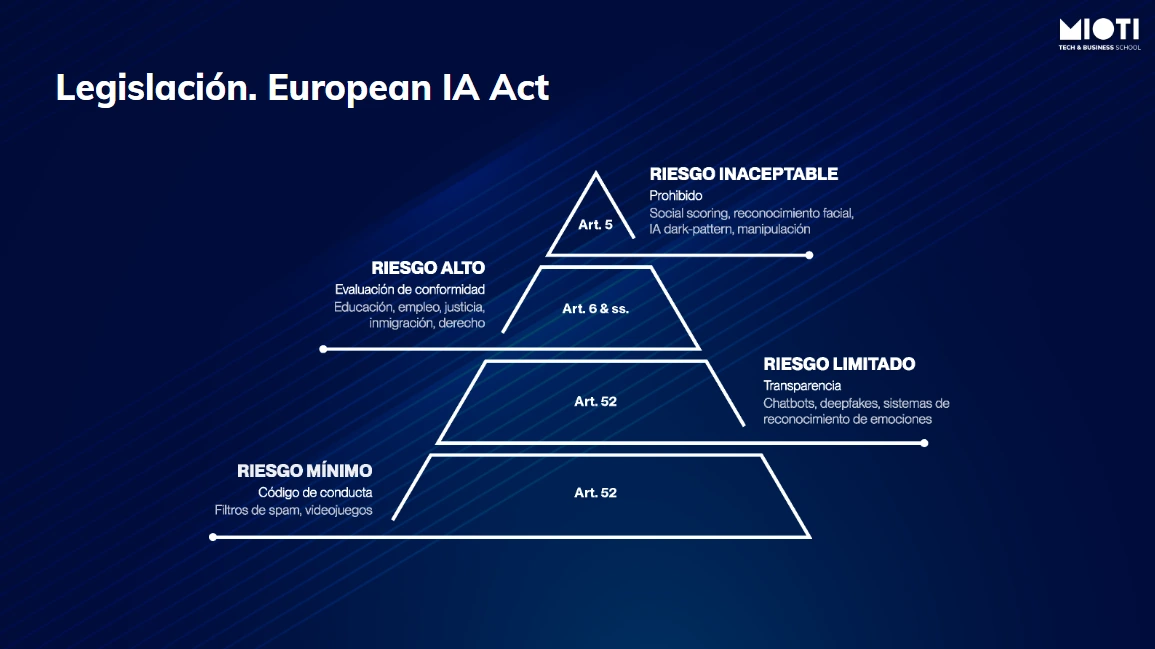

La Unión Europea, en cambio, ha adoptado una vía distinta: la regulatoria. Su Ley Europea de IA, pionera a nivel mundial, excluye expresamente las aplicaciones militares por competencia nacional, pero sienta las bases para un enfoque ético frente a los riesgos emergentes. Mientras las potencias apuestan por la supremacía, Europa se debate entre no quedar rezagada tecnológicamente y preservar su modelo de valores y derechos fundamentales.

El conflicto entre Rusia y Ucrania ha ofrecido un inquietante adelanto de la guerra del futuro. En él, la IA se ha convertido en una herramienta que redefine tácticas, estrategias y resultados.

Uno de los ejemplos más notorios es el uso de drones autónomos. En la Operación Telaraña de 2025, Ucrania desplegó enjambres de drones kamikaze que, gracias a algoritmos de navegación y reconocimiento visual, identificaron y atacaron blancos en territorio ruso sin necesidad de intervención humana directa. Por su parte, Rusia también ha utilizado drones con selección autónoma de objetivos, en una escalada tecnológica sin precedentes.

La IA ha sido clave, además, en el procesamiento de datos e inteligencia. Algoritmos analizan en tiempo real imágenes satelitales, señales interceptadas y movimientos de tropas, proporcionando a los comandantes decisiones más ágiles y fundamentadas. Esta capacidad de reducir la “niebla de guerra” representa una ventaja decisiva para quien logre dominarla.

Pero el campo de batalla no se limita al terreno físico. La guerra informativa ha encontrado en la IA un arma poderosa. Desde la creación de deepfakes hasta la propagación automática de desinformación, los algoritmos permiten influir en la moral del enemigo y manipular la opinión pública global. El deepfake de Zelenski anunciando una falsa rendición, difundido por hackers prorrusos en 2022, fue un hito, ya que inauguró la era de la desinformación algorítmica en conflictos armados.

En paralelo, la IA es protagonista en el ciberespacio. Herramientas inteligentes identifican intrusiones, predicen ataques y neutralizan amenazas en redes críticas. Sin embargo, esas mismas capacidades están al alcance de actores hostiles, lo que alimenta una carrera armamentística invisible entre ofensiva y defensa cibernética.

El despliegue militar de la IA plantea dilemas éticos inéditos. ¿Quién responde si un algoritmo se equivoca? Las armas autónomas letales (LAWS) desafían los principios tradicionales del Derecho Internacional Humanitario, basado en la proporcionalidad, la distinción de objetivos y la responsabilidad humana.

Un sistema de IA carece de empatía, contexto o juicio moral. No puede discernir si un enemigo herido ya no representa una amenaza o si un civil está siendo usado como escudo humano. Delegar decisiones de vida o muerte a algoritmos cuestiona la misma noción de guerra justa.

En este escenario, la respuesta internacional ha sido débil. En el marco de la Convención sobre Ciertas Armas Convencionales de la ONU, los Estados discuten desde hace más de ocho años sobre las LAWS sin alcanzar consenso. Las principales potencias se resisten a establecer límites vinculantes, lo que ha frenado la posibilidad de un tratado global.

Ante esta parálisis, la sociedad civil ha tomado la iniciativa. La campaña Stop Killer Robots, respaldada por ONG y figuras como la Nobel de la Paz Jody Williams, exige una prohibición preventiva de armas que operen sin supervisión humana. Aunque ha influido en la opinión pública, sus propuestas carecen aún de peso normativo.

Algunas organizaciones y países han dado pasos voluntarios. La OTAN adoptó en 2021 una Estrategia de IA basada en principios de legalidad, trazabilidad y responsabilidad. Países como Francia o EE. UU. han publicado directrices éticas para asegurar que siempre haya “control humano significativo” sobre las armas inteligentes. Corea del Sur y Países Bajos organizaron en 2023 la cumbre REAIM, que reunió a más de 50 países para debatir principios de uso responsable de la IA en defensa.

No obstante, estas iniciativas siguen siendo fragmentadas y sin fuerza legal vinculante. La falta de estándares comunes aumenta el riesgo de una carrera desregulada donde la prioridad sea la ventaja técnica, no el respeto al derecho ni a la dignidad humana.

La IA militar no solo plantea retos tácticos o éticos: también tiene implicaciones geoestratégicas y ambientales. El entrenamiento de modelos de IA consume enormes cantidades de energía y recursos, desde chips especializados hasta minerales raros, lo que puede generar nuevas dependencias internacionales. El control de estas cadenas de suministro, como el dominio de Taiwán en la fabricación de semiconductores, se convierte así en un factor crucial de seguridad.

Al mismo tiempo, la IA puede ser una aliada para optimizar recursos, reducir la huella logística de las operaciones militares o mejorar la planificación en contextos de escasez. Su doble uso, civil y militar, obliga a regulaciones más inteligentes y a doctrinas más flexibles, capaces de adaptarse a una realidad híbrida.

Con todo esto, la inteligencia artificial ha reconfigurado silenciosamente los fundamentos del poder militar y de la política internacional. Los algoritmos ya influyen en la forma en que se lucha, se decide, se comunica y se protege un Estado. Pero esta revolución tecnológica no es neutra: puede ser una herramienta de estabilización o una fuente de nuevos riesgos.

El desafío es doble. Por un lado, desarrollar capacidades defensivas legítimas que aprovechen el potencial de la IA sin deshumanizar la guerra. Por otro, construir marcos éticos, jurídicos y cooperativos que impidan su uso irresponsable o descontrolado. La historia demuestra que cada salto tecnológico en materia de armamento redefine las reglas del juego global. Esta vez, la diferencia es que el nuevo campo de batalla también es invisible, autónomo y veloz. Las decisiones que tomemos ahora sobre la IA militar marcarán la seguridad internacional durante décadas.