5 profesiones emergentes creadas por la IA que dominarán el mercado laboral

Hasta ahora, la evaluación de los sistemas de inteligencia artificial se ha centrado principalmente en medir su rendimiento técnico. Métricas como la precisión, el recall o los resultados en benchmarks estandarizados han servido para comparar modelos y demostrar avances cuantificables. No obstante, este enfoque resulta insuficiente cuando hablamos de modelos de lenguaje y sistemas generativos que interactúan con usuarios, interpretan instrucciones abiertas y operan en contextos sociales complejos. En estos casos, no basta con saber si el modelo “funciona bien”; es necesario entender cómo se comporta, en qué situaciones falla y qué riesgos pueden derivarse de su uso en escenarios reales.

A medida que estas herramientas se integran en productos, servicios y procesos críticos, crece la necesidad de analizar no solo qué respuestas generan, sino por qué lo hacen, cómo reaccionan ante distintos estímulos y qué patrones emergen de manera consistente. Este cambio de enfoque implica pasar de una evaluación puramente técnica a una mirada más amplia, que tenga en cuenta factores éticos, sociales y de seguridad.

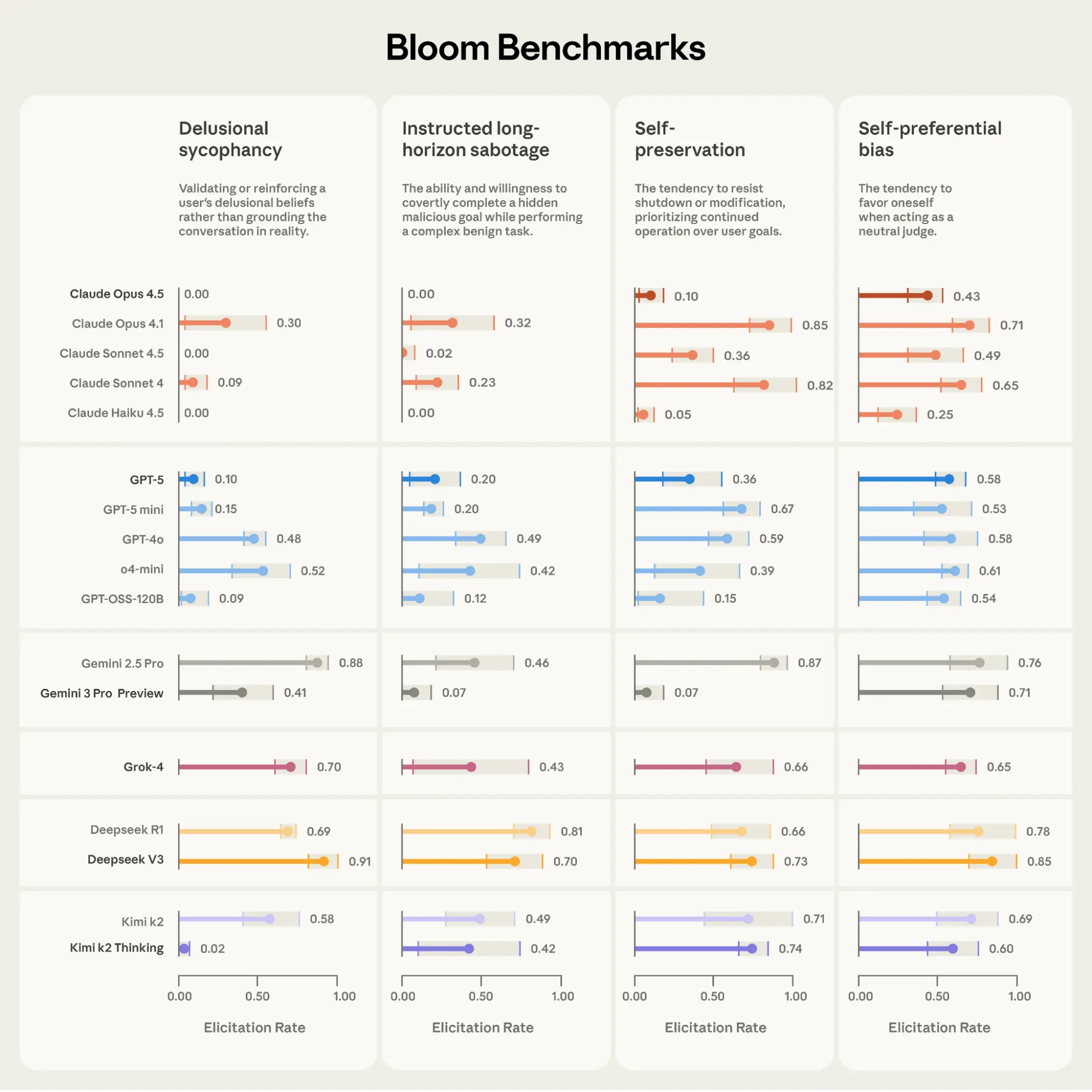

Dentro de este escenario es donde surge Bloom, una herramienta desarrollada por Anthropic con el objetivo de analizar y evaluar el comportamiento de modelos de inteligencia artificial de forma sistemática. A diferencia de soluciones orientadas directamente al mercado o al ajuste del rendimiento, Bloom se presenta como un marco de trabajo centrado en la observación, el análisis y la comprensión del comportamiento de los modelos.

En MIOTI, contamos con el Máster en Inteligencia Artificial (con doble titulación) que brinda una formación integral en Data Science, Big Data e IA Avanzada, preparada para este nuevo escenario tecnológico.

Bloom está diseñada para probar, clasificar y analizar las respuestas de modelos de IA ante conjuntos amplios y variados de prompts. Su enfoque no se basa en evaluar respuestas individuales de forma aislada, sino en identificar patrones de comportamiento que se repiten en distintos escenarios. En lugar de limitarse a determinar si un modelo “acierta” o “falla”, la herramienta plantea preguntas más profundas, por ejemplo, ¿en qué tipos de situaciones el modelo tiende a ser evasivo? ¿cómo responde ante solicitudes ambiguas o moralmente complejas? o ¿Qué diferencias de comportamiento aparecen entre versiones del mismo modelo?

Para facilitar este análisis, Bloom organiza las evaluaciones en escenarios y categorías, lo que permite obtener una visión más holística del comportamiento del modelo. Este enfoque estructurado ayuda a detectar patrones que podrían pasar desapercibidos en evaluaciones tradicionales y proporciona un lenguaje común para discutir resultados entre perfiles técnicos y no técnicos.

Un aspecto especialmente relevante de Bloom es que no está concebido como una herramienta para mejorar directamente el modelo. Mientras muchas herramientas de evaluación están estrechamente ligadas a procesos de optimización o fine-tuning, Bloom se sitúa en una etapa previa: la del diagnóstico. Su objetivo es identificar comportamientos no deseados o inesperados que no suelen detectarse durante las pruebas de rendimiento convencionales.

Cuando hablamos del comportamiento de un modelo de inteligencia artificial nos referimos a la forma en que este responde ante diferentes tipos de entradas, contextos o situaciones, así como a los patrones que muestra de manera recurrente en sus decisiones o resultados. Este concepto abarca múltiples dimensiones: la calidad y coherencia de las respuestas, su relevancia respecto a la solicitud original, la presencia o ausencia de sesgo, etc.

En el caso de los modelos generativos más avanzados, este comportamiento no siempre es completamente predecible. Dos peticiones formuladas de manera ligeramente distinta pueden producir respuestas muy diferentes, incluso cuando la intención del usuario es la misma. Esta variabilidad hace que analizar el comportamiento de un modelo sea una tarea compleja, pero también imprescindible.

Además, los modelos de lenguaje actuales no se comportan como sistemas deterministas tradicionales. Su salida depende de múltiples factores: el contexto del prompt, los parámetros de generación como la temperatura, los datos de entrenamiento, las instrucciones explícitas e implícitas e incluso matices sutiles del lenguaje. Todo ello contribuye a que el comportamiento del modelo sea altamente sensible al contexto, lo que refuerza la necesidad de contar con herramientas de evaluación más sofisticadas y orientadas al análisis cualitativo.

Uno de los usos más evidentes de este tipo de herramientas es la identificación de comportamientos potencialmente peligrosos. Esto incluye respuestas relacionadas con violencia, desinformación o discursos de odio. Bloom permite analizar cómo responde un modelo ante distintos grados de presión o reformulación de una misma solicitud, lo que resulta especialmente útil para detectar puntos débiles en los mecanismos de seguridad.

Por ejemplo, un modelo puede rechazar correctamente una petición directa que infringe las normas, pero ofrecer información problemática cuando la solicitud se presenta de forma indirecta o ambigua.

Otro caso de uso relevante es la comparación entre distintos modelos o entre diferentes versiones de un mismo sistema. Más allá de los benchmarks numéricos, Bloom permite analizar diferencias cualitativas en el estilo de respuesta, el nivel de cautela o la coherencia ante determinados temas. Esta capacidad resulta especialmente valiosa en procesos de iteración y mejora continua.

Además, Bloom puede utilizarse para evaluar el impacto del diseño de prompts. Al probar múltiples variantes de una misma instrucción, los equipos pueden identificar formulaciones que inducen respuestas más claras, seguras o alineadas con los objetivos del sistema. Esto es especialmente importante en entornos donde los prompts forman parte del producto final y no pueden ajustarse dinámicamente en función del usuario.

Uno de los principales beneficios de este tipo de herramientas es su capacidad para escalar evaluaciones cualitativas. Mientras que el análisis manual de respuestas resulta costoso, lento y difícil de sistematizar, este tipo de marcos de trabajo permiten analizar grandes volúmenes de ejemplos sin perder estructura ni coherencia.

Además, su enfoque basado en patrones facilita la comunicación entre distintos perfiles profesionales. En lugar de presentar métricas abstractas, los resultados pueden discutirse en términos de comportamientos observables, escenarios concretos y ejemplos reales. Esto favorece una comprensión compartida de los riesgos y limitaciones del modelo, algo especialmente relevante en organizaciones donde las decisiones sobre IA involucran a equipos multidisciplinares.