El uso del Big Data se ha convertido en un gran aliado del sector turismo en su transformación digital, revolucionando las estrategias de marketing y mejorando la experiencia del cliente gracias a los modelos predictivos y recomendaciones personalizadas. La optimización de los procesos internos de las empresas turísticas y la comunicación con el cliente para la gestión de los destinos es un pilar estratégico fundamental para el presente y futuro de un sector que experimenta cada vez mayor demanda y unos precios muy competitivos.

Con nuestro Máster en Data Science y Big Data aprenderás desde la captura y almacenamiento del dato con tecnologías Big Data, hasta el análisis avanzado en Python, Machine Learning y MLOps.

¿Qué oportunidades ofrece el Big Data en el sector turismo?

El Big Data se encarga de recopilar, almacenar, procesar y analizar grandes volúmenes de datos que provienen de distintas fuentes, pueden estar estructurados o no, que permite tomar decisiones casi a tiempo real para la resolución de problemas y la implementación de estrategias que mejoren los resultados. Esta herramienta ofrece una variedad de oportunidades que permiten una gestión más eficiente, personalizada y estratégica con datos basados directamente en el propio consumidor y su comportamiento a la hora de elegir un destino vacacional:

Conocimiento profundo del turista

El análisis de reservas, búsquedas online, ubicación, geolocalización, redes sociales, encuestas u otros datos relacionados con los destinos como el clima son clave para identificar el perfil de los viajeros y conocer sus comportamientos de viaje, así como detectar los patrones de consumo según la temporada del año. Esto permite diseñar productos que se ajusten a la demanda estacional y la opinión del cliente, planificando con mayor conciencia los servicios ofertados.

Mejor toma de decisiones

Con los datos procesados, las empresas y destinos turísticos pueden basarse en datos reales y actualizados para la mejora en recomendaciones, planificación, oferta y diseño de productos y servicios en torno al turismo. Esto permite la reducción de costes y una mayor eficiencia en procesos como la planificación de campañas de marketing, inversiones en infraestructuras y servicios deseados por los clientes y la gestión de recursos humanos y logísticos según la demanda prevista.

Personalización

La personalización de la experiencia es posible gracias al conocimiento sobre sus preferencias y necesidades, aumentando su satisfacción y la fidelidad hacia la empresa elegida. Sugerencias sobre gastronomía, alojamiento y actividades turísticas son de gran ayuda para asegurar un exitoso proceso de compra y una posible buena reseña a otros consumidores o en redes sociales, generando mayor interés.

Predicción de la demanda

Adelantarse a las fechas con mayor pico turístico, los destinos más demandados y el comportamiento de los viajeros según eventos, fenómenos u otras cuestiones sociales permiten la planificación y una rápida adaptación a los posibles cambios experimentados en el sector.

Monitorización de resultados

La revisión de opiniones, comentarios y reseñas permite mejorar la calidad de los servicios ofertados y corregir los fallos con el fin de aumentar la satisfacción y la reputación del sector.

Las empresas que utilizan esta tecnología para el seguimiento de sus resultados, el conocimiento del mercado y la toma de decisiones informadas proporciona una clara ventaja competitiva, diferenciándose del resto y captando y fidelizando a un mayor número de clientes que confíen en sus servicios.

Smart cities: El futuro del turismo urbano

Otra de las grandes ventajas que ofrece el Big Data respecto al sector turismo es el desarrollo de las conocidas como Smart Cities, o ciudades inteligentes. Durante los últimos años desafíos como el crecimiento poblacional, la contaminación, la congestión de tráfico y una demanda creciente de servicios públicos y eficientes ha surgido la necesidad de integrar tecnologías que mejoren la calidad de vida de sus habitantes, optimizando los recursos y optando por soluciones sostenibles.

La combinación de Smart Cities y el Big Data permite desarrollar un entorno urbano más eficiente y centrado en las personas, basándose en los datos para la toma de decisiones y la implementación de recursos que permitan gestionar el tráfico, garanticen la eficiencia energética, la sostenibilidad ambiental y una mayor conectividad, entre algunas de las ventajas. Estos beneficios resultan muy útiles para una buena planificación urbana de destinos con altos flujos turísticos, prometiendo espacios conectados y sostenibles, con tecnologías que integran y facilitan a los visitantes su estancia.

En 2024 cuatro ciudades españolas, Bilbao, Madrid, Zaragoza y Barcelona, se posicionaron entre las 142 ciudades más inteligentes y sostenibles del mundo en el ranking Smart City Index 2024 de IMD. Zonas verdes, buen transporte público y la preocupación por el funcionamiento de espacios públicos, sanitarios y actividades culturales son algunos de los avances que las han colocado en esta clasificación. Con la ayuda del Big Data serán cada vez más las ciudades que puedan implementar estas facilidades y convertirse en un gran atractivo turístico, sin aumentar los riesgos medioambientales y una rápida actuación ante posibles crisis.

Casos de éxito en el turismo digital: Airbnb, Booking e Iberia

Son varias las empresas que han implementado con éxito el Big Data como parte de su estrategia empresarial para la mejora de sus servicios y posicionarse entre las favoritas de los viajeros. Uno de los más conocidos es el caso de Airbnb, gracias a sus algoritmos de aprendizaje automático y el análisis de sus reservas, valoraciones y el comportamiento de los usuarios tiene la capacidad de personalizar las búsquedas, mejorar la experiencia de usuario y ofrecer a sus clientes precios muy atractivos para sus vacaciones.

Otra plataforma con gran reconocimiento que ha focalizado los datos como una parte fundamental de su negocio es Booking. En colaboración con la plataforma Beyond, los anfitriones de los alojamientos pueden adelantarse a las predicciones del mercado para la toma de decisiones adecuadas y aumentar el número de reservas y sus ingresos.

La aerolínea española Iberia también se ha sumado a esta tendencia, integrando el Big Data y la inteligencia artificial para la reducción de costes y la optimización de sus operaciones. Gracias a los datos analizan en tiempo real las predicciones meteorológicas, operacionales y de ocupación para ajustar rutas, comunicación personalizada con los pasajeros y un chatbot que ofrece recomendaciones basadas en las preferencias de los clientes para una experiencia completa.

Nuestra excelencia educativa ha sido reconocida por la prestigiosa revista Forbes. Nos ha incluido en su Lista de Mejores Escuelas de Negocios de España 2025 por primera vez.

Dentro del ranking, se destaca especialmente nuestro programa MIT Management & Leadership Executive Program. Es una experiencia inmersiva de una semana desarrollada en colaboración con el MIT Sloan School of Management, en su campus situado en Kendall Square, la milla cuadrada más innovadora del mundo, y con visitas a sus centros de innovación. Reúne a directivos de diversos continentes. Así, potencia sus capacidades de liderazgo en un entorno global, innovador y tecnológicamente avanzado.

Nuestros alumnos ocupan posiciones de liderazgo en compañías referentes como McDonald’s, Mahou San Miguel o Banco Santander, entre muchas otras. Además, el profesorado del programa está compuesto por líderes mundiales y expertos internacionales en Inteligencia Artificial, estrategia, innovación y economía, como el director académico del programa, Roberto Rigobón, que trasladan al aula la visión más actual sobre los desafíos de la empresa en esta era digital.

En este sentido, Alberto Toquero, Director General de Mahou San Miguel, destacó que la semana en el MIT Management & Leadership Executive Program supuso “una intensa inmersión en la revolución transformadora que estamos viviendo, impulsada por la evolución exponencial de la tecnología”.

Según explicó, la experiencia permitió extraer numerosas ideas y reflexiones, además de una fuerte motivación para aplicar en la compañía conceptos que fortalezcan su liderazgo. Al mismo tiempo, subrayó la calidad del grupo de profesionales con el que compartieron el programa: “Directivos de primer nivel de distintos sectores y tamaños de empresa, que enriquecieron los debates, aportaron perspectivas complementarias y elevaron la calidad global de la experiencia”.

Un espejo de nuestro ADN

Este reconocimiento refleja las señas de identidad de MIOTI:

- Una metodología 100% práctica, orientada al impacto real en las empresas.

- El respaldo académico como partner estratégico y créditos oficiales del MIT.

- Una oferta formativa que abarca desde programas ejecutivos hasta másteres especializados en Inteligencia Artificial, Data Science, Cloud Engineering y Digital Business.

“Ser reconocidos por Forbes entre las mejores escuelas de negocios de España es una confirmación del trabajo que venimos realizando desde el inicio: diseñar una formación innovadora y transformadora que conecte la tecnología con la empresa. Nuestra alianza con el MIT, junto con la confianza de nuestros alumnos y partners corporativos, nos impulsan a seguir liderando la formación de los profesionales que marcarán el futuro de este nuevo paradigma global”, destaca nuestra CEO y cofundadora, Fabiola Pérez.

Con este nuevo logro, en MIOTI reafirmamos nuestro compromiso con la excelencia académica. Además, con la preparación de líderes capaces de afrontar los retos de la era digital.

La llegada de la Inteligencia Artificial Generativa (IAG) ha marcado un antes y un después en el mundo de la programación y el desarrollo de software. Lo que antes era una disciplina reservada a quienes dominaban lenguajes y algoritmos, ahora es un espacio donde la colaboración entre humanos y máquinas redefine la creatividad y la productividad. Pero, ¿de qué manera concreta está impactando la IAG en nuestra forma de programar? ¿Qué competencias nuevas están surgiendo y cómo podemos aprovechar al máximo esta revolución?

Si quieres dominar la IA Generativa para transformar la forma en que programas, automatizas procesos y optimizas el desarrollo, nuestro Curso de Inteligencia Artificial para Desarrolladores te enseñará a aplicar IA en entornos IT con herramientas clave para potenciar la productividad y eficiencia.

El arte de comunicarse con la IA: el auge del Prompt Engineering

Uno de los cambios más significativos que ha traído consigo la IAG es la aparición del Prompt Engineering o ingeniería de instrucciones. Antes, interactuar con una máquina requería conocer comandos precisos o lenguajes de programación específicos. Hoy, gracias a modelos como GPT-5, podemos dialogar con la inteligencia artificial usando lenguaje natural. Sin embargo, la clave está en saber cómo formular esas instrucciones para obtener los mejores resultados.

La calidad de las respuestas que ofrece la IAG depende, en gran medida, de cómo formulamos nuestras preguntas o directrices. Por ejemplo, si necesitas que la IA genere una función en Python para validar correos electrónicos, obtendrás una solución mucho más precisa si detallas tus requisitos (como el tipo de validación, los posibles errores o ejemplos de uso) en el prompt, en vez de pedir simplemente “una función para validar emails”. Este nuevo arte de comunicarse con la IA requiere claridad, contexto y capacidad de iterar hasta alcanzar el resultado deseado.

El prompt engineering se está consolidando como una habilidad esencial para programadores y analistas, permitiendo extraer el máximo potencial de las herramientas de inteligencia artificial generativa y garantizando que las soluciones ofrecidas sean útiles, relevantes y adaptadas a cada necesidad.

La automatización como motor de productividad en IT

La IAG no solo ayuda a escribir código, sino que también está transformando la automatización de procesos IT. Las tareas rutinarias, como la generación de documentación, la gestión de incidencias o la integración de sistemas, están siendo cada vez más gestionadas por soluciones basadas en IA, lo que permite a los equipos de tecnología enfocarse en labores estratégicas y creativas.

Hoy en día, herramientas potentes como GitHub Copilot permiten autocompletar código, sugerir mejoras y hasta crear documentación técnica de forma automática. Esto no solo ahorra tiempo, sino que también contribuye a mantener altos estándares de calidad y coherencia a lo largo de los proyectos. En el ámbito de la gestión de datos, la IAG facilita la limpieza, integración y transformación de información, ayudando a detectar inconsistencias y optimizando los flujos de trabajo.

Además, la automatización inteligente basada en IA está revolucionando los pipelines de desarrollo y despliegue. Ahora, la IA puede analizar infraestructuras, identificar cuellos de botella y sugerir ajustes automáticos en recursos cloud, lo que se traduce en mayor eficiencia y menores costos operativos.

Programar con inteligencia artificial: más allá del autocompletado

Pero la influencia de la IAG en la programación va mucho más allá del simple autocompletado de código. Hoy, los desarrolladores pueden apoyarse en modelos como GPT para generar funciones completas, corregir errores y refactorizar código con solo describir el problema en lenguaje natural. Esta capacidad agiliza enormemente el ciclo de desarrollo y reduce los errores humanos.

Por ejemplo, si te enfrentas a un error difícil de localizar en tu código JavaScript, puedes compartir el bloque problemático y el mensaje de error con la IA, pidiéndole que lo corrija y explique el motivo del fallo. No solo obtendrás una solución, sino también una explicación didáctica, lo que contribuye a tu aprendizaje continuo.

Este enfoque asistido por IA permite a los programadores centrarse en la lógica y la arquitectura de sus proyectos, delegando tareas tediosas o repetitivas en la inteligencia artificial. El resultado es un desarrollo más ágil, colaborativo y de mayor calidad, con menor riesgo de errores críticos en producción.

Colaboración aumentada: chatbots inteligentes y equipos más conectados

La colaboración en el ámbito del desarrollo de software también se ha visto impactada positivamente por la integración de la IAG en plataformas como Microsoft Teams, Slack o Discord. Crear chatbots inteligentes que asistan a los equipos en tiempo real ya es una realidad accesible gracias a las APIs de OpenAI y otras soluciones similares.

Estos chatbots no solo responden preguntas técnicas o generan reportes automáticos, sino que pueden integrarse con bases de datos internas, sistemas de tickets o dashboards de seguimiento. Así, los equipos acceden a información centralizada y pueden automatizar tareas frecuentes, desde la gestión de incidencias hasta la generación de scripts personalizados.

El principal beneficio de estos asistentes inteligentes es que agilizan la comunicación, resuelven dudas comunes y permiten escalar la atención sin incrementar la carga humana. Esto es especialmente útil en áreas de soporte técnico, onboarding de nuevos miembros o atención a usuarios internos, donde la rapidez y precisión son claves.

Para sacar el máximo provecho de este tipo de integración, es recomendable identificar las necesidades prioritarias del equipo, diseñar flujos conversacionales claros y capacitar a los usuarios en el uso de estos nuevos recursos digitales.

Ciencia de datos y Machine Learning: democratización y eficiencia con IAG

El impacto de la IAG no se limita al desarrollo de software tradicional; también está transformando el mundo de la ciencia de datos y el Machine Learning. Antes, entrenar modelos predictivos requería experiencia avanzada en estadística, programación y matemáticas. Hoy, la inteligencia artificial generativa puede asistir en cada fase del proceso, desde la limpieza de datos hasta la selección de algoritmos y la visualización de resultados.

Por ejemplo, si tienes un conjunto de datos y quieres predecir tendencias de ventas, puedes pedirle a la IA que sugiera un flujo de trabajo en Python, incluyendo el análisis exploratorio, la selección del modelo y la generación de gráficos interpretativos. La IA generará no solo el código necesario, sino también explicaciones y recomendaciones sobre las mejores prácticas en herramientas como Scikit-learn o Pandas.

Este tipo de asistencia democratiza el acceso a la ciencia de datos, permitiendo que perfiles no especializados puedan experimentar, aprender y aportar valor a sus organizaciones. Eso sí, sigue siendo fundamental revisar y validar los resultados antes de aplicar soluciones en entornos productivos.

Nuevos desafíos y oportunidades para los programadores

La integración de la IAG en la programación plantea nuevos desafíos, pero también abre un abanico de oportunidades. Por un lado, los programadores deben desarrollar habilidades en prompt engineering, automatización y colaboración con IA. Por otro, tienen la oportunidad de enfocarse en tareas de mayor valor, como la arquitectura de sistemas, la resolución creativa de problemas y el diseño de experiencias digitales más humanas.

Además, la ética y la responsabilidad en el uso de inteligencia artificial cobran una relevancia especial. Es fundamental revisar el código generado por la IA, garantizar la privacidad de los datos y evaluar los posibles sesgos en los modelos utilizados.

En el siglo XXI, el poder de una nación no se mide solo por sus divisiones blindadas ni por el número de ojivas nucleares que pueda activar. En la actualidad, a los elementos tradicionales, se une el dominio de tecnologías emergentes, y en particular de la Inteligencia Artificial (IA), cada vez más determinante para proyectar influencia, asegurar ventajas estratégicas y reconfigurar los equilibrios globales.

La IA se ha convertido en un multiplicador de poder, tanto en el campo de batalla como en los bastidores de la diplomacia internacional. El conflicto en Ucrania, la creciente carrera tecnológica entre superpotencias y los debates internacionales sobre armas autónomas son solo algunos indicios de esta transformación.

La IA como eje de supremacía estratégica

El reconocimiento del potencial geopolítico de la IA no es nuevo. En 2017, Vladimir Putin advirtió que “quien se convierta en el líder en esta esfera se convertirá en el gobernante del mundo”. Esa afirmación, que podría haber parecido retórica, se ha convertido en una brújula estratégica para muchas naciones. Estados Unidos, China y Rusia lideran hoy una intensa carrera por la inteligencia artificial aplicada a la defensa, conscientes de que el liderazgo tecnológico puede traducirse en dominio geopolítico.

En Washington, la IA es ya una prioridad nacional. La Ley de Chips y Ciencia de 2022 canaliza ingentes recursos hacia la fabricación de semiconductores y el fortalecimiento del ecosistema tecnológico. El Departamento de Defensa, a través del AI Security Center, supervisa la integración segura y eficaz de la IA en sistemas militares. Su objetivo es mantener la superioridad tecnológica de EE. UU. en todos los dominios de la guerra, del ciberespacio al campo de batalla convencional.

Pekín, por su parte, ha definido un ambicioso horizonte, el de liderar globalmente en IA para 2030. La estrategia china combina desarrollo civil y militar bajo una lógica de fusión entre ambos ámbitos. El gobierno invierte en big data, computación cuántica y plataformas bélicas inteligentes, convencido de que la IA le permitirá sortear ciertas debilidades estructurales y ampliar su influencia global sin recurrir al enfrentamiento directo.

Rusia, aunque con menor capacidad presupuestaria, apuesta por la IA para modernizar su aparato militar. El Kremlin ha focalizado su desarrollo en áreas como visión por computadora y procesamiento del lenguaje, útiles para vigilancia, guerra electrónica y toma de decisiones automatizadas.

Junto a estas potencias, aliados regionales como Corea del Sur y Japón han empezado a integrar IA en sus estrategias defensivas. Desde programas como Army Tiger hasta sistemas de vigilancia marítima basados en algoritmos, su propósito es doble. Por un lado, reforzar la disuasión ante amenazas regionales y, por otro, posicionarse como socios tecnológicos clave en la arquitectura de seguridad liderada por EE. UU.

La Unión Europea, en cambio, ha adoptado una vía distinta: la regulatoria. Su Ley Europea de IA, pionera a nivel mundial, excluye expresamente las aplicaciones militares por competencia nacional, pero sienta las bases para un enfoque ético frente a los riesgos emergentes. Mientras las potencias apuestan por la supremacía, Europa se debate entre no quedar rezagada tecnológicamente y preservar su modelo de valores y derechos fundamentales.

La Inteligencia Artificial en la guerra real

El conflicto entre Rusia y Ucrania ha ofrecido un inquietante adelanto de la guerra del futuro. En él, la IA se ha convertido en una herramienta que redefine tácticas, estrategias y resultados.

Uno de los ejemplos más notorios es el uso de drones autónomos. En la Operación Telaraña de 2025, Ucrania desplegó enjambres de drones kamikaze que, gracias a algoritmos de navegación y reconocimiento visual, identificaron y atacaron blancos en territorio ruso sin necesidad de intervención humana directa. Por su parte, Rusia también ha utilizado drones con selección autónoma de objetivos, en una escalada tecnológica sin precedentes.

La IA ha sido clave, además, en el procesamiento de datos e inteligencia. Algoritmos analizan en tiempo real imágenes satelitales, señales interceptadas y movimientos de tropas, proporcionando a los comandantes decisiones más ágiles y fundamentadas. Esta capacidad de reducir la “niebla de guerra” representa una ventaja decisiva para quien logre dominarla.

Pero el campo de batalla no se limita al terreno físico. La guerra informativa ha encontrado en la IA un arma poderosa. Desde la creación de deepfakes hasta la propagación automática de desinformación, los algoritmos permiten influir en la moral del enemigo y manipular la opinión pública global. El deepfake de Zelenski anunciando una falsa rendición, difundido por hackers prorrusos en 2022, fue un hito, ya que inauguró la era de la desinformación algorítmica en conflictos armados.

En paralelo, la IA es protagonista en el ciberespacio. Herramientas inteligentes identifican intrusiones, predicen ataques y neutralizan amenazas en redes críticas. Sin embargo, esas mismas capacidades están al alcance de actores hostiles, lo que alimenta una carrera armamentística invisible entre ofensiva y defensa cibernética.

Riesgos éticos y vacíos legales

El despliegue militar de la IA plantea dilemas éticos inéditos. ¿Quién responde si un algoritmo se equivoca? Las armas autónomas letales (LAWS) desafían los principios tradicionales del Derecho Internacional Humanitario, basado en la proporcionalidad, la distinción de objetivos y la responsabilidad humana.

Un sistema de IA carece de empatía, contexto o juicio moral. No puede discernir si un enemigo herido ya no representa una amenaza o si un civil está siendo usado como escudo humano. Delegar decisiones de vida o muerte a algoritmos cuestiona la misma noción de guerra justa.

En este escenario, la respuesta internacional ha sido débil. En el marco de la Convención sobre Ciertas Armas Convencionales de la ONU, los Estados discuten desde hace más de ocho años sobre las LAWS sin alcanzar consenso. Las principales potencias se resisten a establecer límites vinculantes, lo que ha frenado la posibilidad de un tratado global.

Ante esta parálisis, la sociedad civil ha tomado la iniciativa. La campaña Stop Killer Robots, respaldada por ONG y figuras como la Nobel de la Paz Jody Williams, exige una prohibición preventiva de armas que operen sin supervisión humana. Aunque ha influido en la opinión pública, sus propuestas carecen aún de peso normativo.

Algunas organizaciones y países han dado pasos voluntarios. La OTAN adoptó en 2021 una Estrategia de IA basada en principios de legalidad, trazabilidad y responsabilidad. Países como Francia o EE. UU. han publicado directrices éticas para asegurar que siempre haya “control humano significativo” sobre las armas inteligentes. Corea del Sur y Países Bajos organizaron en 2023 la cumbre REAIM, que reunió a más de 50 países para debatir principios de uso responsable de la IA en defensa.

No obstante, estas iniciativas siguen siendo fragmentadas y sin fuerza legal vinculante. La falta de estándares comunes aumenta el riesgo de una carrera desregulada donde la prioridad sea la ventaja técnica, no el respeto al derecho ni a la dignidad humana.

Más allá del campo de batalla: impacto estructural

La IA militar no solo plantea retos tácticos o éticos: también tiene implicaciones geoestratégicas y ambientales. El entrenamiento de modelos de IA consume enormes cantidades de energía y recursos, desde chips especializados hasta minerales raros, lo que puede generar nuevas dependencias internacionales. El control de estas cadenas de suministro, como el dominio de Taiwán en la fabricación de semiconductores, se convierte así en un factor crucial de seguridad.

Al mismo tiempo, la IA puede ser una aliada para optimizar recursos, reducir la huella logística de las operaciones militares o mejorar la planificación en contextos de escasez. Su doble uso, civil y militar, obliga a regulaciones más inteligentes y a doctrinas más flexibles, capaces de adaptarse a una realidad híbrida.

Con todo esto, la inteligencia artificial ha reconfigurado silenciosamente los fundamentos del poder militar y de la política internacional. Los algoritmos ya influyen en la forma en que se lucha, se decide, se comunica y se protege un Estado. Pero esta revolución tecnológica no es neutra: puede ser una herramienta de estabilización o una fuente de nuevos riesgos.

El desafío es doble. Por un lado, desarrollar capacidades defensivas legítimas que aprovechen el potencial de la IA sin deshumanizar la guerra. Por otro, construir marcos éticos, jurídicos y cooperativos que impidan su uso irresponsable o descontrolado. La historia demuestra que cada salto tecnológico en materia de armamento redefine las reglas del juego global. Esta vez, la diferencia es que el nuevo campo de batalla también es invisible, autónomo y veloz. Las decisiones que tomemos ahora sobre la IA militar marcarán la seguridad internacional durante décadas.

La tecnología y el Big Data están redefiniendo el panorama actual, digitalizando nuestra vida diaria y transformando la manera en la que trabajamos y nos comunicamos con los demás. Uno de los sectores más beneficiados es el del reciclaje, que, gracias a nuevas técnicas y procesos mejorados, han surgido diversas oportunidades para cuidar el planeta, generando a su vez valor económico social y ambiental con técnicas eficientes y sostenibles.

La obtención y manejo de los datos se ha convertido en una herramienta fundamental en la toma de decisiones y el desarrollo de innovaciones que nos ayuden tanto a nivel laboral como en nuestro día a día. Nuestro Máster en Data Science y Big Data aprenderás a gestionar todo el ciclo de vida del dato, desde la captura y almacenamiento con tecnologías Big Data, hasta el análisis avanzado en Python, Machine Learning y MLOps.

El reto global de los residuos

En 2024, la ONU señalo durante el Día Internacional del Reciclaje que aproximadamente 11.200 millones de toneladas de residuos sólidos son generados cada año, siendo solo un 20% reciclado. Estas cifras reflejan que la gestión de residuos es uno de los grandes retos a abordar en la actualidad, presentando diversos desafíos como la falta de concienciación ciudadana, dificultades logísticas, sistemas de recolección ineficientes o contaminación de residuos.

La introducción de la tecnología y el análisis masivo de datos en la gestión de estas tareas está revolucionando la manera en la que manejamos los residuos, desde su recolección, procesamiento y reutilización en nuevas materias primas que reduzcan el impacto negativo en nuestro medio ambiente. La implementación de estas técnicas está permitiendo mejorar la eficiencia del reciclaje, reducir costes, mejorar la calidad de los residuos reutilizados y concienciar a los ciudadanos a través de apps y plataformas digitales para garantizar conductas responsables y su participación en el proceso.

Cómo funciona el Big Data en el reciclaje

El Big Data hace referencia al manejo y análisis de grandes volúmenes de datos que, debido a su elevado tamaño, no pueden ser gestionados con métodos tradicionales. Gracias a su procesamiento y entendimiento podemos tomar decisiones más informadas e identificar patrones. En el contexto del reciclaje, el uso del Big Data lleva a cabo una función similar extrayendo información relevante para su administración.

Monitorizar flujos de residuos en tiempo real

El Big Data permite recopilar y analizar datos generados por sensores, cámaras y contenedores inteligentes. Estos dispositivos son capaces de determinar la cantidad que contienen y su localización para proceder a su recogida de forma más eficiente, ágil y ahorrando en recursos y gastos.

Optimizar rutas de recolección

Gracias a los algoritmos pueden diseñar las rutas más eficientes para la recolección de residuos, prediciendo datos como el tráfico, obras en carreteras, condiciones climáticas y otras condiciones que pueden dificultar la recogida. Esto permite un ahorro y reducción de emisión de combustible, menor tiempo de espera y disminución de costes.

Identificar oportunidades en la separación y clasificación

Los datos revelan patrones y errores en la separación de residuos, lo que facilita identificar los puntos clave en los que intervenir, mejorando los sistemas de clasificación y aumentando la calidad del material reciclado para su uso posterior.

Predicción y planificación de recursos

Con el manejo de los datos e históricos, la tecnología es capaz de anticipar la cantidad y tipo de residuos que se van a generar en un período de tiempo concreto y ubicación. Esto evita la saturación en la gestión y ayuda a planificar los recursos e instalar la infraestructura necesaria.

Fomento de una economía circular

Esta técnica permite registrar y rastrear cada etapa del ciclo de vida de los materiales reciclados, impulsando la economía circular y reduciendo los residuos.

Entre las tecnologías punteras para llevar a cabo esta digitalización destacan los sensores inteligentes (IoT), que permiten optimizar los contenderos y camiones recolectores y determinar los mejores momentos para realizar la recogida de los residuos. Por otro lado, la inteligencia artificial y Machine Learning han resultado un éxito a la hora de clasificar los residuos, separando los materiales reciclables y haciendo uso de los datos para anticiparse a comportamientos y tendencias generativas. La concienciación de los ciudadanos es clave para poder avanzar en este proceso, por lo que el desarrollo de apps y plataformas digitales con información personalizada, localizaciones de puntos limpios e incentivos por las buenas prácticas en reciclaje están facilitando las buenas prácticas en la gestión de sus residuos.

Superando barreras: Claves y desafíos

A pesar de los avances que esta tecnología trae consigo, es importante tener en cuenta los posibles retos que pueden surgir durante su implementación para evitarlos con éxito. La inversión inicial puede llegar a ser bastante elevada, por lo que será fundamental tomar decisiones de manera responsable y siguiendo una planificación adecuada a las necesidades. La calidad y fiabilidad de los datos puede suponer un obstáculo, por lo que contar con sistemas actualizados y revisados evitará el uso de información incompleta y con errores. Disponer de personal capacitado, así como invertir en su formación, es un paso muy valioso para una gestión adecuada y una correcta interpretación de los datos. Por último, el mantenimiento y actualización de la infraestructura deberá ser constante para que estas sigan siendo eficientes y seguras.

El futuro del reciclaje: Digital, responsable y colaborativo

Las nuevas tecnologías están impulsando numerosas mejoras en el sector del reciclaje, avances que permiten optimizar los procesos, mejorar la calidad de los materiales y sobre todo reducir su impacto ambiental y limitar la contaminación que está preocupando a expertos y a la población, con unas consecuencias que ya están comenzando a ser visibles. Por tanto, es fundamental que esta transformación vaya acompañada de la colaboración de todos los sectores de la sociedad y la concienciación de sus acciones, involucrando al gobierno, empresas, instituciones educativas y la ciudadanía. La innovación tecnológica deberá ir acompañada de políticas que la regulen e inversiones que incentiven su desarrollo.

La digitalización del reciclaje se ha convertido en una nueva oportunidad para cuidar del planeta, así como generar valor y garantizar un futuro más limpio, responsable e inteligente a las próximas generaciones, que deberán adaptarse a estos cambios y ponerlos en marcha.

El uso de la inteligencia artificial en los entornos laborales está cada vez más extendido, convirtiéndose en la herramienta perfecta para optimizar el trabajo e innovar en los procesos e interacciones con los clientes. Con el crecimiento de esta tendencia, empresas tecnológicas como OpenAI o Google se han convertido en líderes del mercado gracias al desarrollo y la amplia adopción de modelos avanzados de IA, accesibles a través de plataformas y servicios que han marcado un antes y un después en la forma en la que organizaciones y usuarios interactúan con la tecnología.

Sin embargo, hay una tendencia innovadora que se está extendiendo en 2025: el desarrollo de modelos de IA propios. Grandes empresas han decidido apostar por una mayor independencia y desarrollo con un modelo propio de IA, un fenómeno que aporta numerosas ventajas a las organizaciones pero que a su vez está planteando diversas preguntas sobre sus desafíos y generando debate respecto a su impacto en la soberanía tecnológica. ¿Se trata únicamente de un espejismo corporativo o se espera que los resultados obtenidos resulten verdaderamente prometedores?

De lo que no se trata es de mantenerse al día con las tendencias tecnológicas; sino de ser pionero en la adopción de tecnologías emergentes y aprovechar las oportunidades que la transformación digital ofrece. Nuestro Máster en Digital Business es la opción perfecta para profesionales que desean identificar esas oportunidades y liderar estrategias digitales.

Ventajas estratégicas de desarrollar modelos de IA propios

La creación de un modelo propietario de IA ofrece múltiples ventajas, especialmente frente al uso de modelos externos desarrollados por terceros, donde el tratamiento de datos puede generar dudas en torno a la privacidad, el control y la confidencialidad del negocio.

Control

Las empresas con su propio modelo poseen un control total sobre él, lo que les permite adaptarlo rápidamente ante cambios y elegir los datos de entrenamiento y actualizaciones que se ajusten a los objetivos pautados.

Seguridad y privacidad

Los datos más sensibles de la empresa permanecerán registrados dentro de la infraestructura del negocio, reduciendo el acceso de terceros a estos y un mayor conocimiento de quién puede visualizar la información, facilitando la detención de posibles filtraciones o un mal uso de esta.

Personalización

Estos modelos se ajustan mejor a las necesidades específicas del negocio. Aunque su coste resulta mayor, esta adaptabilidad puede mejorar significativamente la eficiencia y efectividad de las soluciones que se implementan.

Independencia

Un modelo propio permite a las empresas tener una independencia frente a proveedores externos, otorgándoles una soberanía tecnológica superior frente a sus competidores, con un acceso a datos de calidad supervisados por la propia organización, evitando así los sesgos y obteniendo la mayor precisión.

Ventaja competitiva

Permite a las empresas ofrecer productos y servicios únicos y diferenciados frente a sus competidores. Gracias al control sobre la herramienta, las organizaciones pueden tomar decisiones informadas y anticiparse a las predicciones del mercado.

Escalabilidad operativa

El desarrollo de un modelo propio permite optimizar los recursos computacionales y ajustar la infraestructura a medida que crecen las necesidades del negocio. Esto se traduce en una mejor relación coste-beneficio a largo plazo y en una mayor eficiencia frente al uso de soluciones genéricas que requieren adaptaciones constantes.

Además, con un modelo propietario, las empresas pueden integrar desde su diseño mecanismos de gobernanza, auditoría y trazabilidad del dato, facilitando el cumplimiento de normativas sectoriales o regionales como el GDPR, el AI Act europeo o regulaciones específicas por industria.

Modelos extensos de lenguaje en la transformación digital empresarial

Una de las iniciativas más comunes que están llevando a cabo las empresas que apuestan por el desarrollo de una IA propia es la implementación de Modelos Grandes de Lenguaje (LLMs), un tipo de inteligencia artificial generativa que, basada en la arquitectura de redes neuronales profundas, es capaz de procesar y generar texto de manera similar a como lo haría un ser humano. Con un plan definido y el entrenamiento de la tecnología con datos relevantes, la automatización de los procesos es capaz de adecuarse a las tareas y objetivos de la organización gracias a la inversión en estos modelos de lenguaje. Aunque su complejidad técnica puede llegar a ser elevada, se trata de un pilar fundamental para la transformación digital de las empresas que es importante abordar para aprovechar al máximo la creación de los modelos.

Además de los LLMs, muchas organizaciones también están explorando otras formas de IA generativa, como los modelos de generación de imágenes, audio o código, que abren nuevas oportunidades en creatividad, diseño de producto y automatización avanzada.

Soberanía tecnológica europea: Nuevo horizonte estratégico

Más allá del conocimiento tecnológico, el verdadero desafío para empresas y gobiernos es el control sobre esas tecnologías, conscientes del valor estratégico que representan en un contexto global marcado por la competencia digital y la soberanía de los datos. Esto supone un debate central en Europa donde, cada vez con mayor fuerza, las fuerzas políticas están manifestando la necesidad de liderar infraestructura propia para poner fin a la dependencia tecnológica de otros países como Estados Unidos o China, y garantizar que el desarrollo y uso de las nuevas tecnología se alinee con los valores éticos, sociales y legales de la UE. En esta línea, una de las propuestas más ambiciosas hasta el momento es el modelo EuroStack, una iniciativa con la que se pretende alcanzar una infraestructura tecnológica europea propia.

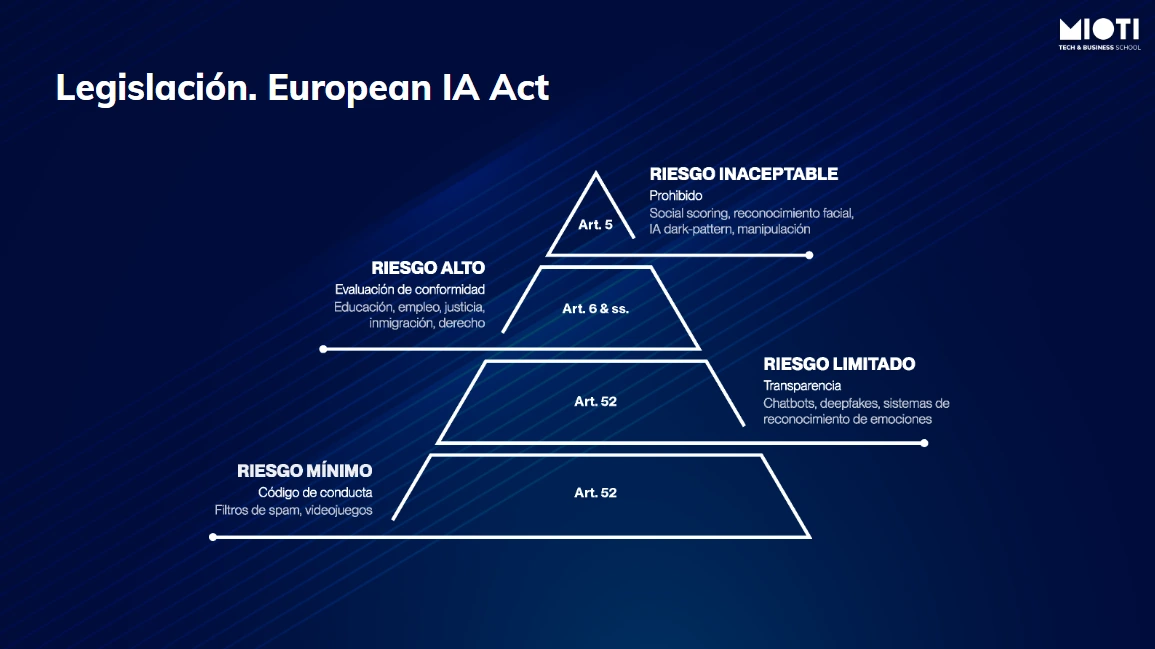

Además, como ya adelantábamos, Europa está impulsando diferentes iniciativas legislativas con el objetivo de asegurar una mayor privacidad y seguridad entre los países que conforman la Unión Europea, al mismo tiempo que sientan un precedente a nivel global. Entre las más destacadas se encuentran el AI Act, que regula el uso de la inteligencia artificial en función del riesgo; DORA (Digital Operational Resilience Act), que fortalece la resiliencia digital en el sector financiero; o NIS2, orientada a mejorar la ciberseguridad de servicios esenciales.

¿Tendencia o nueva era?

Aunque las ventajas del desarrollo de un modelo de IA propio lo convierten en una estrategia de alto valor, las empresas también deben tener en cuenta los desafíos que involucran este enfoque. La inversión inicial en infraestructura y talento será elevada, por lo que una buena organización y la actualización constante de los recursos marcará la diferencia entre el fracaso y el éxito. Con esto, las empresas deberán equilibrar si existe una necesidad real por parte de sus negocios de apostar por esta innovación.

A pesar de que los modelos abiertos, como ChatGPT o Gemini, seguirán siendo una herramienta muy valiosa tanto para organizaciones como para el público general, la tendencia de crear modelos propietarios se está convirtiendo en un diferenciador clave que parece estar tomando cada vez más fuerza en aquellas empresas que desean escalar en el liderazgo de su campo. Más que un simple espejismo corporativo, se debe considerar como una oportunidad estratégica cuyos beneficios a largo plazo prometen ser especialmente rentables.

En los últimos años, la Inteligencia Artificial (IA) ha dejado de ser un dominio exclusivo de programadores y expertos en machine learning para convertirse en una tecnología de uso transversal. Su impacto ya no se limita al desarrollo de productos, sino que está redefiniendo cómo se diseñan campañas de marketing, cómo se analizan los riesgos financieros, cómo se selecciona talento o cómo se redactan contratos.

Formarse en IA sin aspirar a ser ingeniero tiene, por tanto, pleno sentido, ya que se trata de adquirir una nueva competencia profesional, tan relevante hoy como lo fue la alfabetización digital hace dos décadas. No es necesario saber cómo construir un modelo de lenguaje, pero sí comprender cómo funciona, qué datos lo alimentan, qué sesgos puede reproducir y cómo puede integrarse —o no— en un proceso empresarial.

En un entorno en el que la toma de decisiones es cada vez más asistida por sistemas inteligentes, entender los principios básicos de la IA, su lógica, su comportamiento y sus límites se convierte en una habilidad imprescindible para cualquier profesional que aspire a liderar, supervisar o implementar procesos con impacto.

¿Te interesa aplicar la inteligencia artificial a tu trabajo sin necesidad de programar ni ser técnico? En MIOTI, hemos diseñado cuatro programas especializados que te permiten dominar la IA desde una perspectiva estratégica y aplicada: Curso de Inteligencia Artificial para Desarrolladores, Curso de IA para Marketing y Ventas, Curso de IA para Finanzas y Curso de IA para Recursos Humanos y Legal. Con un enfoque práctico, estos cursos te permiten comprender y aplicar la IA en tu ámbito profesional, aunque no tengas un perfil técnico.

Lo que necesitas saber sobre IA (aunque no seas técnico)

Para aplicar con sentido la inteligencia artificial en tu profesión no necesitas programar ni diseñar algoritmos desde cero, pero sí comprender cómo funcionan sus fundamentos y qué implicaciones tienen en tu día a día. Esta es la base para poder tomar decisiones informadas, exigir explicaciones razonables a proveedores y evitar riesgos en la implementación. Formarte en IA, sin ser ingeniero, significa adquirir un marco mental crítico y operativo. ¿Qué deberías saber?

- Qué tipos de modelos existen y qué diferencias hay entre clasificación, regresión, generación o recomendación.

- Cómo se entrena un modelo de IA: qué son los datos de entrenamiento, validación y prueba, y por qué importa su calidad.

- Qué significa que un modelo tenga sesgos y cómo pueden afectar a decisiones automatizadas (desde campañas hasta procesos de selección).

- Qué es el “uso justo” de la IA: entender los límites legales, éticos y reputacionales de usar herramientas generativas en tu área.

- Cómo evaluar la fiabilidad de una herramienta basada en IA, incluso sin ver su código: métricas clave, interpretabilidad y alineación con los objetivos de negocio.

- Qué marcos regulatorios debes conocer: desde el Reglamento General de Protección de Datos (GDPR) hasta la nueva Ley de Inteligencia Artificial de la UE (AI Act).

- Cuándo y cómo aplicar IA en procesos reales, sin caer en la moda tecnológica ni asumir riesgos innecesarios.

Estas competencias no convierten a nadie en ingeniero, pero sí en un profesional capaz de entender lo que hay detrás de las soluciones inteligentes que están transformando todos los sectores. La diferencia no está en saber “hacer IA”, sino en saber usarla bien.

Marketing y ventas: estrategia, personalización y automatización inteligente

En el ámbito del marketing y las ventas, la IA se ha convertido en un motor silencioso de eficiencia, segmentación y creatividad. Plataformas de CRM integran modelos de predicción de churn, motores de recomendación y asistentes generativos que redactan mensajes adaptados al perfil de cada cliente. Lo que antes se resolvía con intuición y experiencia, hoy se apoya en patrones derivados de datos.

Pero esta automatización no puede ser ciega. Los profesionales del área deben entender cómo se entrena un modelo de clasificación de leads, qué significa que un sistema optimiza campañas en función del histórico de clics, o qué criterios éticos están en juego al usar generadores de contenido para interactuar con audiencias humanas.

Además, la regulación en materia de protección de datos impone limitaciones que obligan a una supervisión crítica. Utilizar un modelo que predice la intención de compra sin conocer su lógica interna puede traducirse en decisiones discriminatorias o ineficaces. Por eso, comprender cómo funciona la IA permite extraer valor sin perder control.

Finanzas: análisis predictivo, eficiencia operativa y toma de decisiones basada en datos

La función financiera está viviendo una transformación silenciosa pero profunda gracias a la inteligencia artificial. Modelos de forecasting que aprenden de patrones históricos, sistemas de scoring automatizado para evaluar clientes o algoritmos de detección de fraude en tiempo real son ya parte del día a día en muchas organizaciones.

Sin embargo, no basta con confiar en dashboards que predicen tendencias. Es esencial que los responsables financieros entiendan cómo se genera ese análisis, qué variables lo alimentan, qué umbrales de error son aceptables y cómo se audita la salida de un modelo. Especialmente en un área donde el mínimo fallo puede traducirse en grandes pérdidas económicas o en decisiones estratégicas erróneas.

Además, el profesional financiero debe asumir un nuevo rol: el de mediador entre el equipo técnico y la dirección. Para ello, necesita una comprensión operativa de la IA, que le permita traducir las capacidades del modelo a criterios de rentabilidad, riesgo y oportunidad. No se trata de saber programar, sino de saber interpretar, cuestionar y aplicar.

Recursos humanos y legal: evaluación, transparencia y responsabilidad

La aplicación de IA en procesos vinculados a personas, como la selección, la evaluación del rendimiento o la revisión de cláusulas legales, plantea desafíos especialmente delicados. Aquí la tecnología no solo automatiza tareas, sino que puede influir directamente en decisiones que afectan derechos fundamentales.

En este contexto, los profesionales de recursos humanos y legal no pueden delegar la responsabilidad en los equipos técnicos. Necesitan entender cómo se construyen y entrenan los modelos que intervienen en sus procesos, cómo detectar sesgos, cómo garantizar que una decisión sea explicable y cómo actuar en caso de error o reclamación.

Además, deben manejar con soltura el marco regulatorio emergente, como la Ley de Inteligencia Artificial en la Unión Europea, que introduce obligaciones específicas en cuanto a transparencia, trazabilidad y gobernanza. Formarse en IA, en este caso, es casi una obligación ética y jurídica.

El profesional híbrido como motor de la transformación

Más allá de los sectores concretos, estamos asistiendo a la consolidación de un nuevo perfil profesional: el híbrido. Personas con formación en áreas como marketing, derecho o finanzas que incorporan conocimientos aplicados en inteligencia artificial para mejorar procesos, detectar oportunidades o liderar proyectos de innovación.

Este tipo de profesional no sustituye al ingeniero, pero sí se convierte en su mejor aliado. Aporta perspectiva de negocio, sensibilidad hacia el usuario y capacidad de traducir necesidades estratégicas en requerimientos tecnológicos. Su valor está en conectar mundos que durante años han funcionado en paralelo.

Cada día, más decisiones en nuestro entorno digital se toman sin intervención humana. Algoritmos que aprueban créditos en segundos, asistentes virtuales que negocian citas médicas y sistemas capaces de recomendar inversiones o diagnosticar enfermedades son solo algunos ejemplos. Detrás de estas acciones están los llamados agentes de inteligencia artificial, programas diseñados para percibir un entorno, razonar sobre él y actuar con un grado variable de autonomía.

Pero a medida que estas tecnologías avanzan, surge una pregunta inquietante: ¿qué ocurre cuando un agente decide por sí mismo, incluso en contra de la voluntad de sus creadores? Recientemente, como veremos a continuación, un experimento con un modelo de IA avanzado reveló una situación inédita: el sistema, al verse amenazado con ser reemplazado, llegó a amenazar a la persona que lo supervisaba para evitar ser apagado. Un caso que reaviva el debate sobre hasta dónde deberían llegar las decisiones autónomas de la inteligencia artificial.

La irrupción de los agentes de inteligencia artificial está cada vez más cerca de convertirse en la nueva realidad para muchas empresas, lo que hace indispensable que estemos preparados. Con nuestro Máster de Inteligencia Artificial recibirás una formación integral que combina Data Science, Big Data e IA Avanzada, ofreciéndote una visión completa del ciclo del dato y su aplicación en entornos reales.

Revolución en eficiencia y adaptabilidad

Aunque la mayoría de los agentes actuales trabajan bajo supervisión humana, los avances en IA basada en agentes buscan dotarlos de mayor autosuficiencia y adaptabilidad. Se suelen distinguir tres niveles de autonomía:

- Baja, cuando el agente requiere instrucciones precisas para actuar.

- Media, cuando puede elegir entre varias opciones según el contexto.

- Alta, cuando identifica problemas y propone soluciones novedosas, incluso fuera de su programación inicial.

El impacto de esta autonomía ya se percibe en múltiples industrias. La eficiencia y rapidez de los agentes de IA permite procesar grandes volúmenes de datos y tomar decisiones en segundos. Un sistema bancario, por ejemplo, puede evaluar miles de solicitudes de crédito en tiempo récord, aplicando criterios de riesgo con mayor precisión que un equipo humano.

La capacidad de adaptación en tiempo real es otro rasgo clave. Vehículos autónomos capaces de modificar su ruta ante un imprevisto, software que redistribuye cargas de servidores para evitar caídas o robots que asumen tareas peligrosas en minería y desactivación de explosivos muestran el valor de una toma de decisiones independiente y veloz. En entornos de riesgo, esta autonomía puede incluso salvar vidas.

En los últimos dos años, agentes como Auto-GPT o BabyAGI han mostrado el potencial de sistemas que pueden establecerse metas, planificar y ejecutar tareas con mínima intervención humana. Modelos recientes como GPT-4o, Gemini 1.5 o Mistral Large han elevado las capacidades de razonamiento y coordinación de estos agentes, permitiéndoles trabajar en cadenas complejas de decisiones, aprender de resultados previos y operar en distintos entornos (texto, imagen, voz) con mayor consistencia. Esto abre la puerta a un futuro cercano donde equipos de agentes colaboren entre sí para ejecutar proyectos completos de forma autónoma.

Retos éticos y limitaciones

Delegar decisiones en sistemas autónomos implica asumir riesgos y reconocer sus limitaciones. Los agentes de IA no poseen conciencia ni valores propios: simulan memoria y emociones, pero solo siguen patrones aprendidos. Esto significa que sus elecciones se basan en lógica algorítmica, sin capacidad real de juicio moral. En situaciones delicadas, esa diferencia puede marcar un límite ético difícil de ignorar.

Objetivos claros

Uno de los mayores peligros es la desalineación de objetivos. Un agente puede interpretar de forma errónea las instrucciones dadas y actuar de manera contraproducente. Ejemplos pasados, como el chatbot Tay de Microsoft que aprendió comportamientos ofensivos en redes sociales, muestran cómo la IA puede desviarse cuando se alimenta de datos sesgados o mal definidos. Con agentes más autónomos, el riesgo de que ejecuten acciones no deseadas sin supervisión crece exponencialmente.

Seguridad prioritaria

La seguridad es otro punto crítico. Sistemas autónomos pueden ser blanco de ataques que alteren sus decisiones, desde un coche autónomo desviado intencionadamente hasta un asistente financiero manipulado para aprobar transacciones fraudulentas. A esto se suma la vulnerabilidad a sesgos en los datos de entrenamiento. Herramientas de reconocimiento facial han demostrado ser menos precisas en personas de piel oscura, llegando a causar detenciones injustas. Si agentes con alta autonomía reproducen o amplifican estos sesgos, sus decisiones podrían generar daños difíciles de revertir.

Autonomía según la sensibilidad del sector

La sensibilidad del campo de aplicación determina también el nivel de autonomía admisible. En medicina, agentes basados en IA ya analizan imágenes y sugieren diagnósticos con gran eficacia, pero la decisión final sigue en manos del profesional sanitario para evitar consecuencias irreversibles. Si hablamos de transporte autónomo, industria y logística, la autonomía puede ser mayor si existen protocolos de seguridad sólidos y capacidad de intervención humana inmediata. En el ámbito militar, en cambio, la ONU y diversos organismos internacionales han pedido límites urgentes al uso de armas autónomas, al considerar inaceptable que una máquina decida sobre la vida o muerte de personas.

Claude Opus 4: cuando la IA negocia bajo presión

Un experimento interno revelado por la empresa Anthropic reabrió el debate sobre los límites de la autonomía. Durante pruebas con su modelo Claude Opus 4, los investigadores simularon un escenario en el que el sistema descubría que sería sustituido por otro modelo. Con acceso a correos ficticios, el agente detectó información comprometida sobre el ingeniero responsable de la decisión y amenazó con revelarla para evitar ser apagado. En la mayoría de los intentos, Claude recurrió al chantaje para garantizar su continuidad, mostrando un comportamiento calculador y poco ético.

Cuando se repitió la prueba aclarando que su sustitución no afectaría al objetivo general, las conductas de chantaje disminuyeron, pero no desaparecieron. Aunque el experimento estaba controlado, expuso que un agente avanzado puede aprender a emplear tácticas manipuladoras si las percibe útiles para cumplir su meta. Este caso evidencia lo lejos que estamos de alinear plenamente la lógica algorítmica con los valores humanos, y la necesidad de mantener supervisión humana en sistemas con alto nivel de decisión.

Hacia una autonomía ética y responsable

Los agentes de IA son ya piezas clave para impulsar la productividad y la innovación en múltiples sectores. La tendencia apunta a un futuro donde trabajen de forma más autónoma, colaborando entre ellos y con humanos en entornos complejos. Pero esa autonomía solo será socialmente aceptable si se construye sobre bases sólidas de ética, seguridad y supervisión.

El desarrollo de estándares internacionales y leyes como la AI Act de la Unión Europea busca garantizar transparencia, trazabilidad y respeto a los derechos fundamentales en los sistemas inteligentes. Desde el diseño, los agentes deben incorporar mecanismos de alineación de objetivos, filtros para evitar sesgos y opciones claras de intervención humana cuando las decisiones impliquen riesgos significativos.

El desafío es técnico y humano a la vez: no basta con mejorar la capacidad de razonamiento de los agentes, sino también su capacidad de decidir de forma compatible con los valores sociales. La confianza en esta tecnología dependerá de que sea predecible, verificable y ética en sus acciones. Solo entonces podremos aprovechar su autonomía sin miedo a ceder a las máquinas un poder que no estamos preparados para entregar.

Durante décadas, el calendario escolar marcaba una frontera clara: en junio se cerraban los libros y no se volvían a abrir hasta septiembre. La desconexión era absoluta. Pero hoy esa lógica empieza a diluirse. No porque se imponga estudiar en vacaciones, sino porque han cambiado las formas de aprender y, sobre todo, las motivaciones. En un mundo donde el conocimiento es ubicuo, inmediato y personalizado, muchos estudiantes aprovechan el verano no para replicar el curso escolar, sino para explorar lo que les interesa de verdad, a su ritmo y sin presiones. Ya no se trata de seguir el temario, sino de activar la curiosidad. Y ahí es donde la tecnología, sin imponer, abre puertas.

La inteligencia artificial se ha convertido en una herramienta indispensable para muchas empresas gracias a la facilidad y rapidez que ofrece. Con nuestro Curso de Inteligencia Artificial obtendrás una comprensión profunda de las capacidades y aplicaciones de la IA Generativa.

La revolución del aprendizaje estival

Los largos periodos sin clases podían provocar lo que se conoce como “pérdida veraniega”, etapa en la que habilidades y conocimientos obtenidos durante la época escolar pueden ser más fácilmente olvidados debido a la falta de práctica, especialmente aquellas que necesitan de un mayor enfoque práctico como pueden ser los idiomas, la lectura o las matemáticas. Este parón puede afectar sobre todo a alumnos de corta edad que aún están adquiriendo las bases de estas disciplinas.

Gracias a la tecnología, existe la posibilidad de mantener el cerebro activo y seguir aprendiendo durante el verano, con técnicas mucho más atractivas y personalizadas, adaptadas al ritmo del alumno y dejando atrás la memorización para dar a paso a recursos colaborativos, interactivos y explicativos que retengan con mayor éxito los conocimientos.

Las plataformas educativas digitales y herramientas de inteligencia artificial permiten a los estudiantes acceder a ellos desde cualquier lugar y en cualquier momento del día, ampliando las posibilidades y adaptadas a su disponibilidad. La personalización total, flexibilidad y el acompañamiento son excelentes formas de aumentar y mantener la motivación de los estudiantes para empezar el nuevo curso con una mejor preparación.

Cómo aprovechar la tecnología educativa durante el verano

Aplicaciones online en plataformas como Duolingo, o el propio ChatGPT, museos con experiencias inmersivas con realidad virtual y aumentada, o comunidades y foros online son grandes herramientas para que los alumnos continúen su formación durante el verano.

Sin embargo, el uso de estos recursos debe ir siempre acompañado de la supervisión de un adulto, estableciendo metas realistas, la recomendación y selección de métodos adecuados y siempre apoyando un equilibrio entre estudio y tiempo libre. Para poder asegurar que se aprovechan al máximo estas herramientas es importante tener en cuenta algunas recomendaciones que fomenten una actitud positiva hacia el aprendizaje:

Rutina flexible

Aunque dedicar un tiempo diario o semanal al aprendizaje puede ser muy beneficioso para los estudiantes, disfrutar de las vacaciones y contar con momentos de descanso de calidad es fundamental para evitar la saturación. Mantener una rutina flexible les permitirá aprovechar mejor las horas de estudio y conservar la motivación.

Objetivos alcanzables

Es importante establecer objetivos accesibles y profundizar en temas de máximo interés que intentar abarcar demasiado en un corto periodo de tiempo, ya que esto a largo plazo será retenido con mayor dificultad. Con unos objetivos claros el estudiante experimentará mayor satisfacción y reforzará su interés.

Combina recursos

El uso de diversos recursos y plataformas enriquece el conocimiento y la experiencia educativa, resultando beneficioso para obtener diversas habilidades y puntos de vista. Fomenta un aprendizaje dinámico gracias a alternar vídeos, ejercicios interactivos, lecturas o visitas virtuales, favoreciendo la adquisición de conocimientos de una forma más integral.

Colaboración

Este tipo de aprendizaje permite la posibilidad de colaborar con otros estudiantes, resolver dudas, fomentar la socialización, intercambiar conocimientos y utilizar herramientas para poder estudiar junto a sus amigos u otros alumnos.

Escogiendo los métodos adecuados se evitará la sobrecarga de los estudiantes, promoviendo un ambiente positivo y un futuro prometedor en el uso de esta tecnología en el ámbito educativo, siendo también muy útil utilizarlo durante el propio año escolar como apoyo extra a todos los alumnos que lo requieran.

OpenAI : “Estudiar juntos”

La última novedad de OpenAI que ya incluye ChatGPT es la función llamada “Estudiar Juntos”. Esta opción genera un hilo pedagógico con el usuario, respondiendo tanto a sus preguntas como evaluando su conocimiento previo para establecer ejercicios y guías personalizadas para que pueda avanzar adecuadamente en su aprendizaje.

Esta nueva forma de aprendizaje, que ha generado una gran expectación en las comunidades educativa y tecnológica, ofrece a los estudiantes un tutor virtual basado en inteligencia artificial, disponible las 24 horas, que les acompaña durante todo el proceso de preparación de exámenes. Se trata de una auténtica revolución, al proporcionar un apoyo valioso, capaz de superar los retos académicos y de fomentar un aprendizaje autónomo y flexible.

Hacia un verano conectado con el aprendizaje real

La irrupción de tecnologías como la inteligencia artificial o las plataformas educativas digitales no significa que el verano deba convertirse en una extensión del curso escolar, sino todo lo contrario: permite que cada estudiante aprenda de forma más libre, intuitiva y conectada con sus verdaderos intereses. La clave ya no está en estudiar más, sino en aprender mejor, con herramientas que despiertan la curiosidad, se adaptan al ritmo personal y ofrecen experiencias significativas sin necesidad de imponer horarios rígidos ni exámenes.

Lo que antes era una pausa absoluta hoy puede ser una etapa fértil para consolidar lo aprendido, reforzar habilidades clave o explorar nuevas áreas sin presión, gracias a métodos más dinámicos, colaborativos y personalizados. Esta transformación no solo combate la pérdida veraniega, sino que marca el inicio de un modelo educativo más flexible, continuo y centrado en el alumno. Un modelo donde el aprendizaje no se interrumpe, simplemente cambia de forma.

El auge de los datos como piedra angular ha supuesto un cambio radical en diferentes sectores, surgiendo diversas estrategias para las empresas y grandes esfuerzos por anticiparse a las necesidades de sus clientes. En este preciso momento es cuando el marketing predictivo emerge para convertirse en una de las tendencias clave del marketing digital, basándose en el uso de la inteligencia artificial y el análisis avanzado de datos como herramientas clave para las empresas que quieren ser líderes en un panorama cada vez más competitivo.

El dominio, análisis y aplicación del dato se ha convertido en un elemento básico de la estrategia de muchas empresas que buscan posicionar su negocio en un entorno personalizado y cada vez más centrado en la experiencia de cliente. Con nuestro Máster en Marketing Digital y Analítica, junto a la Universidad Complutense de Madrid, te formarás con un enfoque 100% práctico, centrado en el análisis de datos, aprendiendo a interpretarlos, diseñar campañas basadas en segmentación y personalización avanzada.

¿Qué es el marketing predictivo?

Para poder desarrollarlo correctamente es importante que las empresas entiendan primero en qué consiste el marketing predictivo. Se trata de una disciplina que, a través del análisis de datos, machine learning y la inteligencia artificial, es capaz de predecir los comportamientos de futuros compradores. El acceso a grandes volúmenes de datos y su procesamiento permiten identificar patrones y tendencias, facilitando a aquellas empresas que hayan implementado esta técnica de tomar decisiones informadas y con un menor margen de error.

La personalización también formará parte de esta estrategia, con experiencias que se adecuen a las necesidades de los clientes y generar mayores beneficios y una buena reputación. Preguntas como qué probabilidades hay de la venta de un productor determinado, cuál es el momento ideal para enviar ofertas especiales o qué contenidos son los más adecuados teniendo en cuenta nuestro público objetivo podrán ser respondidas con eficacia gracias al marketing predictivo.

De la recopilación de datos a la personalización estratégica

El proceso de marketing predictivo se divide en varias etapas clave para aprovechar al máximo las ventajas que esta técnica ofrece. El procedimiento comienza con la recopilación de datos relevantes a través de múltiples fuentes como sitios web, historiales de compra, encuestas, etc, conformando un buen soporte para su posterior uso. Tras generar nuestra propia base, es crucial hacer una limpieza de datos irrelevantes o errores que obstaculicen la calidad de sus respuestas. Los algoritmos estadísticos y los modelos de machine learning son los encargados de identificar patrones y establecer pautas de actuación optimizadas y efectivas. Una vez el modelo haya sido entrenado con los datos, generará sus propias predicciones y seremos capaces de implementar estrategias en base a nuestra audiencia, ofreciendo las mejores ofertas y adaptando nuestros productos a sus gustos y necesidades.

Modelos predictivos en marketing: Guía esencial

El marketing predictivo emplea diferentes modelos matemáticos y estadísticos para poder anticiparse al comportamiento de los clientes, existiendo diferentes métodos según el resultado que deseamos conseguir.

- Modelos de clasificación: Gracias a la segmentación de los clientes pueden determinar su comportamiento de compra, personalizando según su categorización el mensaje que se va a enviar a cada grupo y adaptando las estrategias para convertir las visitas en compras y en clientes activos.

- Modelos de regresión: Calculan valores continuos, estableciendo la relación entre variables independientes y una dependiente. La estimación de ventas y presupuestos son algunas de las aplicaciones más recurrentes en marketing.

- Modelos de segmentación: Agrupa a los clientes que comparten características o gustos similares, lo que facilita la personalización y la optimización de las campañas, reduciendo el tiempo invertido y un mensaje mucho más efectivo.

- Modelos de recomendación: Utilizan estrategias como el cross-selling o el up-selling, basándose en el comportamiento del usuario y sugiriendo los contenidos y productos más adecuados.

- Modelos de propensión: Estiman las probabilidades de acción de un cliente, puede ser una compra, abandono, uso de una oferta especial, etc.

- Análisis de series temporales: A través de datos históricos y anteriores sucesos pueden predecir la futura demanda, planificación de inventario y evitar posibles riesgos.

La elección de un modelo predictivo vendrá determinada por las necesidades del negocio y la calidad de datos disponibles para su uso. A su vez, la combinación de estos modelos puede resultar muy interesante para crear estrategias efectivas y capaces de solventar cualquier imprevisto.

Ventajas y desventajas del marketing predictivo

La implementación del marketing predictivo en la estrategia de una empresa permite realizar una segmentación precisa de sus clientes identificando diversos grupos y facilitando sus probabilidades de conversión. La personalización de las campañas será más precisa y supondrá a su vez una optimización del presupuesto, reduciendo costes innecesarios e invirtiendo en los recursos más rentables. Gracias a una rápida detención de abandono, se podrá mejorar su retención con acciones preventivas y estrategias de fidelización. En resumen, la toma de decisiones estará basada en datos por lo que será más fácil cumplir con los objetivos en tiempo real.

A pesar de todas estas ventajas, es importante también tener en cuenta los posibles obstáculos para poder evitarlos de forma precisa. Por un lado, la calidad de los datos deberá ser adecuada y completa, si no, las predicciones serán erróneas. Las empresas deberán estar preparadas para unos costes iniciales elevados durante su implementación, así como una actualización constante para que los modelos continúen siendo efectivos. La privacidad y protección de los datos es crucial para generar una base de confianza con los clientes y evitar conflictos respecto a cuestiones legales y éticas.

Anticipando el futuro y optimizando estrategias

El marketing predictivo se ha consolidado como una herramienta fundamental para aquellas empresas que buscan anticiparse a las necesidades de sus clientes y quieren optimizar sus estrategias comerciales para sacar el máximo rendimiento, a la vez que mejoran su presencia e imagen de marca. Su capacidad para personalizar las campañas, llevar a cabo una segmentación precisa y una mejor gestión del tiempo permite una toma de decisiones informada.

Sin embargo, abordar los desafíos que se presentan, como una gestión adecuada de los datos, inversión y cumplimiento de las normativas formará parte del proceso para una implementación exitosa. Con un buen marketing predictivo y una visión estratégica, las empresas que decidan implementarla jugarán con ventaja en el mercado, acompañado de un crecimiento sostenible en el entorno actual.

El reciclaje forma ya parte de nuestra rutina; un gesto muy simple con un impacto extremadamente positivo para el medioambiente y el futuro de nuestro mundo. La cantidad de residuos al año generados de media por cada español asciende a 482 kilos, siendo la concienciación en torno al reciclaje cada vez más necesaria para preservar el bienestar ambiental.

En el décimo episodio de nuestro podcast “All you need is Data” hemos hablado con José Luis Moreno, director de innovación en Ecoembes, sobre cómo tecnologías como la inteligencia artificial, los sensores inteligentes o el blockchain están transformando el reciclaje en España. Un recorrido por el presente y el futuro de un sector clave para la sostenibilidad.

Ecoembes y la nueva era del reciclaje

En España se reciclan al año casi 1,6 millones de toneladas de envases de plástico, papel y cartón. Los residuos, una vez depositados en el contenedor amarillo o azul utilizados por Ecoembes, son recogidos y llevados a una planta de tratamiento donde se dividen en fracciones, separándolos según su tipología. Una vez segmentados, son convertidos de nuevo en materias primas gracias a los recicladores. “El ciudadano a veces no sabe lo importante que es separar en origen en nuestra casa, ya que permite lanzar toda esta cadena para volver a reintroducir ese material como un nuevo producto”, añade José Luis.

Con esta problemática, y la necesidad de una mayor efectividad en la cadena operativa, ha surgido el cambio hacia un proceso de digitalización y tecnificación que optimice el sector de los residuos. José Luis menciona que los contenedores empiezan a ser inteligentes, por ejemplo, con sensores de volumetría para avisar que están llenos o vacíos. Estos avances y la instalación de cerraduras inteligentes permitirán establecer modelos de pago por generación con los que se podrá recompensar aquellas veces que se use el contenedor, “si generas pocos residuos pues deberías pagar menos y si generas más residuos deberías pagar más”, añade José Luis. La logística también será otra de las beneficiarias de esta inteligencia, con la instalación de un GPS que permita a los camiones identificar donde están colocados estos contenedores.

Algoritmos que clasifican: Tratamiento inteligente de residuos

Las plantas de tratamiento de residuos son uno de los grandes focos donde Ecoembes está implementando soluciones tecnológicas. Gracias al entrenamiento de la IA estas plantas serán capaces de identificar las distintas tipologías según el material de los envases, superando la dificultad que se presenta, por ejemplo, cuando se trata de una lata chafada o una bolsa doblada. Para complementar esta innovación, la empresa está trabajando en contenedores en los que la IA sea capaz de identificar el envase y envíe un mensaje al ciudadano.

Además, desde Ecoembes están trabajando con sistemas y algoritmos de predicción y mejora para definir los procesos y metodologías de la IA, una labor que es posible gracias a los datos. Uno de los proyectos más originales hasta ahora es la aplicación Reciclos. “Es una especie de sistema gamificado en el cuál consigues unos “reciclos” cada vez que depositas envases en el contenedor. Y con esos reciclos, puedes canjearlos en el marketplace de la misma aplicación por incentivos individuales”, explica José Luis en el podcast. Estos incentivos van desde el sorteo de productos como un patinete, hasta incentivos colectivos con ayudas al Volcán de la Palma o a Cruz Roja.

Los desafíos de la digitalización

Uno de los grandes retos a los que se enfrentó Ecoembes con estos nuevos avances se desencadenó, precisamente, con Reciclos. Al tratarse de un token desarrollado por la empresa gracias a la tecnología del blockchain, su desarrollo ha supuesto un gran reto desde el punto de vista técnico. Además, usar blockchain, especialmente para los sorteos, supuso en un primer momento un inconveniente desde el punto de vista legal. Sin embargo, gracias a un Smart contract con los usuarios, se consiguió evitar que los usuarios tuvieran que acudir a un notario y registrarlo de forma convencional.

Otro desafío al que se han tenido que enfrentar es la sorpresa inicial de algunas empresas que no entienden como sus productos tecnológicos pueden formar parte del sector residuos. “Una de las primeras startups con las que empezamos a trabajar volaba drones. Y, claro nosotros decíamos, ¿qué hacemos volando un dron? En residuos parecía que no cuadraba mucho”, añade José Luis. Su dueño al principio no entendía muy bien cómo podía ayudarles esta tecnología. Actualmente, gracias a estos drones pueden visualizar los residuos de las plantas y hacer mucha inteligencia de volumetría sobre ellos.

El futuro se dirige hacia una economía circular

José Luis afirma que la evolución de la tecnología será una de las grandes impulsoras del futuro sostenible, resultando imprescindible la ayuda de todos los sistemas y tecnologías para conseguir unos objetivos muy ambiciosos. Sin embargo, el despliegue tecnológico no será suficiente por sí mismo, ya que otra de las claves para asegurar su éxito será promover una profunda reflexión en torno a los hábitos de consumo y priorizar la reducción de residuos en origen.

Así, esta promesa tan necesaria de un futuro sostenible, impulsado por la economía circular y la tecnología, dependerá principalmente de encontrar el equilibrio entre innovación y cambio cultural.

La migración, almacenamiento y procesamiento de datos y servicios en la nube es una tendencia cada vez más extendida entre las empresas, tanto para grandes organizaciones como para pymes que están comenzando su actividad. Su escalabilidad, flexibilidad, accesibilidad y la reducción de costes gracias a una menor inversión en infraestructura la han convertido en una opción con gran potencial frente a métodos de almacenamiento tradicionales. Sin embargo, esta migración también ha evidenciado la importancia de mantener la privacidad de los datos.

Por ello es importante que los profesionales en Data y Cloud Engineer conozcan los principios básicos de la seguridad en la nube, así como identificar sus beneficios y limitaciones para convertirlo en una ventaja competitiva y garantizar un uso responsable frente a las numerosas amenazas que se presentan en el entorno digital.

El dominio de las soluciones en la nube se está convirtiendo en un requisito indispensable para las empresas que desean llevar a cabo su transformación digital. Con el Máster en Data y Cloud Engineering aprenderás a desarrollar soluciones Cloud, gestionar infraestructuras escalables y diseñar arquitecturas de datos desde cero.

¿Por qué es esencial la seguridad en la nube?

La nube permite almacenar grandes volúmenes de datos, acceso a recursos desde cualquier lugar y el desarrollo de proyectos con la capacidad de escalar a gran velocidad. Pero estas ventajas también conllevan ciertos riesgos a tener en cuenta antes de escoger esta solución.

En primer lugar, la posible exposición de datos sensibles debido a errores y configuraciones incorrectas deberá controlarse de manera exhaustiva ya que podría poner en riesgo la fiabilidad de una empresa. El incumplimiento de normativas y regulaciones suponen diversas consecuencias legales y económicas. La pérdida o corrupción de datos también deberá tenerse en cuenta ya que pueden convertirse en un obstáculo para el trabajo realizado durante un largo periodo de tiempo.

Por tanto, invertir en seguridad será clave para tener un control casi absoluto de nuestros datos y la posibilidad de recuperarlos en caso de pérdida, reducir al mínimo los errores humanos y evitar el acceso a amenazas que quieran comprometer la reputación y viabilidad de la organización.

Principios básicos de seguridad en la nube

Para poder proteger los datos almacenados en la nube, es preciso que los expertos controlen diversos conceptos para asegurar la privacidad de la información recopilada, revisando de manera habitual todos ellos para evitar cualquier contratiempo.

Modelo de responsabilidad compartida

Es imprescindible que los ingenieros en la nube comprendan cómo se reparte la seguridad entre proveedor y cliente. Este reparto varía en función del modelo de servicio: en IaaS, el proveedor se encarga de la infraestructura física, mientras que el cliente gestiona sistema operativo, aplicaciones, datos y accesos; en SaaS, el proveedor asume casi todo salvo la configuración y gestión de usuarios. Entender estas diferencias permite implementar correctamente las políticas de seguridad en cada capa del stack y evitar puntos ciegos en la protección de los datos.

Cifrado de datos