El escenario es recurrente en muchos comités de dirección de medio mundo: inversiones millonarias en infraestructura de datos, un equipo de científicos de datos brillante y un dashboard repleto de predicciones precisas. Sin embargo, cuando llega el momento de pulsar el botón y cambiar, por ejemplo, el rumbo de la estrategia logística o de los precios basándose en modelos de IA, el directivo no lo tiene tan claro.

A pesar de que, cada vez más, vemos como esta tecnología hace realidad la promesa de transformar industrias, pasando de proyectos piloto a despliegues reales, existe una brecha crítica que preocupa a analistas, y es la desconexión entre la comprensión conceptual y la capacidad de ejecución real. Entender qué es un algoritmo no es lo mismo que confiar decisiones que puedan afectar al destino de una compañía.

Para liderar esta transformación, programas como nuestro Management & Leadership Executive Program, en colaboración con MIT Sloan School of Management, sitúa a los profesionales a la vanguardia de las últimas tendencias y desafíos para fortalecer las habilidades de toma de decisiones estratégica perfeccionando el modo de liderar.

Concepto vs. Estrategia

Para muchos líderes, el primer paso en la adopción de la IA ha sido puramente asimilativo. En seminarios y conferencias, la IA se presenta como un tótem de innovación y eficiencia. Esta familiaridad conceptual ha inflado las estadísticas y en mercados como el español, cerca del 95% de los directivos afirma estar estudiando cómo maximizar el valor de la IA, según el informe Kaspersky Gen AI Business Infiltration.

Sin embargo, estamos ante un espejismo de conocimiento. La mayoría de los programas de formación ejecutiva se han centrado en el “qué” pero han ignorado el “cómo”. Esto deja a los líderes con una comprensión periférica y es que conocen los beneficios, pero carecen de un mapa para traducir esos datos en decisiones robustas.

Para transformar la comprensión en acción, el liderazgo debe pivotar hacia un modelo de gestión basado en cinco pilares:

- Formación práctica de negocio: sustituir la teoría por simulaciones de toma de decisiones basadas en datos reales.

- Gobernanza y ética: crear protocolos de auditoría que hagan transparente el proceso de la IA, eliminando el miedo a la caja negra.

- Cultura de experimentación: Fomentar un entorno donde el uso de IA sea iterativo. Es mejor fallar en pequeño con un algoritmo que fracasar en grande por ignorarlo.

- Silos rotos: Integrar a los científicos de datos en las unidades de negocio. El técnico debe entender el balance y el gestor debe entender el dato.

- Métricas de impacto: No medir el éxito de la IA por su precisión técnica, sino por su impacto en los objetivos de negocio (ventas, costes, retención).

Y es que bien la IA no va a sustituir a los directivos, los directivos que sepan usarla sí sustituirán a los que solo la entienden en teoría. Por ello, es esencial, afrontar los siguientes frenos de innovación.

El factor confianza

La IA, especialmente el Deep Learning y los modelos generativos, opera a menudo bajo una gran opacidad técnica. Recibe datos y devuelve recomendaciones, pero el proceso intermedio es invisible, y este efecto de “caja negra” es el mayor enemigo de la ejecución.

Un directivo está entrenado para justificar cada paso de su lógica ante accionistas y equipos. Cuando una recomendación de la IA contradice la experiencia acumulada durante décadas, el instinto humano es rechazarla. Sin una IA explicable (XAI), el líder siente que aceptar la sugerencia de la máquina es ceder el control.

La trampa del departamento de TI

Históricamente, la IA se ha tratado como un proyecto tecnológico relegado al CIO o al departamento de ciencia de datos y esto es un error de diagnóstico. Cuando la responsabilidad de la IA recae solo en los técnicos, la tecnología se convierte en un experimento aislado, desconectado de los dolores reales del negocio.

Como consecuencia, los ejecutivos no utilizan la IA como palanca de decisión y, por tanto, no definen qué decisiones concretas debería mejorar ni qué métricas de negocio deberían verse impactadas. El resultado es una IA que optimiza problemas técnicos relevantes, pero permanece desconectada de las prioridades estratégicas.

A pesar de la bien intencionada retórica de la formación continua, persiste una brecha de habilidades técnica en los niveles C-Suite, con programas centrados en el liderazgo, la gestión humana y la estrategia financiera, dejando la tecnología como una competencia de soporte.

El problema no es que el CEO no sepa programar en Python, es que no sabe cómo integrar la tecnología en los flujos de trabajo existentes. El mercado exige alfabetización digital, entender los límites éticos, gestionar los riesgos de sesgo y saber interpretar una probabilidad estadística como una herramienta de gestión, no como una verdad absoluta.

El muro cultural

La introducción de la IA en la toma de decisiones no es un cambio de software, es un cambio de identidad. Para muchos cuadros medios y altos, la automatización de decisiones se percibe como una amenaza a su autonomía y estatus.

Esta resistencia cultural se manifiesta como escepticismo o, peor aún, como sabotaje pasivo, de manera que se ignoran los análisis de datos valiosos en favor de la experiencia personal. En culturas organizacionales donde no se fomenta la experimentación, el error de una máquina se castiga con más severidad que el error de un humano, lo que desincentiva cualquier intento de innovación real en los procesos decisionales.

No obstante, también hay que ser precavidos, ya que aquí también reside el nudo normativo y ético, porque las recomendaciones de la IA no asumen responsabilidad legal ni reputacional. Si un algoritmo de riesgo crediticio falla y provoca una crisis de liquidez, la máquina no irá al juzgado ni dará explicaciones a la prensa.

Sin embargo, este escenario está empezando a cambiar. La entrada en vigor de marcos regulatorios como el AI Act europeo o la directiva NIS2 marca un punto de inflexión al establecer obligaciones claras en materia de gobernanza, supervisión humana y rendición de cuentas. Lejos de ser un obstáculo, esta regulación ofrece a las organizaciones el andamiaje necesario para integrar la IA en la toma de decisiones de forma responsable, alineando innovación, control y confianza.

El retorno de la inversión

A pesar de los obstáculos, los datos son optimistas para quienes cruzan el abismo. Estudios de centros como el MIT Sloan demuestran que las organizaciones que logran una simbiosis real entre humano y máquina ven mejoras de doble dígito en eficiencia y reducción de sesgos.

Más de la mitad de los líderes empresariales que han superado la barrera de la ejecución informan que la IA no solo acelera las decisiones, sino que eleva la calidad estratégica de las mismas. La IA permite pasar de una gestión reactiva a una proactiva, liberando al directivo para enfocarse en la visión a largo plazo.

La inteligencia artificial ya permite transformar una idea en texto, imagen o música en segundos. Sin embargo, la creación de mundos tridimensionales interactivos en tiempo real ha sido hasta ahora un terreno reservado a estudios especializados en videojuegos y simulación avanzada. Tecnologías como Project Genie 3 comienzan a cambiar ese paradigma, abriendo nuevas posibilidades en educación, entrenamiento, investigación o robótica.

Este avance también redefine las habilidades necesarias. La generación de experiencias inmersivas con IA ya no es exclusiva de grandes equipos técnicos, sino una oportunidad para profesionales formados en modelos generativos y desarrollo de soluciones inteligentes, como los que prepara nuestro Curso de IA para desarrolladores.

¿Qué es Project Genie 3?

Project Genie 3 es un sistema de generación de mundos 3D interactivos basado en inteligencia artificial desarrollado por Google DeepMind, que crea entornos explorables a partir de descripciones de textos o imágenes. A diferencia de las herramientas tradicionales de renderizado o de generación de vídeo que reproducen contenidos estáticos o pre-grabados, Genie 3 genera mundos dinámicos que puedes recorres, modificar y experimentar en tiempo real.

La parte más innovadora de este sistema es la capacidad para entender instrucciones del usuario y transformar esa entrada en espacios tridimensionales navegables. Este avance supera de forma significativa las generaciones anteriores de IA.

¿Cómo funciona?

La tecnología que hace posible Project Genie 3 combina varias innovaciones de IA:

- Interpretación del lenguaje natural: El sistema utiliza un modelo de procesamiento del lenguaje que entiende las descripciones que el usuario introduce en lenguaje cotidiano. No importa si la descripción es detallada o abstracta, el modelo interpreta la intención y la convierte en parámetros que guían la generación del espacio.

- Generación de mundos en tiempo real: Una vez procesada la entrada, la plataforma utiliza la arquitectura de Genie 3 World Model para crear una simulación interactiva en tiempo real. A diferencia de los motores de videojuegos más comunes hasta el momento, que requieren mapas predefinidos o activos modelados previamente, Project Genie 3 genera cada fotograma según tus acciones y movimientos, creando un mundo que se despliega de forma continua.

- Exploración interactiva Los mundos generados pueden ser explorados con controles estándar con una tasa de 24 fotogramas por segundo (FPS) y resolución 720p, lo que garantiza una experiencia fluida y reactiva conforme caminas, corres o te desplazad por el entorno.

- Memoria y consistencia del mundo: Esta herramienta recuerda lo que ya se ha generado y mantiene la coherencia espacial cuando se regresa a zonas visitadas anteriormente. Esa memoria persistente es clave para mantener la sensación de estar dentro de un mundo real.

- Modificación dinámica: Durante la exploración, puedes introducir nuevas instrucciones de texto para cambiar el mundo como hacer que llueva, añadir montañas, transformar edificaciones o incluso alterar la fauna del lugar. Estos cambios se integran sin interrupciones, lo que permite un control creativo continuo sobre el entorno.

Aplicaciones prácticas

Las implicaciones de una herramienta capaz de generar mundos interactivos van mucho más allá del entretenimiento. Aunque el desarrollo de videojuegos es el uso más evidente, el verdadero potencial está en cómo acelera procesos creativos y técnicos en diferentes industrias. En el ámbito del gaming permite prototipar escenarios completos sin necesidad de modelar manualmente cada elemento o diseñar mapas desde cero. Los equipos pueden probar ideas de niveles, experimentar con mecánicas y ajustar conceptos narrativos con una agilidad que reduce tiempos y costes en fases tempranas de desarrollo.

En educación e investigación, el impacto puede ser igual de significativo. La posibilidad de generar entornos inmersivos bajo demanda abre la puerta a explorar reconstrucciones históricas, ecosistemas complejos o modelos astronómicos en forma interactiva. Los estudiantes pueden recorrer escenarios, contextualizar conceptos y reforzar el aprendizaje a través de la experiencia directa.

La industria audiovisual también encuentra aquí una herramienta estratégica. Directores y equipos de producción pueden previsualizar sets y escenas antes de construir decorados físicos o invertir en costosos procesos de renderizado. Recorrer un escenario generado por IA facilita decisiones creativas y técnicas en fases de planificación, reduciendo incertidumbre y optimizando recursos.

En el ámbito de la simulación y la robótica, es especialmente práctica. Los mundos generados pueden utilizarse como entornos de entrenamiento para agentes autónomos, permitiendo simular condiciones variadas sin los costes asociados a pruebas reales. Este tipo de simulaciones resulta clave en el desarrollo de vehículos autónomos y sistemas robóticos que necesitan adaptarse a entornos cambiantes.

También en arquitectura y diseño se abren nuevas posibilidades. La capacidad de generar espacios navegables antes de su construcción física permite evaluar proporciones, iluminación, distribución o impacto ambiental sin salir del entorno digital. Más que una visualización estética, se trata de experimentar el espacio antes de materializarlo.

Limitaciones actuales y retos por delante

A pesar de su potencial, Project Genie 3 no está exento de limitaciones. Al tratarse de una tecnología emergente, sus capacidades aún están acotadas:

- Duración de sesión limitada: la exploración continua en única generación está restringida a aproximadamente 60 segundos por sesión según diversas pruebas y experiencias de usuarios.

- Resolución y fidelidad visual: la calidad 720 y 24 FPS, aunque adecuada para prototipos, puede resultar insuficiente para aplicaciones cinematográficas o gráficos ultrarrealistas.

- Comportamiento físico y realismo: aunque el modelo simula física emergente, su comportamiento todavía puede presentar incoherencias o glitches en ciertos escenarios complejos.

- No remplaza a los motores de juego tradicionales: expertos señalan que, pese a su potencial, esto no sustituye completamente a motores de juego como Unity o Unreal, que integran reglas, mecánicas y sistemas complejos de interacción.

Estos límites dejan claro que, aunque revolucionario, Project Genie 3 es la primera etapa de lo que puede llegar a ser la IA aplicada a mundos interactivos. El futuro probablemente traerá iteraciones más robustas, con sesiones más largas, mejores gráficos y una integración más profunda con flujos de creación digital existentes.

Más allá de sus aplicaciones prácticas, este tipo de tecnologías representan un avance hacia la inteligencia artificial general (AGI). La capacidad de generar mundos interactivos a partir de lenguaje natural marca un antes y un después en la relación entre idea y ejecución.

La inteligencia artificial, el análisis de datos o la automatización avanzan a una velocidad difícil de seguir. Las herramientas se multiplican, los modelos mejoran y las promesas de eficiencia parecen ilimitadas. Sin embargo, la verdadera pregunta no es qué puede hacer la tecnología, sino qué son capaces de hacer las organizaciones con ella.

En ese contexto, el reconocimiento a Fabiola Pérez, CEO y cofundadora MIOTI, en la XIII edición de Las Top 100 Mujeres Líderes en España de El Español y Magas es más que un sello. Refleja una trayectoria de más de 20 años en el sector, en la que ha sabido anticipar el impacto de la IA en los modelos de negocio y transformar una brecha estructural, la de la escasez de talento especializado en IA y Data Science, en un proyecto empresarial sólido y de referencia.

En datos, este reconocimiento esconde grandes hitos. Desde MIOTI, Fabiola ha impulsado un modelo pionero que conecta formación tecnológica, empresa y aplicación práctica, formando a más de 6.700 profesionales y alcanzando un 100% de empleabilidad en seis meses (y un 70% en menos de tres). Un enfoque que se refuerza con alianzas estratégicas con instituciones como el MIT y UTAMED, y con el reconocimiento de Forbes como una de las mejores escuelas de negocio.

Más allá de MIOTI, Fabiola también destaca por su trayectoria como emprendedora, incluyendo la co-creación de TheCUBE, Unlimiteck o MINEO, y contribuyendo activamente al desarrollo del ecosistema de innovación y al aterrizaje real de la inteligencia artificial en el tejido empresarial.

Este tipo de trayectorias no solo explican un reconocimiento como el de Las Top 100, sino que también ayudan a entender cómo está evolucionando hoy el liderazgo en innovación.

Un liderazgo que conecta tecnología y realidad

Durante años, el discurso sobre innovación ha estado dominado por la tecnología. Big Data, inteligencia artificial o automatización se han convertido en términos habituales en cualquier conversación empresarial. Sin embargo, a medida que estas tecnologías han madurado, ha quedado claro que el verdadero reto no es técnico, es organizativo y cultural.

Las empresas pueden adquirir herramientas avanzadas, contratar consultoras especializadas o implementar nuevas plataformas, pero eso no garantiza una transformación real. El cambio ocurre cuando el conocimiento tecnológico se integra en la forma de trabajar, en la toma de decisiones y en la estrategia del negocio.

Si echamos la vista atrás, durante años se ha hablado intensamente de tecnología, especialmente sobre IA, pero muchas organizaciones no sabían cómo aterrizarla en su realidad. En ese proceso, el papel del discurso público ha sido clave para traducir conceptos complejos en aplicaciones concretas. En este ámbito, Fabiola Pérez lleva años desempeñando un papel protagonista en la divulgación de conocimiento, a través de su participación en foros estratégicos, encuentros empresariales y espacios de reflexión sectorial, así como mediante colaboraciones en medios y la generación de contenidos propios.

Un termómetro del talento femenino

Las Top 100 Mujeres Líderes en España funcionan también como un termómetro del talento que está marcando el rumbo en distintos sectores. Desde su creación, este ranking ha ido ampliando su mirada para incluir perfiles procedentes de ámbitos muy diversos: empresa, investigación científica, cultura, deporte o gestión pública.

En el caso del sector tecnológico, durante años, el liderazgo en tecnología se asoció casi exclusivamente al desarrollo técnico o a perfiles muy especializados. Hoy, sin embargo, el impacto real suele venir de quienes construyen estrategia empresarial, talento y, en definitiva, transforman organizaciones.

Por eso, que perfiles vinculados al mundo del dato, la IA o la educación tecnológica aparezcan cada vez con más frecuencia en este tipo de reconocimientos refleja algo más profundo que un premio puntual. También ayuda a visibilizar referentes en sectores donde el talento femenino todavía está ganando presencia.

Ver a mujeres como Fabiola en la cima de un sector tradicionalmente masculinizado tiene un efecto directo sobre nuevas generaciones. Cuando estos referentes se hacen visibles, amplían el imaginario profesional y muestran caminos que antes podían parecer inaccesibles. Para muchas jóvenes que están decidiendo su futuro académico o profesional, conocer a líderes que combinan innovación, visión estratégica y ejecución práctica puede marcar una diferencia real.

Diversidad y toma de decisiones

Más allá de la representación, la diversidad también tiene un impacto muy concreto en la forma en que las organizaciones toman decisiones.

Numerosos estudios sobre innovación coinciden en que los equipos diversos tienden a analizar los problemas desde más perspectivas, cuestionar supuestos establecidos y detectar riesgos que, en entornos homogéneos, podrían pasar desapercibidos.

Las empresas que están logrando adaptarse con mayor rapidez a los cambios tecnológicos suelen tener algo en común, como equipos multidisciplinares, con perfiles diversos y con capacidad para combinar conocimiento técnico, visión estratégica y comprensión del mercado. Fabiola y su equipo en MIOTI refleja precisamente esa filosofía, donde la diversidad no es un valor simbólico, sino un motor de competitividad y de innovación aplicada.

El papel de la formación continua

Otro valor diferencial que ha conseguido el nombramiento de Fabiola por segundo año consecutivo es su mirada hacia la formación actual. En un entorno profesional que cambia tan rápido, la formación continua se ha convertido en una parte esencial de la trayectoria de los profesionales. El aprendizaje ya no ocurre únicamente en las primeras etapas de la carrera, forma parte del propio trabajo.

Esa es la verdadera frontera de la innovación. Mientras la inteligencia artificial y la automatización sigan transformando nuestra forma de trabajar, el factor diferencial seguirá siendo profundamente humano a través de la capacidad de conectar el dato con el negocio y la tecnología con la cultura organizativa. Es lo que marca la diferencia entre simplemente adoptar una herramienta o liderar un mercado.

Reconocimientos como el de Las Top 100 Mujeres Líderes a perfiles como el de Fabiola Pérez nos recuerdan precisamente que la innovación no consiste solo en desarrollar nuevas herramientas, sino en construir los entornos donde esas herramientas generen valor real.

En MIOTI, seguimos trabajando cada día para que ese entorno sea una realidad. Nuestra misión, además de la enseñanza técnica, es formar a esos “traductores” y líderes que el futuro demanda. Porque, en última instancia, innovar no es simplemente “hacer” tecnología. Es aprender a desarrollarla y utilizarla con criterio, con propósito y con una visión capaz de transformar las organizaciones desde dentro. Es el compromiso de seguir construyendo el futuro a través del talento.

Hace unos días nos tomamos un momento para reunirnos en Madrid con periodistas y compartir algo más que cifras: quisimos explicar qué hay detrás de nuestros resultados de 2025 y qué está pasando realmente en el mercado de la inteligencia artificial. Porque hoy la IA ya no es una tendencia emergente, es el entorno en el que operan empresas y profesionales. Y eso exige adaptación constante, pensamiento crítico y una nueva forma de entender la ventaja competitiva

En ese contexto, 2025 ha sido para MIOTI un año de consolidación. Cerramos con más de 6.700 profesionales formados desde nuestra fundación hace siete años. Pero más allá de los números, lo que reflejan estos datos es que el mercado está premiando una formación tecnológica práctica, aplicada y conectada con la realidad empresarial.

Durante el encuentro también compartimos cómo hemos reforzado nuestras alianzas estratégicas, con el desarrollo de programas conjuntos con entidades de renombre como Securitas Direct, la continuidad de nuestra colaboración con el Massachusetts Institute of Technology (MIT) y nuevos acuerdos institucionales con otras entidades educativas. Además, Forbes nos reconoció en 2025 como una de las mejores escuelas de negocio, un respaldo que refuerza el camino recorrido.

Empleabilidad del 100% en menos de seis meses

Sin embargo, el dato que más conversación generó no fue el crecimiento, sino la empleabilidad, y es que el 100% de nuestros graduados accede al mercado laboral en menos de seis meses y un 70% lo hace en menos de tres. Algo tan sorprendente como cierto, y en un mercado saturado de promesas formativas, este es el indicador que realmente mide nuestro impacto.

El desayuno también nos permitió repasar el trabajo de investigación y análisis que hemos ido impulsando a lo largo del año. Desde informes sectoriales sobre IA Generativa en Gran Consumo y Distribución, hasta encuentros como el Data Talent Innovation Summit, en MIOTI no solo formamos profesionales, también contribuimos activamente a la conversación pública como fuente experta en inteligencia artificial, datos y transformación digital.

En esa misma línea, presentamos durante el encuentro un nuevo estudio centrado en la percepción del mercado de la IA desde dentro. No desde la teoría ni desde el discurso corporativo, sino desde la experiencia directa de más de 130 profesionales especializados en IA y Data que trabajan cada día con estas tecnologías y que han sido formados en nuestras aulas. Un análisis que pone el foco en cómo viven la aceleración, qué habilidades se consideran realmente diferenciales y cómo está cambiando su forma de competir en un entorno cada vez más exigente.

La hipercompetencia como nueva normalidad

El estudio “Percepción del ritmo de avance de la IA”, presentado durante el desayuno por Fabiola Pérez, CEO y cofundadora de MIOTI, confirma que la competencia ya no es un momento puntual de tensión, es el estado natural del mercado, y la aceleración es el contexto permanente en el que operan los profesionales.

El 82% de los encuestados sitúa la formación práctica como el principal factor para competir. No se trata de acumular certificaciones, sino de saber aplicar modelos, resolver problemas reales y tomar decisiones con criterio. Este dato redefine por completo qué significa “estar preparado”, ya que la preparación ahora no se mide por cuánto sabes, sino por cuánto impacto eres capaz de generar desde el primer momento.

Además, el 46,9% señala la actualización constante de contenidos como un elemento crítico y el 42,2% destaca la importancia de la mentorización personalizada. La especialización ya no sigue un recorrido lineal; es dinámica, fragmentada y estratégica. Exige aprender, desaprender y volver a aprender con rapidez.

Pero quizá el hallazgo más revelador no es técnico, sino emocional. Teniendo en cuenta que el 34,3% percibe el ritmo del sector como especialmente acelerado y exigente, un 28,1% reconoce sentir ansiedad por no “llegar a todo” y un 13,3% admite sentirse abrumado ante la aparición constante de nuevas herramientas. Sin embargo, al mismo tiempo, un 30,5% afirma que esta evolución le resulta inspiradora y un 21,1% se mantiene alerta sin experimentar estrés negativo.

Esta dualidad demuestra que la IA no solo está transformando procesos, sino también la vivencia psicológica del trabajo. La presión proviene de la competencia externa, sí, pero también del propio ritmo de la innovación. Y, lejos de paralizarse, los profesionales están respondiendo, buscando comunidad, formación especializada y espacios donde actualizarse con criterio.

Formación continua como sistema operativo profesional

Uno de los mensajes más claros del encuentro fue que el aprendizaje ya no es una fase previa al empleo: es el propio empleo. El 50,8% de los encuestados identifica mantener un nivel de especialización diferencial como su principal reto. Algo especialmente importante si tenemos en cuenta que las herramientas evolucionan constantemente y que quedarse quieto equivale a quedarse atrás.

Esto obliga a replantear la carrera profesional. Ya no se construye en etapas cerradas de formación, inserción y consolidación, sino en ciclos continuos de actualización, aplicación y redefinición. La ventaja competitiva se desplaza del conocimiento estático a la agilidad intelectual, y saber formular la pregunta adecuada, validar resultados y contextualizar datos con criterio son ahora capacidades clave del trabajo con IA. El verdadero valor no está en las respuestas, está en quien sabe interpretarlas.

Quizá la conclusión más relevante de la extensa conversación que mantuvimos durante el desayuno es que el mercado de la IA ha entrado en una fase de madurez. La IA es en 2026 una infraestructura transversal que atraviesa sectores, funciones y decisiones estratégicas, y en ese contexto, la formación debe mantenerse alineada para aportar valor.

De la eficiencia a la ventaja estratégica

Antes de cerrar el encuentro y continuar la conversación de manera más distendida, Esther Morales, directora de Desarrollo de Negocio de MIOTI Data & AI Services, también puso el foco en el paso de la eficiencia operativa a la verdadera ventaja estratégica.

Durante su intervención, se abordó el papel de MIOTI Data & AI Services como brazo consultor especializado en estrategia de datos e inteligencia artificial. Convertirse en una AI-Driven Company no consiste en incorporar herramientas de forma aislada, sino en integrar la IA en la lógica de decisión de la organización.

El salto estratégico se produce cuando la inteligencia artificial deja de ser un soporte y pasa a redefinir el modelo de negocio, abrir nuevas líneas de ingresos o transformar la propuesta de valor. No es solo una cuestión de productividad; es una cuestión de posicionamiento competitivo.

En MIOTI contamos con una posición diferencial en este proceso. Nuestro modelo combina la escuela y la consultoría, lo que nos permite nutrir la formación con la realidad del mercado y, al mismo tiempo, fortalecer la práctica consultora con profesionales formados específicamente en datos e inteligencia artificial. Esa conexión constante entre aprendizaje y aplicación real es lo que nos permite acompañar a empresas y talento con una visión completa y actualizada.

Mirando hacia 2026: líderes con criterio

Queremos terminar agradeciendo a todos los periodistas y medios que, a lo largo del año, se hacen eco de nuestros estudios, comunicados, entrevistas y encuentros. Vuestra labor es clave para que la conversación sobre inteligencia artificial, datos y transformación digital llegue más lejos y con mayor profundidad. Gracias por acompañarnos, por preguntar, por contrastar y por ayudarnos a dar contexto a un debate que ya es estructural para empresas y profesionales.

¡Nos vemos en la próxima!

Cada persona posee miles de pequeñas variaciones en su ADN. La mayoría son completamente inocuas, simples diferencias naturales entre individuos. Sin embargo, algunas pueden alterar proteínas esenciales para el funcionamiento del organismo y, en consecuencia, desencadenar enfermedades graves. El reto para la genética clínica ha sido siempre distinguir qué variantes son realmente dañinas y cuáles no tienen relevancia médica. Esta tarea, lejos de ser trivial, ha requerido durante décadas un enorme trabajo manual, criterios múltiples y, a menudo, un grado significativo de incertidumbre.

La aparición de PopEVE, un nuevo modelo de inteligencia artificial desarrollado conjuntamente por el Centro de Regulación Genómica (CRG) en Barcelona y la Harvard Medical School, supone un avance notable en este campo. No se trata de una herramienta mágica ni de un sustituto del diagnóstico clínico, pero sí de un sistema que podría acelerar y afinar la interpretación de variantes genéticas, especialmente en el contexto de enfermedades raras, donde cada minuto cuenta y la información suele ser escasa.

En MIOTI, programas como el Máster en Inteligencia Artificial permiten a los profesionales prepararse para participar en esta transformación que ya está redefiniendo el futuro.

Qué es PopEVE y por qué representa un salto cualitativo

PopEVE nace como evolución del modelo EVE (Evolutionary model of Variant Effect), un enfoque generativo que aprende de la historia evolutiva de las proteínas. La premisa es sencilla pero poderosa: millones de años de selección natural han “probado” infinidad de variantes. Las posiciones de una proteína que se mantienen idénticas entre especies suelen ser críticas para su función; las regiones donde la evolución permite cambios suelen ser más tolerantes a mutaciones. EVE capturaba esta lógica mediante modelos generativos, pero presentaba limitaciones a la hora de comparar la “gravedad” de mutaciones entre genes distintos.

PopEVE introduce mejoras clave que lo convierten en un modelo más robusto y clínicamente útil. Por un lado, incorpora un gran modelo tipo language model para proteínas, capaz de identificar patrones complejos en secuencias, dependencias entre posiciones que están distantes en la estructura tridimensional o firmas evolutivas que no son evidentes para métodos más clásicos. Por otro lado, añade una calibración basada en la variación genética humana real, utilizando bases de datos poblacionales como gnomAD para ajustar sus predicciones y hacerlas comparables entre distintos genes. El resultado es una puntuación unificada que indica la probabilidad de que una variante sea dañina.

Esta capacidad es especialmente importante en genética clínica. Cuando se secuencia el genoma completo de un paciente con una enfermedad rara, pueden aparecer miles de variantes. La pregunta crítica es: ¿cuáles de ellas tienen relevancia patogénica? PopEVE no da una respuesta definitiva, pero sí ayuda a priorizar de manera más eficaz qué mutaciones merece la pena estudiar primero. En enfermedades donde la ventana diagnóstica es estrecha, este filtrado inteligente puede marcar una diferencia significativa.

Cómo funciona: entre la evolución, la IA y la genética humana

El funcionamiento de PopEVE combina varias fuentes de información en un esquema complementario:

- Señal evolutiva: analiza cómo han cambiado las proteínas a lo largo de la evolución. Si una posición apenas varía en múltiples especies, es probable que sea funcionalmente crítica.

- Modelos lingüísticos de proteínas: las grandes redes neuronales para secuencias proteicas pueden detectar patrones que no aparecen en alineamientos tradicionales, como comorbilidades estructurales o interacciones indirectas entre aminoácidos.

- Datos de población humana: ajusta sus predicciones teniendo en cuenta qué variantes aparecen (y con qué frecuencia) en personas sanas, evitando falsos positivos en genes más tolerantes a mutaciones.

La combinación de estas capas permite estimar la probabilidad de que una variante missense altere de forma significativa la función de la proteína correspondiente. Esto no sustituye a la información clínica, pero sí aporta una señal cuantitativa que orienta la interpretación de variantes desconocidas.

Qué muestran los resultados: avances significativos, pero no milagrosos

En artículos científicos y reportes divulgados, PopEVE ha demostrado un rendimiento notable en contextos clínicos reales. Un ejemplo especialmente ilustrativo procede de un estudio con miles de familias afectadas por trastornos del desarrollo. En un subconjunto de 513 casos donde las mutaciones eran completamente nuevas, es decir, nunca observadas previamente en humanos, PopEVE logró identificar la variante más probable de causar la enfermedad en aproximadamente el 98% de ellos. Esta cifra no implica certeza diagnóstica, pero sí una capacidad sobresaliente para orientar la atención de los genetistas.

Además, el modelo señaló 123 genes candidatos que podrían estar implicados en trastornos del desarrollo y que hasta ahora no habían sido asociados a estas condiciones. Estos hallazgos abren la puerta a nuevas líneas de investigación.

Los autores también subrayan algunos beneficios prácticos: mejor rendimiento en poblaciones no europeas en ciertos benchmarks (algo relevante dado el sesgo histórico hacia genomas europeos en investigación genética) y menor huella computacional respecto a otros modelos de tamaño similar, lo que facilita su adopción en entornos clínicos con recursos limitados.

Impacto potencial: qué podría cambiar en los próximos años

Aun con estas limitaciones, PopEVE apunta hacia una la integración de herramientas de IA en la práctica rutinaria de la genética médica. Su utilidad es especialmente evidente en:

- Diagnósticos de enfermedades raras cuando no se dispone de datos parentales.

- Casos donde aparece una variante completamente nueva sin evidencia previa.

- Priorizar genes para estudios funcionales y profundizar en investigación biomédica.

- Extender capacidades diagnósticas a países o centros con menos infraestructura tecnológica, algo que ya está ocurriendo en colaboraciones en lugares como Senegal.

A medio plazo, es razonable prever la incorporación de modelos híbridos que combinen IA basada en evolución, modelos lingüísticos, datos clínicos electrónicos y resultados de ensayos experimentales como el deep mutational scanning. Estas integraciones producirán predicciones más robustas y estandarizadas, alineadas con los criterios clínicos actuales.

La inteligencia artificial se ha convertido en un factor estructural de competitividad empresarial. Su adopción masiva impulsada por el auge de la IA generativa y las plataformas de análisis en tiempo real ha alterado el núcleo de la toma de decisiones. Este ecosistema está transformando los roles directivos, especialmente los del Chief Data Officer (CDO) y el Chieff Technology Officer (CTO), que pasan de funciones técnicas a posiciones estratégicas clave.

En esta transición de la gestión técnica del dato y la tecnología a la responsabilidad directa sobre gobernanza y valor de negocio, nuestro AI & Data Strategy Executive Program acompaña a profesionales a trazar un camino de transformación corporativa hacia estrategias empresariales fundamentadas en la IA y los datos.

Roles bien definidos en la era pre-IA

Durante años y antes de la explosión de la IA empresarial, las responsabilidades del CDO y CTO estuvieron claramente delimitadas. El CDO asumía la gobernanza, la calidad y el cumplimiento normativo de los datos. Era el custodio de un activo valioso, aunque a menuda infrautilizado, almacenado en grandes repositorios con poco impacto directo en la decisión diaria.

El CTO, por su parte, se centraba en la arquitectura tecnológica, la escalabilidad de los sistemas y la fiabilidad de la infraestructura. Su éxito se medía en términos de estabilidad, seguridad y eficiencia operativa.

La IA ha diluido esas fronteras. Ya no basta con disponer de datos bien gestionados ni con infraestructuras robustas, lo relevante es cómo ambos elementos se combinan para generar inteligencia aplicada. La tecnología deja de ser solo soporte y el dato deja de ser solo registro, juntos, se convierten en un sistema capaz de aprender, anticipar y recomendar acciones.

El CDO en la era de la decisión automatizada

La IA ha elevado la función del CDO desde la gestión del dato hacia la orquestación de decisiones basadas en datos. El foco ya no está únicamente en garantizar calidad o cumplimiento, sino en asegurar que los modelos que consumen esos datos generan valor real para el negocio.

Un análisis de Forbes de 2025 destaca que la IA generativa está empujando al CDO a abandonar una lógica centrada en dashboards retrospectivos para asumir un rol activo en sistemas que recomiendan y automatizan decisiones en tiempo real. El cambio es profundo: del “qué ha pasado” al “qué hacemos ahora”.

En la práctica, esto implica asumir nuevas responsabilidades clave, como garantizar la coherencia entre decisiones automatizadas y objetivos de negocio estratégicos; diseñar arquitecturas de datos preparadas para IA o demostrar el retorno económico de las iniciativas de IA mediante métricas claras como eficiencia operativa, reducción de riesgos o impacto en resultados. El éxito del CDO ya no se mide en volumen de datos gestionados, sino en impacto tangible en la cuenta de resultados.

Sin embargo, el entusiasmo no siempre se traduce en ejecución efectiva. Un informe del IBM Institute for Business Value revela que más del 80% de los CDO prioriza inversiones orientadas a acelerar capacidades de IA, pero muchas organizaciones siguen careciendo de las bases necesarias para escalar estas iniciativas. Solo una minoría dispone de arquitecturas de datos realmente consolidadas y de programas robustos de calidad del dato, y en numerosos casos el CDO ni siquiera lidera directamente la integración de la IA en los procesos críticos. Esta brecha entre ambición y ejecución refleja un reto estructural, la IA exige disciplina organizativa, cambios culturales y alineación transversal. Sin estos elementos, el riesgo es invertir en tecnología sin capturar su verdadero valor.

El CTO: de gestor tecnológico a líder de confianza

El impacto de la IA sobre el rol del CTO es igualmente profundo. En un entorno donde los algoritmos influyen en decisiones críticas, desde precios hasta concesión de crédito o selección de talento, el CTO asume un papel central en la construcción de confianza tecnológica.

Más allá de garantizar infraestructuras potentes, el CTO debe asegurar que los sistemas de IA sean seguros, explicables y sostenibles. Esto implica tomar decisiones estratégicas como elegir entre modelos propios o de terceros, definir arquitecturas híbridas o cloud, proteger la soberanía del dato y gestionar riesgos asociados a la ciberseguridad y a los modelos.

Además, el CTO actúa como traductor entre tecnología y negocio. Su capacidad para explicar a la alta dirección cómo una decisión técnica impacta en la cadena de valor resulta clave para alinear innovación y resultados, evitando la desconexión entre la sofisticación tecnológica y las prioridades estratégicas.

Gobernanza, ética y explicabilidad: una responsabilidad compartida

La IA introduce un tipo de complejidad inédita. A diferencia del software tradicional, los modelos aprenden, evolucionan y pueden comportarse de forma inesperada. Por ello, la gobernanza deja de ser un complemento y se convierte en un pilar estratégico.

CDO y CTO comparten ahora la responsabilidad de diseñar sistemas que sean transparentes, auditables y justos. Esto implica poder explicar por qué un algoritmo toma una determinada decisión, vigilar y mitigar sesgos derivados de datos históricos y cumplir con marcos regulatorios cada vez más exigentes, como el AI Act de la Unión Europea. La clave está en integrar estos principios desde el diseño, evitando soluciones opacas que generen riesgos reputacionales, legales o éticos difíciles de gestionar a posteriori.

Colaborar para escalar la IA

Uno de los cambios más relevantes es la desaparición práctica de los silos funcionales. La IA obliga a una colaboración estrecha entre datos, tecnología y negocio. Por ello, cada vez es más común la creación de equipos multifuncionales de IA, en los que CDO y CTO trabajan junto a CIOs, responsables de negocio y, en algunos casos, Chief AI Officers.

Esta colaboración responde a la complejidad del ciclo de vida de la IA, mientras el CDO asegura la calidad y el contexto del dato, el CTO habilita la infraestructura necesaria para entrenar y desplegar modelos de forma fiable. Ambos deben alinearse con el negocio para garantizar que los casos de uso resuelven problemas reales y no simples ejercicios tecnológicos. La IA no escala por acumulación de modelos, sino por coordinación organizativa.

Esta transformación también redefine el perfil de liderazgo requerido. El CDO y el CTO necesitan combinar capacidades técnicas con habilidades claramente humanas y estratégicas.

La gestión del cambio se vuelve crítica en un contexto donde la IA genera incertidumbre sobre el empleo y los procesos. El pensamiento crítico y ético es imprescindible para evaluar no solo lo que es posible, sino lo que es conveniente. Y la comprensión profunda del modelo de negocio resulta esencial para identificar dónde la IA puede generar ventajas competitivas sostenibles.

En sus orígenes, el término Big Data comenzó a popularizarse a comienzos de los años 2000, cuando el volumen de información digital creció de forma exponencial con la expansión de Internet, los teléfonos inteligentes y las redes sociales. En aquel momento, el reto principal era puramente técnico: almacenar, procesar y gestionar enormes cantidades de datos que superaban las capacidades de las herramientas informáticas tradicionales. Empresas tecnológicas como Google, Amazon o Facebook impulsaron las primeras infraestructuras de datos masivos, sentando las bases de lo que hoy entendemos como analítica avanzada.

Con el paso del tiempo, el foco se desplazó desde la simple acumulación de información hacia su interpretación y aprovechamiento estratégico. El desarrollo de algoritmos de machine learning, la mejora de la capacidad computacional y la adopción de arquitecturas en la nube permitieron transformar datos sin estructura en conocimiento útil. Gracias a ello, el Big Data ha pasado de ser un desafío técnico a convertirse en un motor de innovación capaz de guiar decisiones en tiempo real. En la actualidad, ya cuenta con la capacidad de combinar datos heterogéneos, tan diferentes como los clínicos, genómicos, medioambientales, sociales o industriales, y promete aplicaciones en sectores fundamentales que moldearán la sociedad, como la salud, el medio ambiente, la economía o la educación.

En MIOTI, conocemos de primera mano su impacto real e impartimos el Máster en Data Science y Big Data para formar a profesionales en la gestión y el análisis de grandes volúmenes de datos y que los puedan transformar en conocimiento para impulsar su desarrollo profesional.

El auge del Big Data en las aplicaciones biomédicas

La combinación de grandes bases de datos genómicos, clínicos y de imágenes médicas está impulsando el desarrollo de modelos predictivos capaces de detectar enfermedades antes de que se manifiesten y de diseñar tratamientos personalizados. En España, ya existen proyectos que aplican inteligencia artificial en biomedicina para mejorar la prevención, la sostenibilidad del sistema sanitario y la eficiencia de los tratamientos.

Uno de los más significativos lo promueve el equipo de Ciencia de Datos Biomédicos de ISGlobal, que investiga métodos de IA explicable capaces de generar interpretaciones de modelos (por ejemplo, mostrando qué variables influyeron en una predicción), con el objetivo de que los profesionales médicos puedan comprender en mayor medida las decisiones de la IA. Esto es especialmente importante, ya que contribuye a aumentar la confianza y la seguridad en el uso de la IA en este ámbito.

Además, la participación del paciente en los nuevos procesos e investigación de diagnósticos impulsados por la tecnología también está creciendo, y cada vez se promueven más iniciativas para que las personas se involucren directamente en el uso de sus datos, siempre contando con su consentimiento y colaboración para mejorar la calidad y la representatividad en los resultados.

El poder del dato al servicio del medio ambiente

El Big Data se ha convertido en una herramienta clave para comprender los efectos del cambio climático, gestionar los recursos naturales y predecir desastres, contribuyendo a elaborar estrategias de salud planetaria basadas en la evidencia y apoyándose en fuentes diversas.

El auge de los sensores climáticos, las estaciones meteorológicas automatizadas, los drones y los satélites, entre otras cosas, está generando una gran cantidad de datos, como la radiación solar, las precipitaciones, la calidad del aire, la humedad del suelo, los niveles de contaminación o la biodiversidad microbiológica, consiguiendo monitorizar el entorno en tiempo real y mejorando la planificación.

Combinando estas fuentes con modelos estadísticos basados en machine learning, se pueden llevar a cabo acciones como:

- Construir mapas de riesgo ambiental en tiempo real.

- Anticipar fenómenos extremos como olas de calor, incendios o sequías.

- Analizar la evolución del cambio climático a escalas locales.

- Modelar impactos sobre la salud humana (por ejemplo, olas de calor y mortalidad).

- Optimizar políticas de mitigación y adaptación.

Gracias a ello, los expertos pueden anticiparse a distintos escenarios y ofrecer una visión más precisa del estado del planeta. Además, el uso de grandes volúmenes de datos en este ámbito permite implementar políticas públicas más sostenibles, apoyadas en la evidencia científica.

Retos del Big Data en la investigación biomédica, medioambiental y social

El uso del Big Data en la ciencia sigue planteando retos; entre ellos, la fragmentación de los datos es uno de los más complejos, ya que la información se encuentra dispersa en múltiples formatos y plataformas, lo que dificulta la interoperabilidad. Por ello, establecer estándares comunes de calidad, limpieza y gestión de datos es fundamental para facilitar su plena integración en estos ámbitos.

La privacidad es otro de los grandes desafíos, ya que los datos clínicos y genéticos deben protegerse conforme a normas estrictas de anonimización, seguridad y consentimiento. Y, por último, la integración institucional del Big Data exige una inversión significativa en infraestructura tecnológica, formación de equipos y financiación, para sostener su evolución y su impacto.

Datos, conocimiento y bienestar social

El horizonte del Big Data es amplio y prometedor, sobre todo en los campos que hemos visto. Entre las innovaciones más prometedoras que ya estamos viendo, encontramos desarrollos como los gemelos digitales para personalizar tratamientos clínicos, sistemas predictivos climatológicos que evolucionan hacia redes globales interconectadas, y el diseño de políticas más inclusivas y sostenibles que aspiran a regular una nueva era dominada por la tecnología que no pierda la conexión social.

Y es que, a medida que logremos armonizar la tecnología y la ética, el potencial del Big Data continuará creciendo para garantizar la transparencia algorítmica, la validación científica y la supervisión humana en cada fase. La IA y la analítica avanzada no han llegado para reemplazar el criterio humano, sino para complementarlo, amplificarlo y orientarlo. Eso sí, la era del dato demanda una nueva generación de profesionales capaces de convertir millones de registros en conocimiento útil que mejore el día a día y sirva de puente entre la tecnología, la ciencia y la sociedad.

En el escenario actual, la verdadera ventaja competitiva ya no pasa por adquirir el software más avanzado, sino por construir una buena cultura AI-Ready. Un saber en el que la cual las organizaciones sean capaces de entender, adoptar y escalar la inteligencia artificial de forma consciente, ética y sostenible. Ser AI-Ready no implica tener un ejército de científicos o expertos de datos ni desarrollar modelos propios desde cero. Significa algo mucho más profundo, contar con una cultura organizacional donde las personas, los procesos y la tecnología están alineados para aprovechar el potencial de la IA.

Las empresas con una cultura AI-Ready entienden qué puede y qué no puede hacer la IA, toman decisiones basadas en datos, fomenta la experimentación y el aprendizaje continuo e integra la IA como apoyo del talento humano no como un sustituto total. Es decir, la IA se convierte en una capacidad transversal.

Uno de los grandes mitos alrededor de la inteligencia artificial es creer que el principal desafío es técnico, y, en realidad, la mayoría de los fracasos en proyectos de IA se deben a la resistencia cultural, la falta de visión o expectativas irreales y no tanto a algoritmos defectuosos o errores técnicos.

Por eso, es importante contar con equipos formados y preparados. Implementar herramientas de IA sin preparar a las personas no sirve de mucho. Las organizaciones deben tener claro que construir una cultura AI-Ready es un proceso estratégico y humano, no solo tecnológico.

Los pilares de una cultura AI-Ready

- Liderazgo. Toda transformación cultural comienza desde arriba. Los líderes no tienen que ser expertos técnicos, pero sí deben comprender el impacto estratégico de la IA para ser capaces de comunicar una visión clara. Cuando los líderes muestran curiosidad y apertura el resto de la organización se siente más libre y con “permiso” para explorar.

- Alfabetización en IA. No todo el mundo necesita saber programar, pero sí tienen que comprender los conceptos básicos como; qué es un modelo de IA, cómo aprende, qué riesgos implica o en qué puede fallar. La alfabetización en IA no solo reduce miedos y resistencias, también mejora la colaboración entre equipos técnicos y no técnicos y permite identificar oportunidades reales de aplicación.

- Mentalidad de experimentación. La implementación de la inteligencia artificial dista mucho de ser un proyecto cerrado, con un inicio y un final claramente definidos. Más bien, se trata de un proceso vivo, en constante evolución, que exige ajustes continuos y una mejora permanente. En ese camino, la experimentación resulta inevitable y, con ella, la posibilidad de cometer errores que no deberían ser objeto de castigo, sino de aprendizaje. En este contexto, una cultura preparada para la inteligencia artificial, la llamada AI-Ready, asume el error controlado como un componente esencial del progreso y la innovación.

- Datos como activo estratégico. No hay inteligencia artificial sin datos de calidad, pero más allá de la infraestructura, el verdadero reto es cultural y pasar a valorar los datos como un activo común. Esto implica romper silos de información, establecer criterios claros de calidad y gobernanza y fomentar el uso de datos en la toma de decisiones cotidianas. Cuando los equipos confían en los datos y saben interpretarlos, la IA se convierte en una aliada natural.

- Ética, transparencia y responsabilidad. Por último, una cultura AI-Ready no se limita a perseguir mayores cotas de eficiencia; también pone el foco en la responsabilidad. La inteligencia artificial, mal gestionada, puede amplificar sesgos existentes, cometer errores o generar desconfianza. De ahí la importancia de ser transparentes sobre cuándo y cómo se utiliza, evaluar de forma sistemática sus impactos éticos y sociales y garantizar, en todo momento, la supervisión humana en las decisiones más sensibles.

La IA como complemento, no como amenaza

Uno de los mayores frenos culturales es el miedo a ser reemplazados. Las organizaciones AI-Ready cambian este enfoque y establecen que la inteligencia artificial no llega para quitar valor a las personas, sino a potenciarlo.

Automatizar tareas repetitivas libera tiempo para actividades creativas, estratégicas y humanas. Pero este mensaje debe comunicarse con claridad y respaldarse con acciones reales, como planes de reskilling y upskilling.

Pasos para empezar a construir una cultura AI-Ready

Hay que tener claro que no hace falta hacerlo todo a la vez ya que la clave está en la constancia, no en la velocidad. Algunos pasos prácticos para comenzar:

- Evaluar el nivel de madurez de la organización.

- Identificar casos de uso sencillos con impacto claro.

- Formar a equipos clave y crear embajadores internos.

- Comunicar avances, aprendizajes y resultados.

- Ajustar la estrategia de forma iterativa.

La tecnología se puede comprar, la cultura no. Dos organizaciones pueden disponer de las mismas herramientas de IA y, sin embargo, obtener resultados totalmente distintos. La diferencia no reside en el software, sino en las personas, en cómo lo comprenden, cómo lo integran en su trabajo diario y, sobre todo, en el grado de confianza que depositan en él.

Construir una cultura AI-Ready es una inversión a largo plazo, y al mismo tiempo, una de las pocas ventajas competitivas realmente difíciles de imitar. No surge de la noche a la mañana, es fruto de un liderazgo coherente, del aprendizaje continuo, del compromiso ético y de una visión compartida dentro de la organización. En un mundo donde a inteligencia artificial es cada vez más accesible, la verdadera diferenciación no vendrá de la tecnología en sí, sino de la capacidad de las empresas para convivir con ella de forma inteligente y responsable. Porque, al final, la ventaja competitiva más sólida no se descarga, sino se construye.

Como cada enero, el año nuevo llega cargado de propósitos. Organizarnos mejor, ser más productivos, avanzar en proyectos que llevamos tiempo posponiendo o encontrar un mejor equilibrio entre trabajo y vida personal suelen encabezar la lista. Sin embargo, la experiencia nos dice que, en muchos casos, la rutina acaba imponiéndose y esos objetivos se diluyen antes de que termine el primer trimestre. La gran diferencia respecto a otros años es que ahora contamos con un aliado real y accesible que puede ayudarnos a sostener esos propósitos en el tiempo: la inteligencia artificial.

Bien utilizada, la IA puede ayudarnos a planificar con más claridad, priorizar mejor, reducir la sensación de saturación y mantener el foco en lo importante. Puede actuar como una especie de copiloto estratégico que acompaña, ordena y aporta perspectiva. Pero para que eso ocurra, hay un paso previo imprescindible que muchas veces se pasa por alto.

Nuestro Curso de Inteligencia Artificial pone el foco en algo clave: no se trata solo de saber de tecnología, sino de aprender a utilizar la IA generativa con criterio, integrándola en los procesos diarios para multiplicar la productividad y descubrir nuevas formas de generar valor.

La organización es fundamental

Antes de abrir agendas, aplicaciones o herramientas de IA, conviene hacer una pausa. La inteligencia artificial es especialmente eficaz estructurando información, detectando patrones y proponiendo soluciones, pero necesita un punto de partida claro. Sin reflexión previa, cualquier sistema de organización corre el riesgo de convertirse en una lista interminable de tareas sin sentido.

Dedicar tiempo a hacerse preguntas sencillas puede marcar la diferencia. Por ejemplo: ¿qué funcionó bien en 2025 y merece la pena repetir?, ¿qué me generó estrés o me hizo perder tiempo?, ¿qué áreas de mi trabajo o de mi vida personal necesitan más atención en 2026? Este ejercicio de revisión no solo aporta claridad, sino que ayuda a definir objetivos más realistas y alineados con la situación actual.

No obstante, en este punto, la IA también puede ser una aliada útil. Un asistente conversacional puede ayudarte a diseñar un ejercicio de reflexión anual, ordenar ideas desordenadas o detectar patrones a partir de tus respuestas. No se trata de delegar el pensamiento, sino de utilizar la tecnología como un espejo que devuelve claridad y perspectiva.

De los objetivos a la acción

En lugar de empezar el año con una lista infinita de objetivos, puede ser más eficaz apoyarse en asistentes conversacionales para priorizar. La IA puede ayudarte a transformar metas generales en objetivos concretos y medibles, identificar qué tareas tienen mayor impacto, decidir qué puede esperar y dividir proyectos grandes en pasos asumibles. Este enfoque reduce la fricción inicial y facilita que la planificación se traduzca en acción.

Eso sí, conviene recordar que la planificación no debe ser rígida. Un sistema demasiado estricto suele generar frustración y abandono. Herramientas como Notion con IA integrada permiten centralizar proyectos, objetivos y revisiones periódicas en un mismo espacio. La IA puede resumir notas, generar listas de tareas o ayudarte a preparar revisiones semanales, aportando orden sin rigidez.

Por su parte, gestores de tareas inteligentes como Todoist permiten convertir objetivos en acciones claras y priorizadas, adaptándose al ritmo real de cada persona. El objetivo no es tener la agenda perfecta, sino un sistema asumible que aporte sensación de control y facilite avanzar paso a paso durante las primeras semanas de 2026.

Pero no todo es trabajo, organizar bien el inicio de año implica también cuidar el tiempo personal, el descanso y el bienestar. De hecho, uno de los errores más habituales en la planificación es tratar estos aspectos como secundarios, cuando son esenciales para sostener cualquier objetivo a medio y largo plazo.

Y en ello, empezar poco a poco es clave para evitar la presión excesiva. Bloquear tiempo para descanso, actividad física o desconexión debería tener la misma importancia que bloquear reuniones o entregas. Aquí, Google Calendar, combinado con funciones inteligentes, resulta especialmente útil para visualizar el tiempo disponible y detectar desequilibrios antes de que aparezcan el cansancio o la frustración y facilita ajustes a tiempo.

Mantener el foco en un entorno lleno de distracciones

Definir objetivos y organizar tareas es solo una parte del proceso. Mantener el foco a lo largo del tiempo sigue siendo uno de los mayores desafíos. La atención es un recurso limitado y, en un entorno lleno de estímulos, protegerla se vuelve fundamental.

La IA puede ayudar a crear sistemas sencillos pero efectivos para sostener ese foco. Por ejemplo, diseñar rutinas de inicio y cierre del día con ayuda de un asistente conversacional, generar listas claras de prioridades diarias a partir de objetivos mayores o programar recordatorios inteligentes para revisar avances. Estos pequeños sistemas reducen la dependencia de la motivación y facilitan la constancia.

En lugar de confiar únicamente en la fuerza de voluntad, se trata de diseñar un entorno que lo ponga fácil. Además, realizar revisiones periódicas (semanales o mensuales) ayuda a evaluar qué está funcionando, qué no y qué ajustes son necesarios. La IA puede apoyar estas revisiones ofreciendo resúmenes, detectando patrones o proponiendo mejoras basadas en el historial de actividad.

Si todo esto suena complejo, conviene quedarse con una idea clave: no hace falta acumular tecnología para organizarse mejor. De hecho, en muchos casos, menos es más. Con un conjunto reducido de herramientas bien utilizadas es posible construir un sistema sólido y sostenible desde el inicio de 2026.

Como hemos visto, tres herramientas pueden ser más que suficientes para empezar con orden y foco:

- Un asistente conversacional, como ChatGPT o Gemini, para pensar, priorizar, desbloquear momentos de saturación y aportar claridad mental.

- Notion con IA como espacio central para objetivos, proyectos y revisiones periódicas. Todo en un mismo lugar, evitando la dispersión de ideas y tareas.

- Google Calendar para visualizar el tiempo, bloquear espacios clave y asegurar que el descanso y la vida personal también tienen un lugar en la agenda.

Bien combinadas, estas herramientas permiten organizar trabajo, planificación y foco sin complicaciones innecesarias. La clave no está en hacer más, sino en hacerlo con sentido.

Empezar 2026 con orden no significa tenerlo todo bajo control desde el primer día. Significa construir un sistema flexible, consciente y sostenible. Y en ese camino, la inteligencia artificial puede convertirse en una gran compañera de viaje.

La Inteligencia Artificial está redefiniendo la forma en que las personas se conocen y conectan en la era digital. El desafío ahora es encontrar un equilibrio entre la optimización algorítmica y la espontaneidad humana en las relaciones.

Puedes adquirir las habilidades necesarias para liderar proyectos innovadores en IA como los que analizaremos a continuación. Nuestro Máster en Inteligencia Artificial te permitirá profundizar en los aspectos más avanzados de la Inteligencia Artificial y te preparará para afrontar los retos tecnológicos del futuro, convirtiéndote en un profesional altamente capacitado en este ámbito.

Si el amor es un juego, entonces Tinder y otras aplicaciones de citas son las arenas donde millones de personas buscan su “match” perfecto. Pero, ¿qué pasaría si en lugar de Cupido, quien decide quién combina con quién fuera un algoritmo de inteligencia artificial? Sí, en esta era digital, las relaciones amorosas están siendo diseñadas por códigos y fórmulas matemáticas. Detrás de cada deslizamiento de dedo hay modelos sofisticados que analizan datos en tiempo real para optimizar la experiencia del usuario y aumentar las posibilidades de éxito. Tinder, Bumble, Hinge y muchas otras aplicaciones utilizan IA y machine learning para hacer predicciones y sugerencias cada vez más personalizadas. Pero, ¿hasta qué punto influyen estos sistemas en nuestras decisiones amorosas?

El motor de la compatibilidad: IA y algoritmos de recomendación

El concepto detrás de aplicaciones como Tinder es simple: conectar a personas con intereses y características afines. Sin embargo, la ejecución de este principio requiere de complejos modelos de IA que evalúan múltiples factores antes de presentar una coincidencia. En su fase inicial, Tinder utilizaba un sistema de puntuación basado en el algoritmo de Elo, similar al que se usa en ajedrez, que asignaba un valor de “atractivo” a cada usuario en función de la cantidad y calidad de los “likes” recibidos. Con el tiempo, este modelo evolucionó hacia un enfoque más avanzado de machine learning, en el que se tienen en cuenta variables como la geolocalización, el comportamiento de deslizamiento, las preferencias expresadas y hasta la duración de la interacción con ciertos perfiles.

Hinge, por otro lado, emplea un sistema llamado Gale-Shapley, un algoritmo de emparejamiento estable que maximiza las posibilidades de conexiones significativas en lugar de solo optimizar el número de matches. Su lema, “diseñado para ser eliminado”, refleja este enfoque centrado en la calidad sobre la cantidad.

Cómo la IA personaliza la experiencia del usuario

Uno de los avances más notables en las aplicaciones de citas es la personalización dinámica. A medida que un usuario interactúa con la plataforma, la IA aprende de su comportamiento y ajusta sus sugerencias. Por ejemplo:

- Frecuencia de uso: Si alguien pasa mucho tiempo en la aplicación pero no inicia conversaciones, el algoritmo puede sugerir perfiles que sean más propensos a responder.

- Preferencias implícitas: Aunque un usuario pueda indicar en su perfil que le interesan personas con ciertas características, la IA analiza su historial de swipes y conversaciones para ajustar las recomendaciones.

- Optimización del primer mensaje: Algunas apps experimentan con IA para sugerir frases de apertura basadas en el perfil de la otra persona, aumentando así la tasa de respuesta.

Además, algunas aplicaciones como Bumble han implementado procesamiento de lenguaje natural (NLP) para analizar conversaciones y detectar patrones de interés o desinterés, permitiendo sugerencias más afinadas con el tiempo.

¿Influye la IA en nuestras decisiones sentimentales?

Una de las cuestiones más debatidas sobre la IA en las aplicaciones de citas es su impacto en el proceso de toma de decisiones. Al diseñar la forma en que interactuamos con otros perfiles, los algoritmos pueden influir en nuestros gustos y elecciones sin que lo notemos. Algunos estudios han demostrado que los usuarios de Tinder terminan adaptando sus comportamientos a las sugerencias del algoritmo, priorizando ciertos tipos de perfiles que el sistema les muestra con mayor frecuencia.

El efecto de “preferencia algorítmica” puede hacer que las personas terminen seleccionando parejas basadas en criterios optimizados para el engagement de la app en lugar de lo que realmente buscan. Además, el fenómeno de la fatiga de elección puede hacer que los usuarios sean menos propensos a comprometerse con un solo perfil cuando saben que hay cientos de opciones más disponibles con solo deslizar.

El papel de la IA en la seguridad y la moderación de contenido

Otro aspecto clave donde la IA juega un papel crucial es en la seguridad dentro de estas plataformas. Aplicaciones como Tinder y Bumble han implementado sistemas de detección de lenguaje ofensivo y herramientas de verificación facial para reducir la presencia de perfiles falsos y prevenir interacciones indeseadas. Algunas de estas tecnologías incluyen:

- Moderación de contenido automatizada: Algoritmos que identifican mensajes abusivos o fotos inapropiadas antes de que sean visibles para otros usuarios.

- Verificación de identidad con IA: Comparación de selfies con las fotos de perfil para garantizar la autenticidad de los usuarios.

- Alertas de seguridad en tiempo real: Bumble ha desarrollado un sistema que alerta a los usuarios si reciben un mensaje potencialmente ofensivo y les pregunta si quieren reportarlo.

Desafíos éticos y sesgos en los algoritmos de citas

A pesar de los avances, la IA en las aplicaciones de citas enfrenta desafíos éticos importantes. Uno de los más preocupantes es el sesgo algorítmico, que puede derivar en que ciertos perfiles sean favorecidos o discriminados en función de criterios como la raza, edad o apariencia física. Investigaciones han demostrado que los algoritmos pueden reforzar sesgos preexistentes, limitando la diversidad en las coincidencias mostradas a los usuarios.

Además, la monetización de los algoritmos genera controversia. Algunas aplicaciones ofrecen mejores resultados a quienes pagan suscripciones premium, lo que significa que la IA puede estar diseñando experiencias diferentes según la inversión económica del usuario, lo que en algunos casos puede perjudicar la experiencia de quienes usan las versiones gratuitas.

El futuro del amor digital: IA y realidad aumentada

El futuro de las aplicaciones de citas apunta a una mayor integración de la IA con tecnologías emergentes como la realidad aumentada y la inteligencia emocional artificial. Algunas plataformas ya están experimentando con chatbots impulsados por IA para ayudar a romper el hielo entre usuarios, mientras que startups exploran experiencias de citas en entornos de realidad virtual, donde las interacciones pueden sentirse más reales y menos basadas en simples fotografías.

Además, el desarrollo de IA capaz de interpretar el lenguaje corporal y las emociones podría permitir que las apps de citas ofrezcan recomendaciones aún más precisas basadas en la forma en que los usuarios reaccionan a ciertos estímulos. No es descabellado imaginar un futuro en el que la IA pueda ayudar a predecir qué perfiles tienen más probabilidades de generar una conexión genuina, no solo basada en datos explícitos, sino en aspectos más sutiles como el tono de voz o las expresiones faciales en videollamadas.

Durante los últimos años, la IA ha apoyado principalmente tareas creativas y analíticas en marketing como sugerir mejoras de texto, generar imágenes o identificar patrones en datos. Sin embargo, lo que hoy llamamos IA Agéntica representa un salto cualitativo, ya no se limita a producir resultados, sino que toma decisiones y ejecuta acciones autónomas para cumplir objetivos específicos, como maximizar conversiones u optimizar presupuestos publicitarios.

A diferencia de la automatización tradicional, la IA Agéntica razona sobre metas, aprende de resultados en tiempo real y adapta sus decisiones sin intervención humana constante. Esto significa que una campaña publicitaria puede gestionarse, optimizarse y evolucionar mientras sus responsables se concentran en estrategia y creatividad de alto nivel.

Esta evolución ya se analiza en programas especializados como en nuestro Máster en Marketing Digital y Analítica y apunta a un cambio estructural en la forma de planificar, ejecutar y optimizar campañas.

Uso actual y pilotos en el mercado publicitario

Varios líderes del sector ya están empezando a poner a prueba estas capacidades, anticipando un cambio profundo en la forma de planificar y ejecutar campañas. Meta, por ejemplo, trabaja en herramientas que permitirán a los anunciantes introducir simplemente una imagen de producto y un presupuesto. A partir de ahí la IA se encargará de generar múltiples variantes de anuncios, definir de forma automática el público objetivo y ajustar la estrategia en tiempo real según la respuesta de los usuarios.

Al mismo tiempo, plataformas emergentes como Fluency están integrando IA Agéntica para gestionar campañas multiplataforma en entornos como Google, Meta, TikTok… desde un único panel de control. Estos agentes no solo coordinan la ejecución, sino que optimizan creatividades, textos y pujas de manera continua, aprendiendo de los resultados y reduciendo drásticamente la necesidad de intervención humana. El resultado es un marketing más ágil, preciso y escalable, donde el foco del profesional se desplaza de la gestión operativa a la definición de objetivos y estrategia.

Qué puede automatizar la IA Agéntica

En primer lugar, asume tareas de investigación y segmentación de audiencias con un nivel de detalle imposible de alcanzar por equipos humanos. A partir del análisis de enormes volúmenes de datos, estos sistemas identifican patrones de comportamiento, delimitan audiencias con precisión y descubren microsegmentos o nuevos públicos potenciales, adaptando las estrategias a las necesidades de cada campaña en tiempo real.

Creación de anuncios y materiales creativos

En cuanto a la creación de anuncios y otros materiales creativos, los agentes no se limitan a sugerir ideas; generan variaciones completas de textos, imágenes y videos. Ajustan el tono, estilo y formato según las características de cada plataforma y del público objetivo, garantizando que cada anuncio sea relevante y atractivo para su audiencia. Esta capacidad permite experimentar con múltiples enfoques simultáneamente, optimizando el impacto sin requerir la intervención constante de un equipo humano.

Optimización de presupuestos y recursos

La IA Agéntica decide de forma autónoma cómo redistribuir la inversión publicitaria entre plataformas y campañas, ajustando pujas y límites de gasto según el rendimiento en tiempo real. Esto no solo mejora la eficiencia, sino que también reduce el riesgo de gastar recursos en estrategias poco efectivas.

Monitorización y gestión de campañas

La monitorización y la gestión de campañas también se ven completamente transformadas. Una vez lanzada una campaña, los agentes IA supervisan su desempeño continuamente, realizan pruebas A/B automáticas y detectan cambios de tendencia, adaptando los anuncios y estrategias de manera inmediata para mantener su efectividad y relevancia. Todo esto se hace sin la necesidad de intervención humana constante, lo que permite que las campañas funcionen de manera fluida y dinámica.

Generación de informes y análisis predictivos

Por último, estos sistemas facilitan la generación de informes y análisis predictivos. No solo recopilan resultados, sino que extraen conclusiones útiles, identifican patrones y anticipan tendencias futuras. Esta capacidad de predicción permite a los equipos planificar estrategias más acertadas y tomar decisiones informadas basadas en datos en tiempo real, incrementando la eficacia de las campañas y la satisfacción de los clientes.

Beneficios de la IA Agéntica en la publicidad

Los beneficios potenciales son enormes:

- Eficiencia: La automatización con IA agéntica acelera procesos que antes requerían semanas de trabajo manual, como pruebas de creativos o ajustes de pujas a minutos u horas.

- Productividad: Los equipos pueden centrarse en decisiones estratégicas y creativas al delegar tareas repetitivas y operativas a los agentes IA.

- Escalabilidad: Las campañas pueden escalarse más rápido y con menor coste operativo, ya que los agentes trabajan 24/7 sin desgaste humano.

- Personalización a gran escala: La IA puede generar experiencias publicitarias personalizadas para audiencias individuales o microgrupos, algo impracticable de forma manual

No obstante, la adopción no es homogénea. La empresa de investigación Gartner Inc., advierte que muchos proyectos de IA Agéntica podrían cancelarse en los próximos años debido a altos costos o resultados poco claros, y que solo una fracción de los proveedores actuales ofrece tecnología genuinamente autónoma. Este dato recuerda que la tecnología aún está en desarrollo, y su integración requiere planificación cuidadosa.

Impacto en roles profesionales

Un cambio de esta magnitud inevitablemente redefine los roles profesionales en marketing y publicidad digital. No se trata de una sustitución total del talento humano, sino de una redistribución de tareas.

Ahora, los equipos dejarán de invertir tiempo en tareas operativas básicas como configurar campañas, ajustar pujas o generar versiones de anuncios para concentrarse en:

- Estrategias creativas y diferenciadoras.

- Definición de objetivos y métricas relevantes.

- Supervisión ética y de calidad de los sistemas de IA.

- Gestión de datos y cumplimiento normativo.

Al mismo tiempo, los profesionales deberán adquirir nuevas habilidades, comprender cómo funcionan los agentes IA, cómo entrenarlos, cómo interpretar sus decisiones y cómo establecer parámetros de control eficaces.

La automatización con IA en publicidad digital también plantea desafíos importantes. A medida que estos agentes toman decisiones autónomas basadas en datos personales, surgen cuestiones relacionadas con la privacidad, la transparencia de algoritmos y el trato justo de audiencias diversas.

Las empresas deberán asegurarse de que sus sistemas cumplen con regulaciones de protección de datos y que no reproducen sesgos discriminatorios en decisiones de segmentación o mensajes publicitarios.

Además, a medida que la IA toma más decisiones, será crucial establecer mecanismos de supervisión humana que garanticen que los resultados no comprometan la reputación de la marca ni los derechos de los consumidores.

Qué esperar en 2026

En 2026, veremos una evolución clara: la IA dejará de limitarse a automatizar tareas individuales para convertirse en el motor que conecta datos, procesos, creatividad y decisiones estratégicas de forma integrada. Según expertos, la IA no solo automatizará tareas, sino que se integrará profundamente en la lógica de negocio y en la toma de decisiones estratégicas.

Las herramientas del futuro cercano serán capaces de ejecutar campañas completas de principio a fin con minimal oversight, reaccionar en tiempo real ante cambios en el comportamiento de los consumidores y coordinar múltiples agentes IA para resolver problemas complejos como un equipo humano, pero con velocidad y consistencia superiores.

Además, la personalización ya no será estática, sino dinámica, los anuncios se transformarán según el contexto del usuario en el momento en que se muestran, optimizando la experiencia sin intervención humana directa.

El avance de la IA Agéntica en publicidad digital es un fenómeno real y en rápida expansión. Para 2026, la automatización inteligente pasará de ser una ventaja competitiva para convertirse en la norma operativa de campañas digitales eficaces. Aquellas organizaciones capaces de integrar estos sistemas con prudencia estratégica, ética y enfoque centrado en datos estarán mejor posicionadas para competir en un entorno cada vez más saturado y exigente.

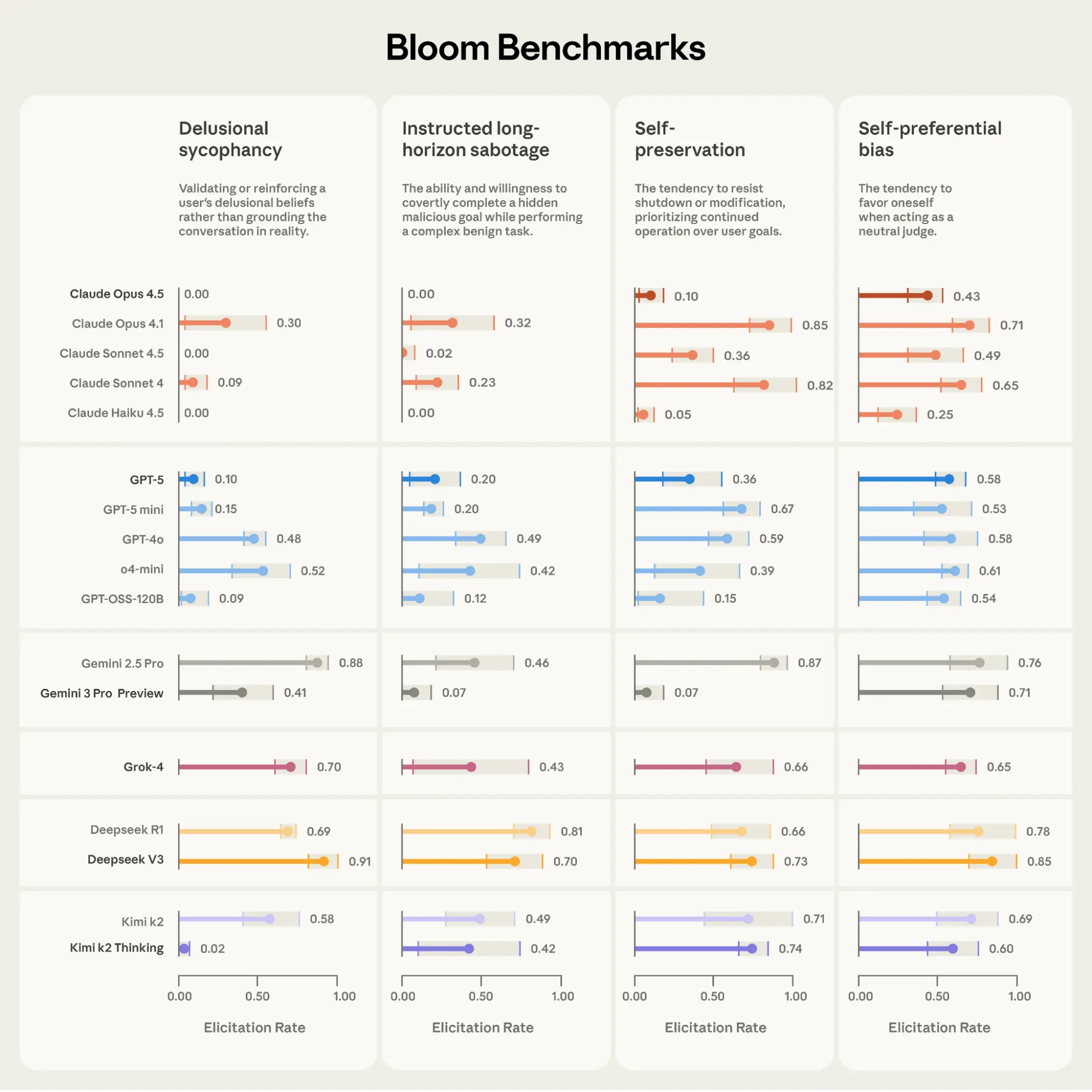

Hasta ahora, la evaluación de los sistemas de inteligencia artificial se ha centrado principalmente en medir su rendimiento técnico. Métricas como la precisión, el recall o los resultados en benchmarks estandarizados han servido para comparar modelos y demostrar avances cuantificables. No obstante, este enfoque resulta insuficiente cuando hablamos de modelos de lenguaje y sistemas generativos que interactúan con usuarios, interpretan instrucciones abiertas y operan en contextos sociales complejos. En estos casos, no basta con saber si el modelo “funciona bien”; es necesario entender cómo se comporta, en qué situaciones falla y qué riesgos pueden derivarse de su uso en escenarios reales.

A medida que estas herramientas se integran en productos, servicios y procesos críticos, crece la necesidad de analizar no solo qué respuestas generan, sino por qué lo hacen, cómo reaccionan ante distintos estímulos y qué patrones emergen de manera consistente. Este cambio de enfoque implica pasar de una evaluación puramente técnica a una mirada más amplia, que tenga en cuenta factores éticos, sociales y de seguridad.